3.6 ローカル無料 AI:Ollama

Ollama は、AI モデルをローカルで実行できる無料のツールです。Ollama を使用すると、API Key を購入することなく、完全に無料かつオフラインで AI を使用できます。

コア設定情報

Ollama を設定する際は、以下のコア情報を確認する必要があります:

- ホスト IP アドレス: 通常は

192.168で始まります(例:192.168.1.2) - Base URL の形式:

http://192.168.1.2:11434/api

重要な注意事項

httpプロトコルを使用する必要があります(https ではありません)- ポート

11434を使用する必要があります - 最後に

/apiを追加する必要があります

例:http://192.168.1.2:11434/api(192.168.1.2 はお使いのコンピュータの IP です)

なぜ Ollama を選ぶのか?

- 完全に無料: API Key を購入する必要はありません

- プライバシー保護: すべての会話データはローカルで処理されます

- オフライン使用: ネットワーク接続は不要です

- マルチモデル対応: Llama、Mistral、DeepSeek などをサポートしています

要件

- コンピュータ(このチュートリアルでは macOS を例にしていますが、Windows や Linux でも動作します)

- スマートフォンとコンピュータが同じ Wi-Fi ネットワークにあること

- 使用中、コンピュータの電源が入っており、Wi-Fi に接続されていること

手順(macOS の例)

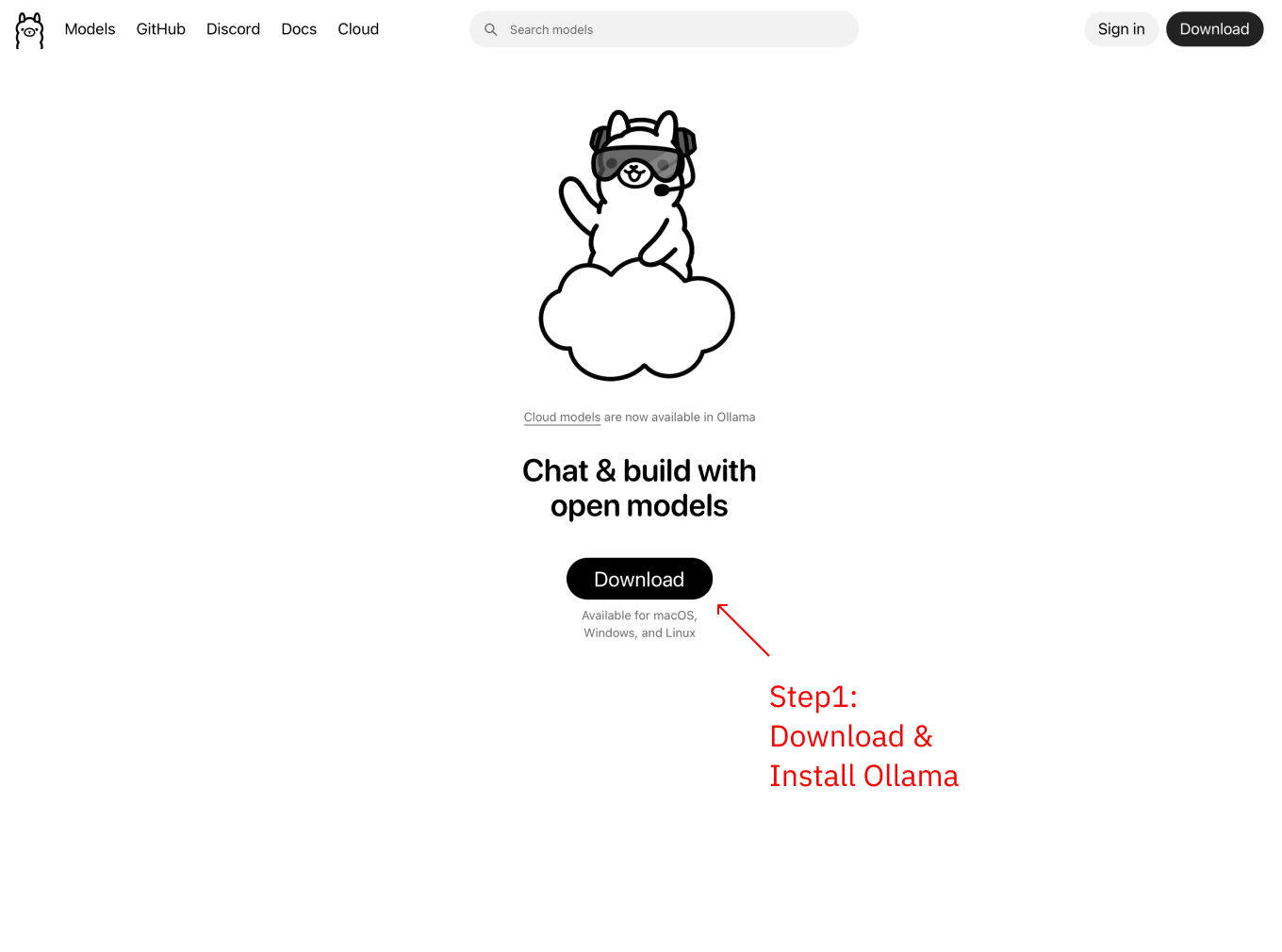

ステップ 1:Ollama のダウンロードとインストール

https://ollama.com にアクセスして、Ollama をダウンロードし、インストールします。

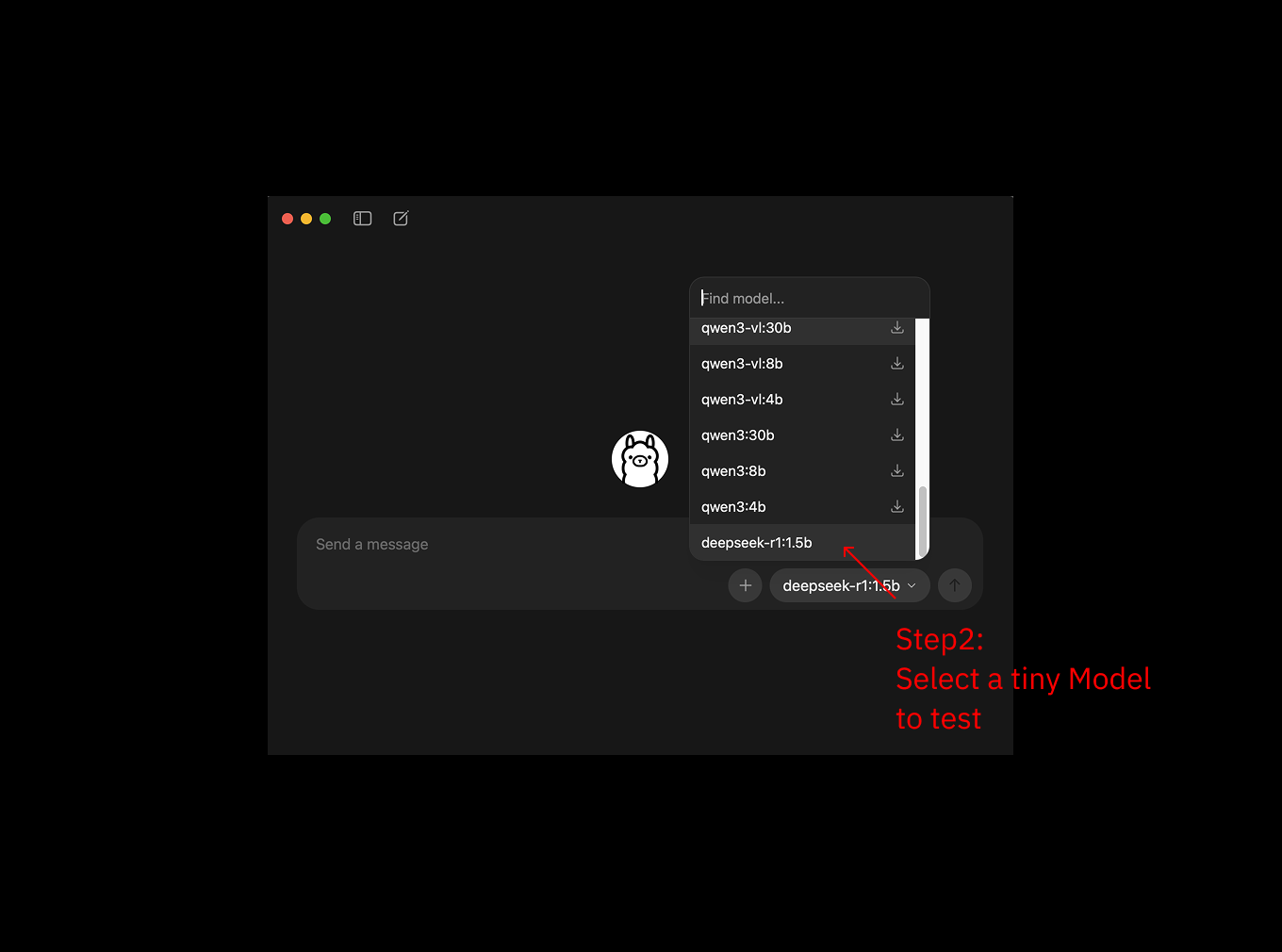

ステップ 2:モデルのダウンロード

ターミナルを開き、テスト用の軽量モデル(例:deepseek-r1:1.5b、約 1GB)をダウンロードします:

ollama pull deepseek-r1:1.5b

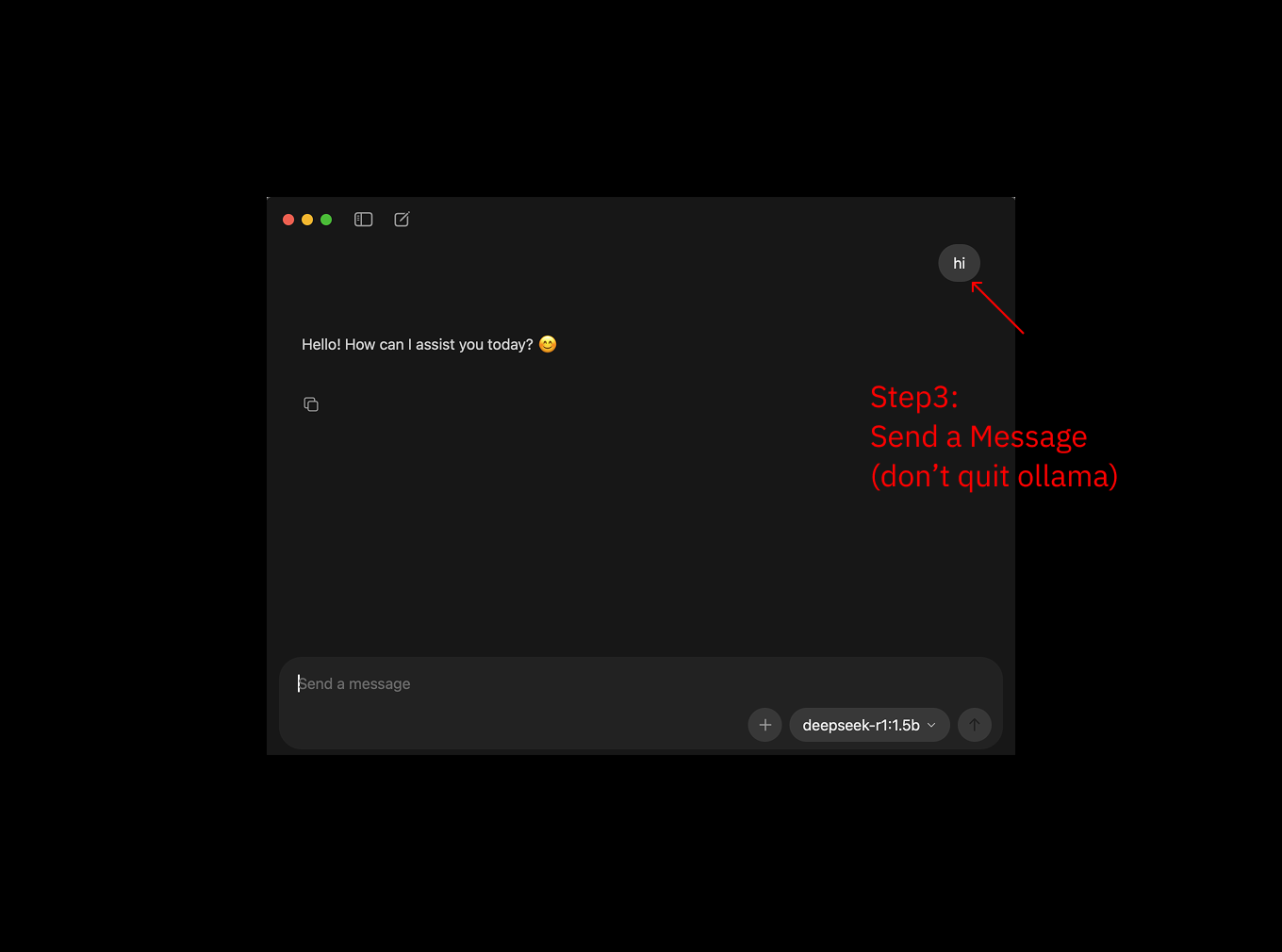

ステップ 3:モデルの実行

ダウンロードが完了したら、モデルを実行します:

ollama serve

ollama run deepseek-r1:1.5b初回起動は少し時間がかかります。その後、ターミナルで直接モデルとチャットしてテストできます。

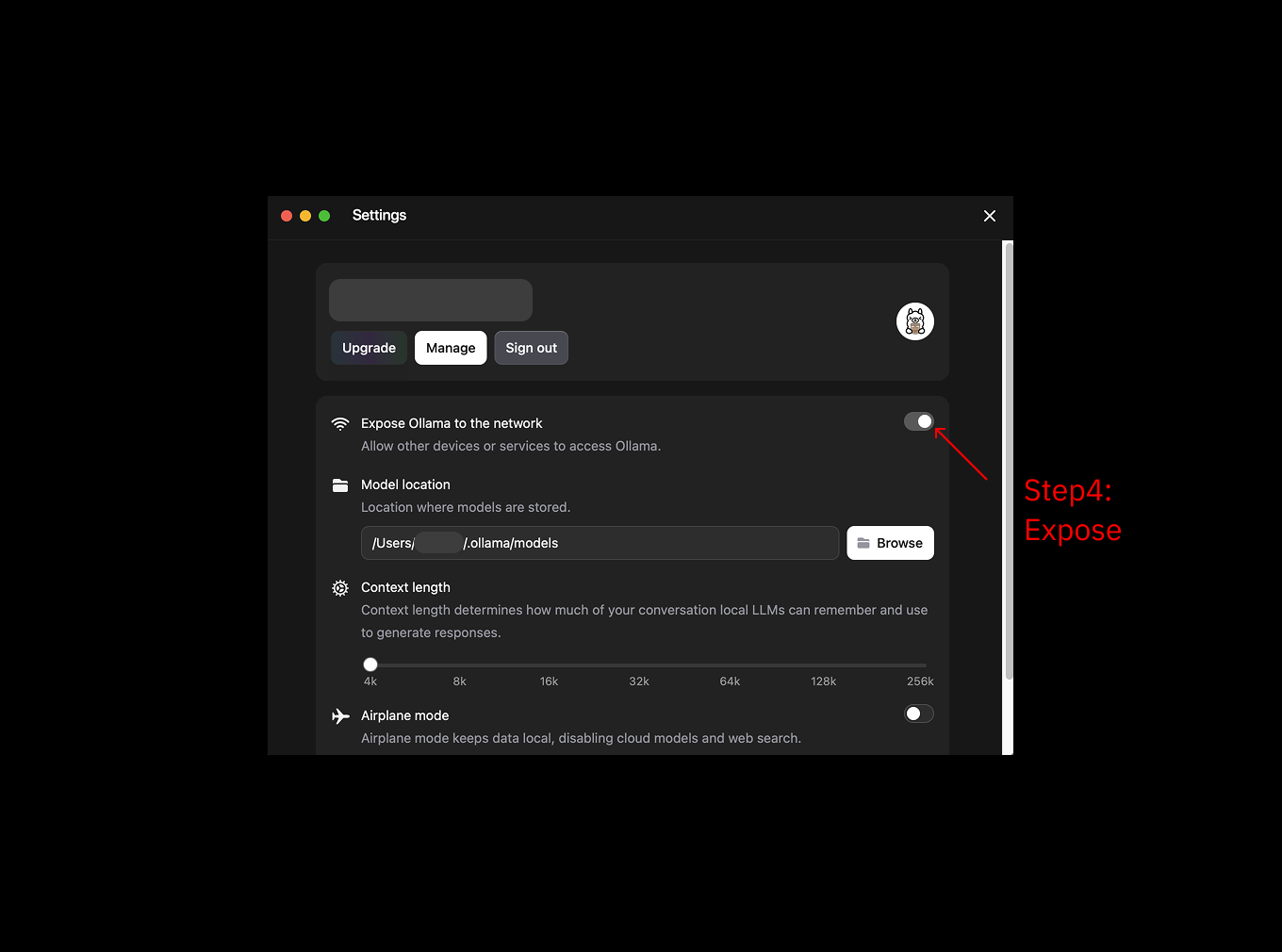

ステップ 4:LAN アクセスを有効にする

Ollama の設定で LAN アクセスを有効にし、スマートフォンからコンピュータ上の Ollama に接続できるようにします。

なぜこれが必要なのですか?

- MiniTavern はスマートフォンで動作し、LAN 経由でコンピュータ上の Ollama にアクセスする必要があるためです。

- デフォルトでは、Ollama はローカルアクセスのみを許可しています。

- 有効にすると、同じ Wi-Fi 上のデバイスからアクセスできるようになります。

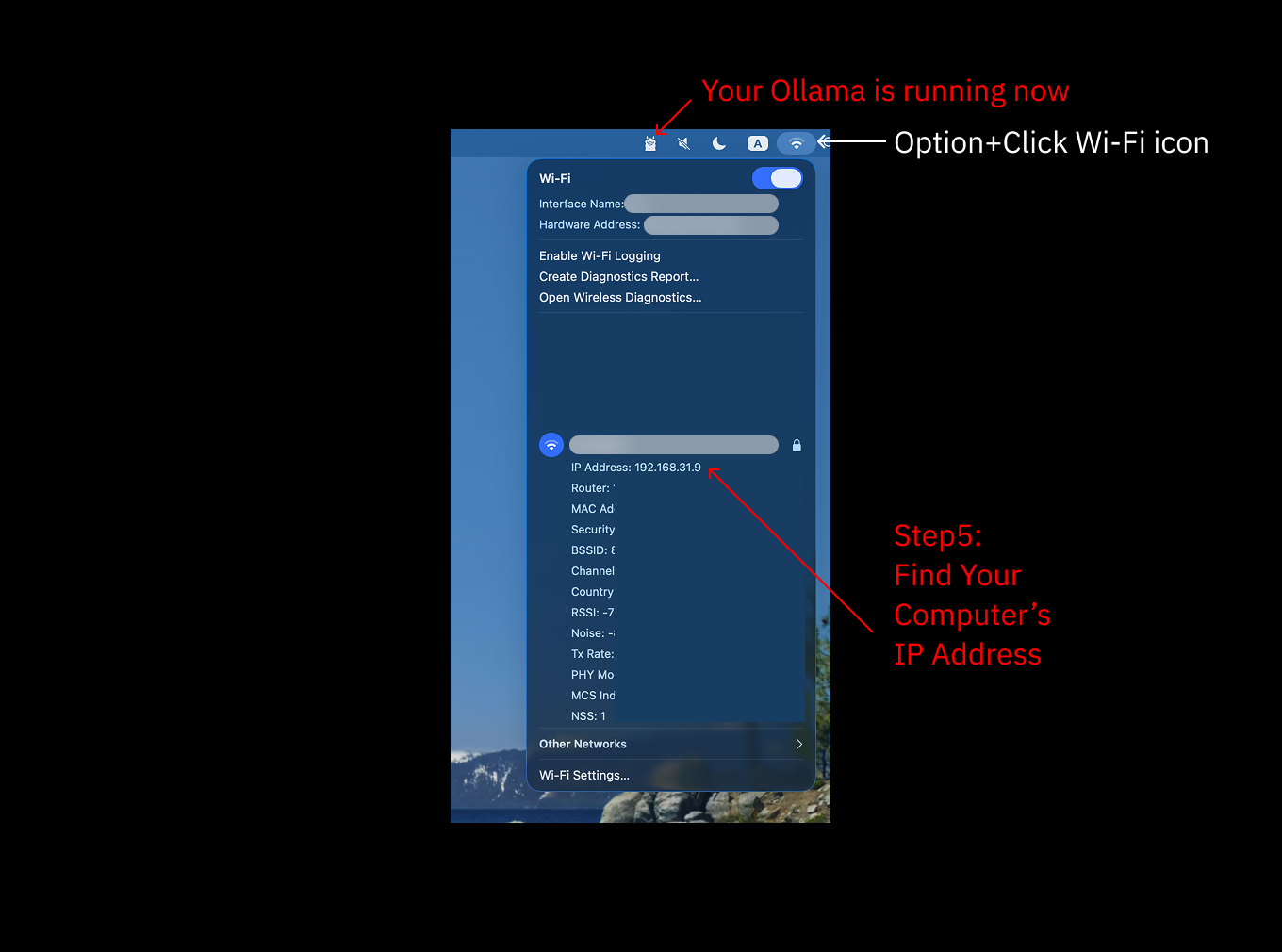

ステップ 5:コンピュータの IP アドレスを取得する

システム設定でコンピュータの IP アドレスを確認します(通常は 192.168 で始まります)。

macOS での IP 確認方法:

システム設定 → ネットワーク → Wi-Fi → 詳細 → TCP/IP → IPv4 アドレス

またはターミナルコマンドを使用:

ifconfig | grep "inet " | grep -v 127.0.0.1ステップ 6:MiniTavern での設定

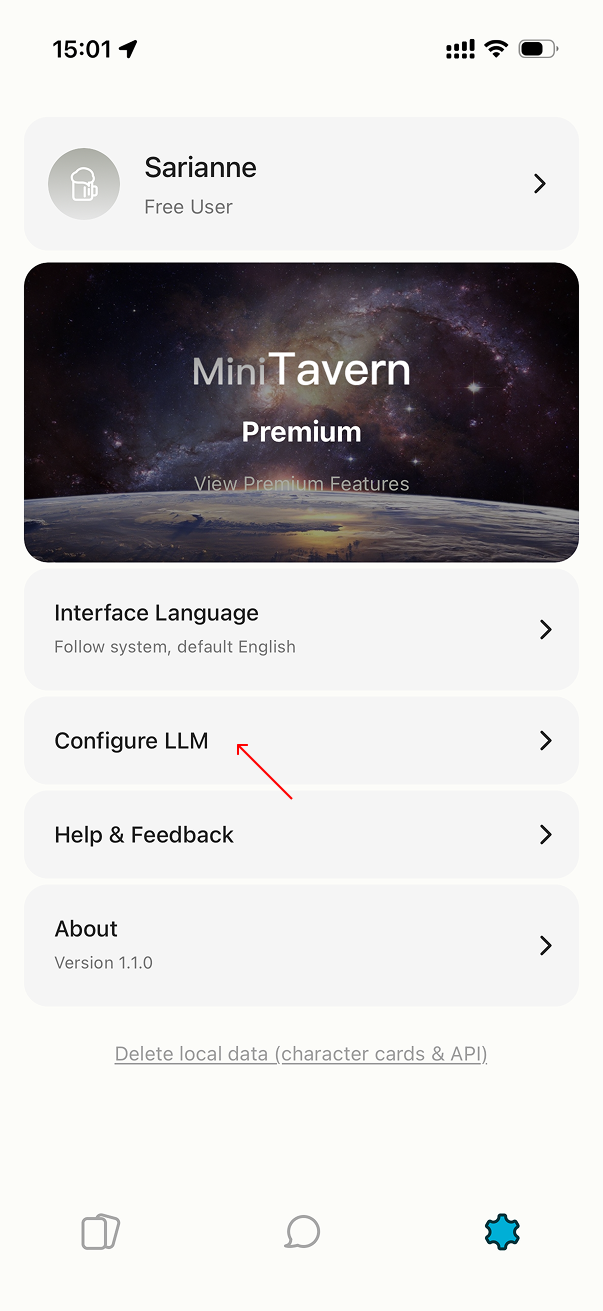

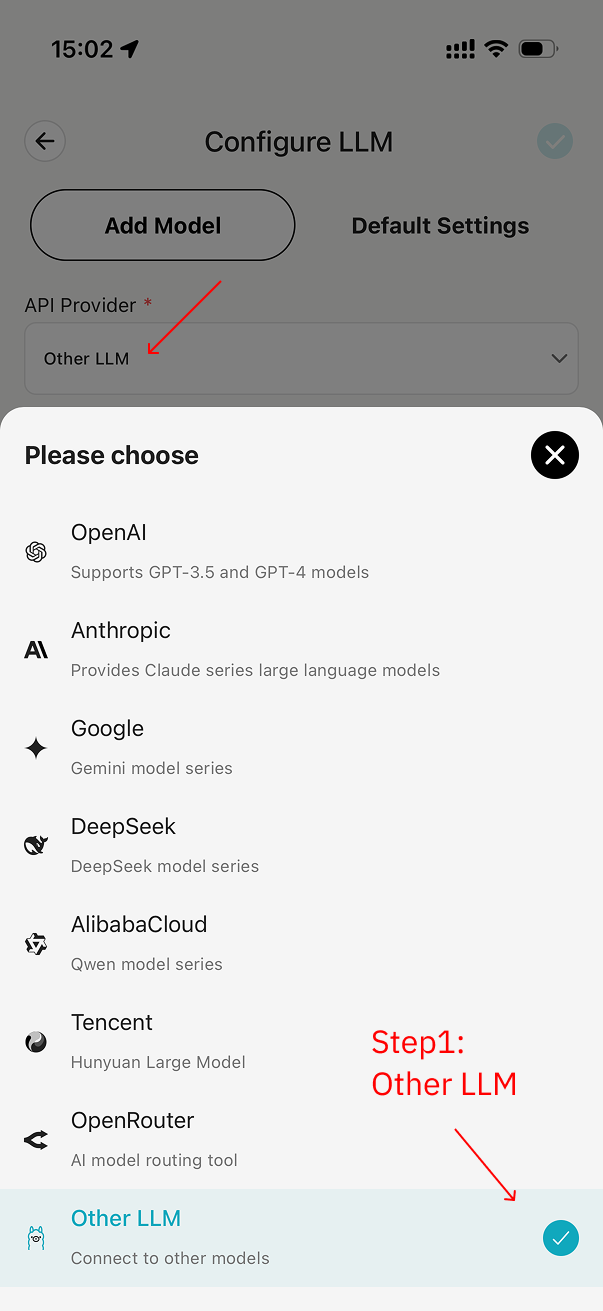

6.1 その他の LLM プロバイダーを選択

MiniTavern を開く → 「設定」 → 「LLM の設定」 → 「AI プロバイダー」 → 「Other」 を選択

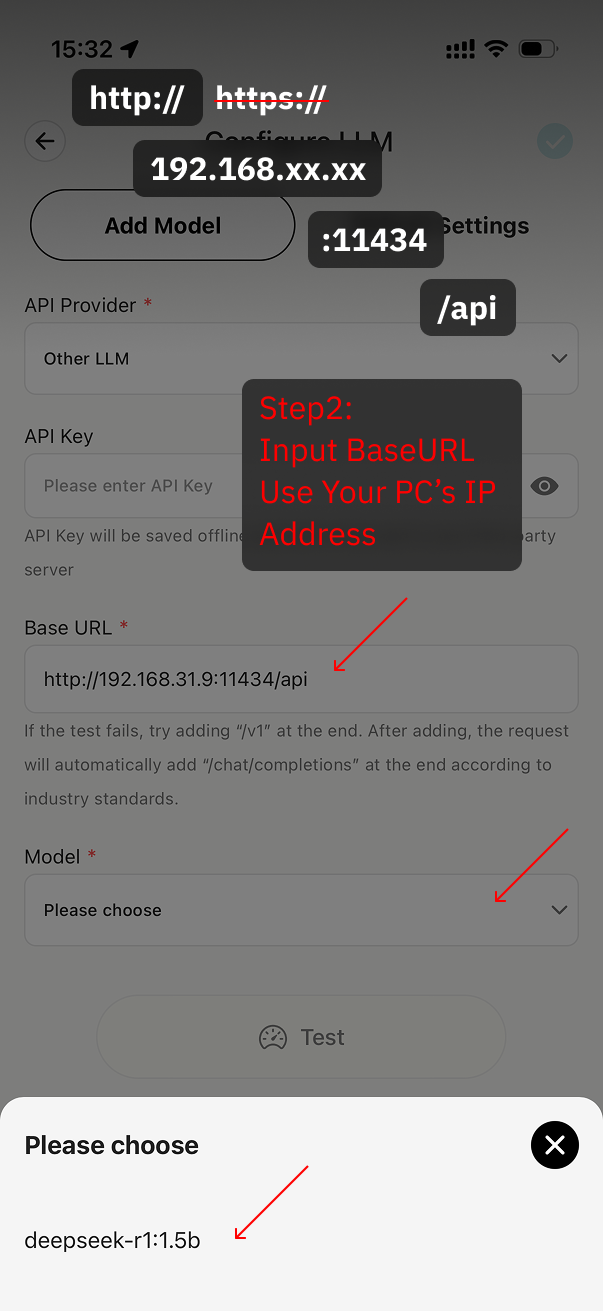

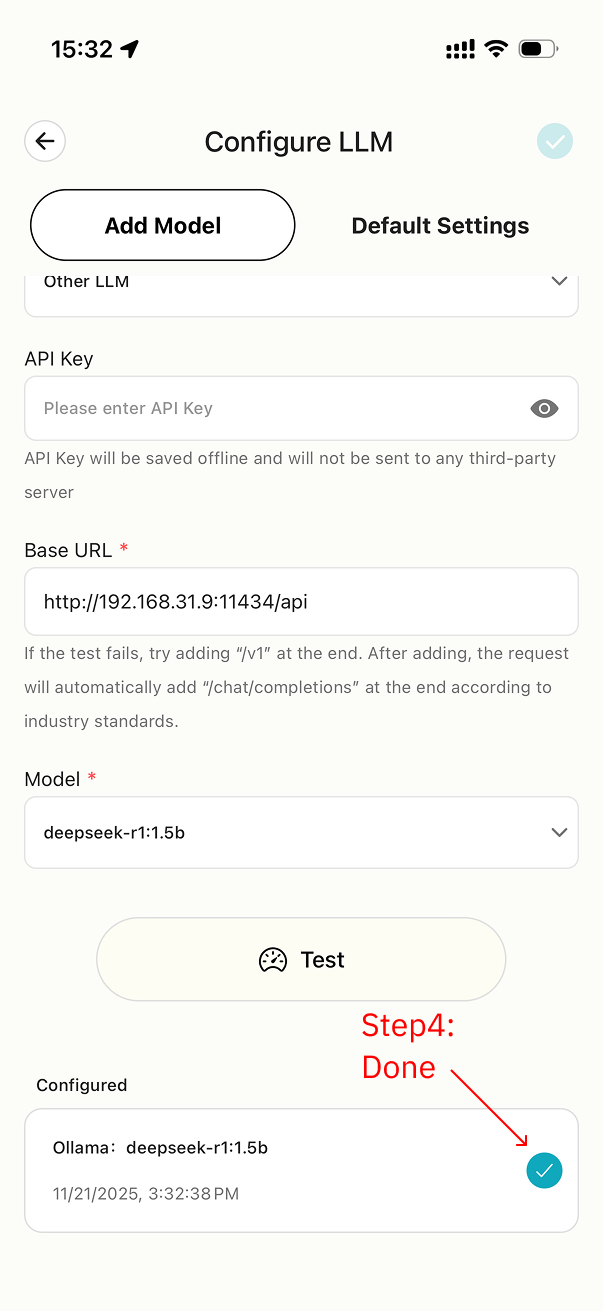

6.2 Ollama の Base URL を入力

Ollama の Base URL を入力します:http://コンピュータのIP:11434/api

例:http://192.168.1.2:11434/api

重要な注意事項

httpを使用する必要があります(https ではありません)- ポートは

11434である必要があります - 最後に

/apiを追加する必要があります

「モデルリストを取得」 をクリックします。

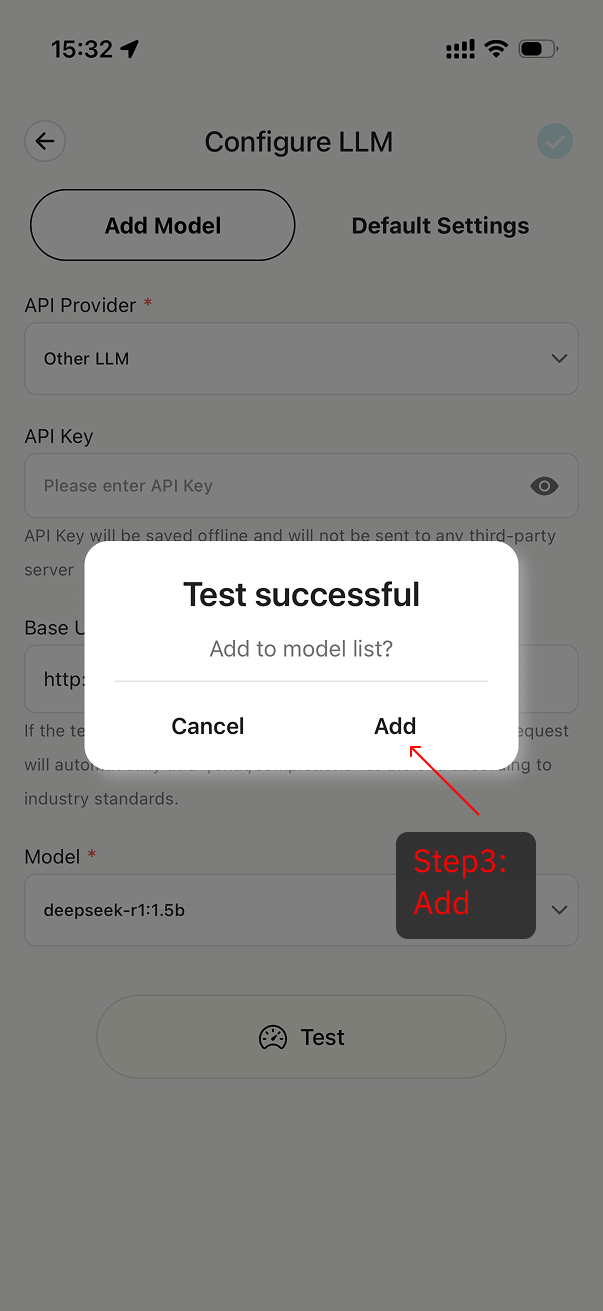

6.3 接続テスト

モデルを選択した後、「接続テスト」 をクリックして、設定が正しいか確認します。

接続できない場合:

- Ollama が実行されているか確認してください

- IP アドレスが正しいか確認してください

- スマートフォンとコンピュータが同じ Wi-Fi に接続されているか確認してください

- Base URL の形式が正しいか確認してください

6.4 追加完了

テストに成功したら「保存」をクリックして、モデルの追加が完了します。

Brew を使用した Ollama のインストール

brew install ollamaよく使う Ollama コマンド

# ダウンロード済みのすべてのモデルを表示

ollama list

# チュートリアルの例のモデルをダウンロード

ollama pull deepseek-r1:1.5b

# Ollama サービスを開始

ollama serve

# 新しいプロセスで指定したモデルを実行

ollama run deepseek-r1:1.5b

# Ollama サービスを停止

Ctrl + CFAQ

Q: 会話の質が低いのですが?

A:

- より大きなモデル(7B 以上)を使用してみてください

- 異なるキャラクターカードを試してみてください