3.6 本地免費 AI:Ollama

Ollama 是一個支援在本地執行 AI 模型的免費工具。使用 Ollama,您可以完全免費且離線使用 AI,無需購買 API Key。

核心設定資訊

設定 Ollama 時,您需要找到以下核心資訊:

- 主機 IP 位址:通常以

192.168開頭(例如192.168.1.2) - Base URL 格式:

http://192.168.1.2:11434/api

重要提示

- 必須使用

http協定(不是 https) - 必須使用連接埠

11434 - 結尾必須加上

/api

範例:http://192.168.1.2:11434/api(其中 192.168.1.2 是您電腦的 IP)

為什麼選擇 Ollama?

- 完全免費:無需購買 API Key

- 隱私保護:所有對話資料都在本地處理

- 離線使用:無需網路連線

- 多模型支援:支援 Llama、Mistral、DeepSeek 等

需求

- 一台電腦(本教學以 macOS 為例,Windows 和 Linux 也可以)

- 手機和電腦在同一個 Wi-Fi 網路

- 使用時電腦需要保持開機並連線到 Wi-Fi

步驟(macOS 範例)

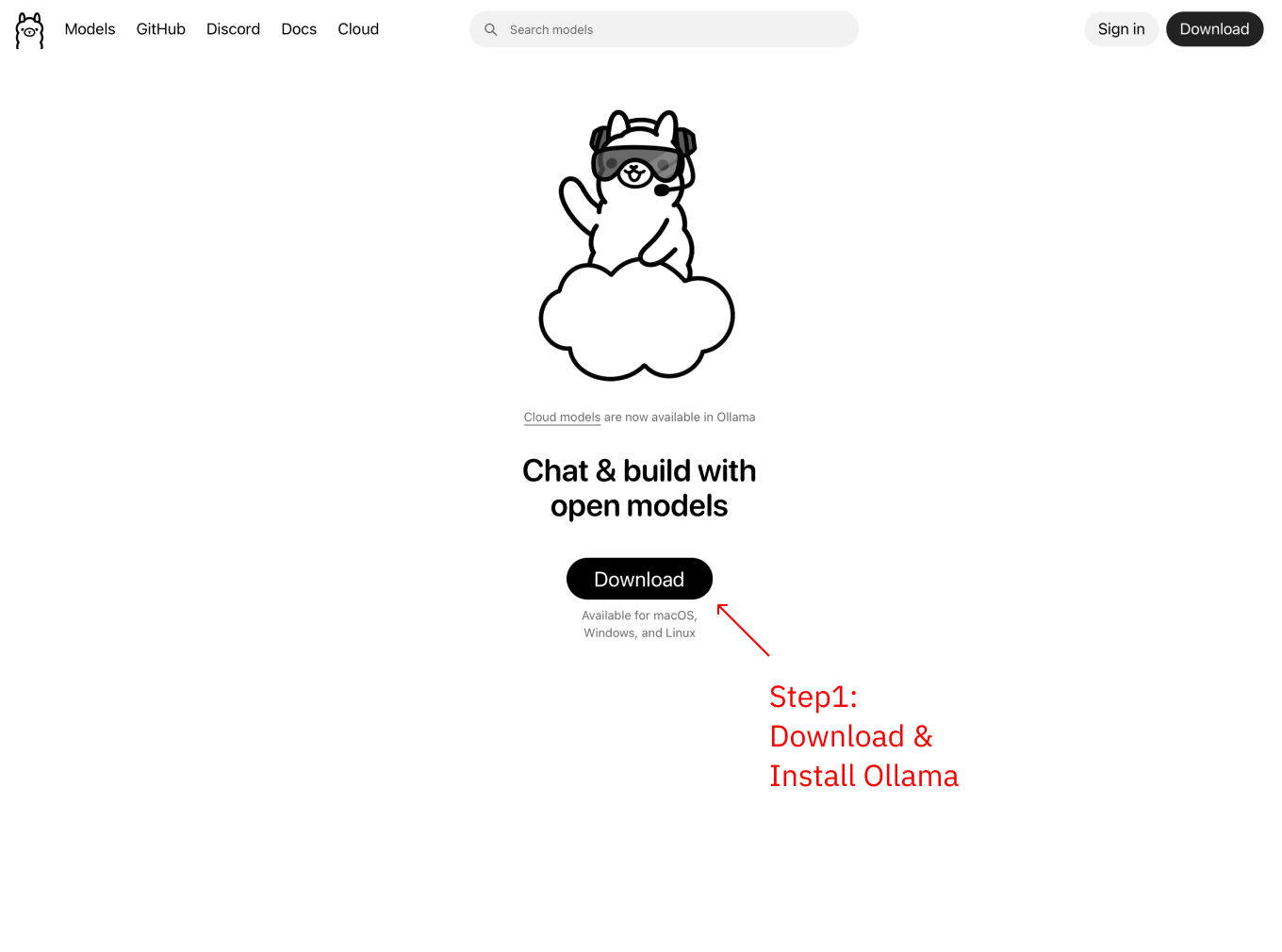

步驟 1:下載並安裝 Ollama

造訪 https://ollama.com 下載並安裝 Ollama

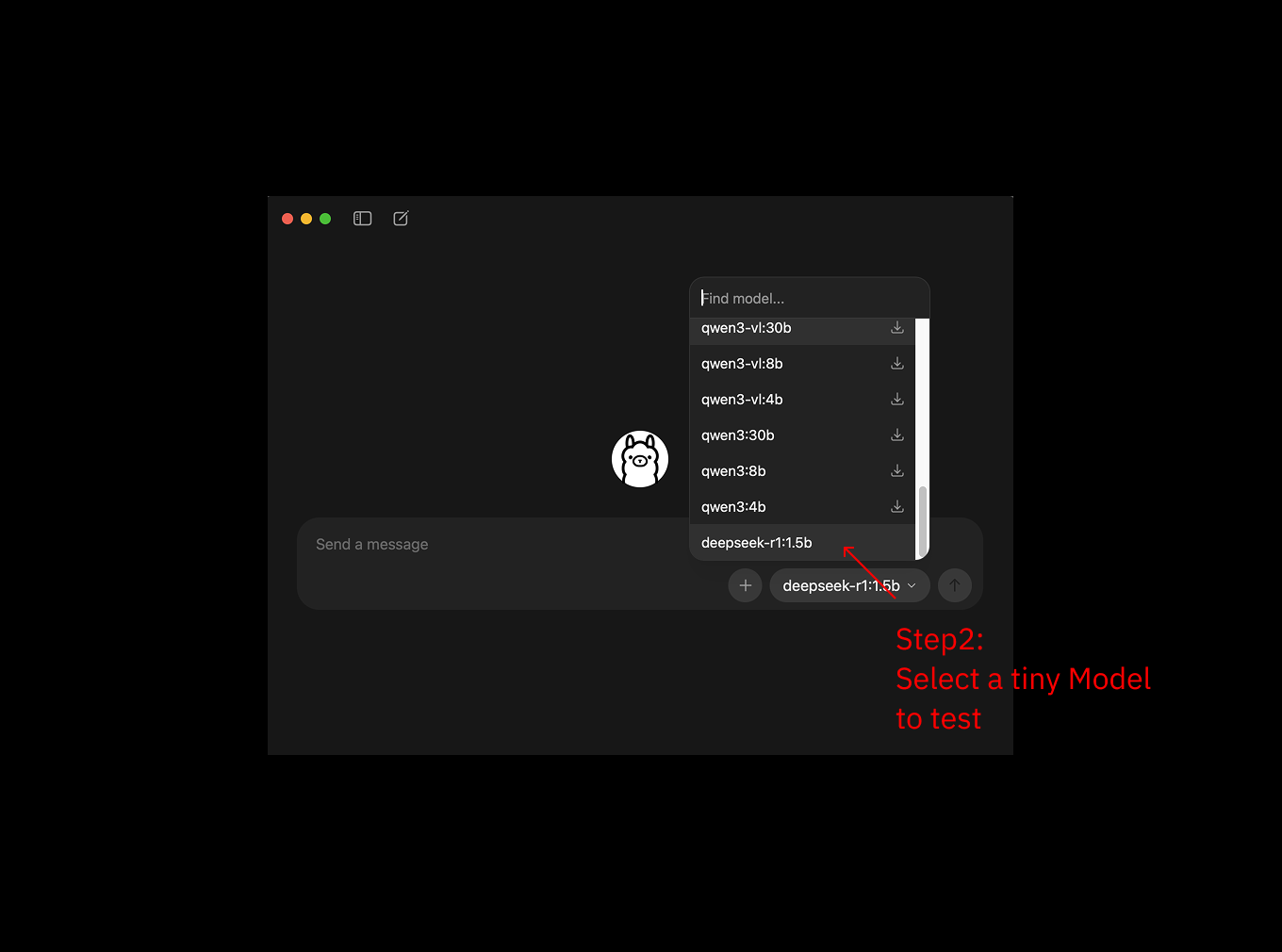

步驟 2:下載模型

開啟終端機並下載一個小型模型進行測試(例如 deepseek-r1:1.5b,約 1GB):

bash

ollama pull deepseek-r1:1.5b

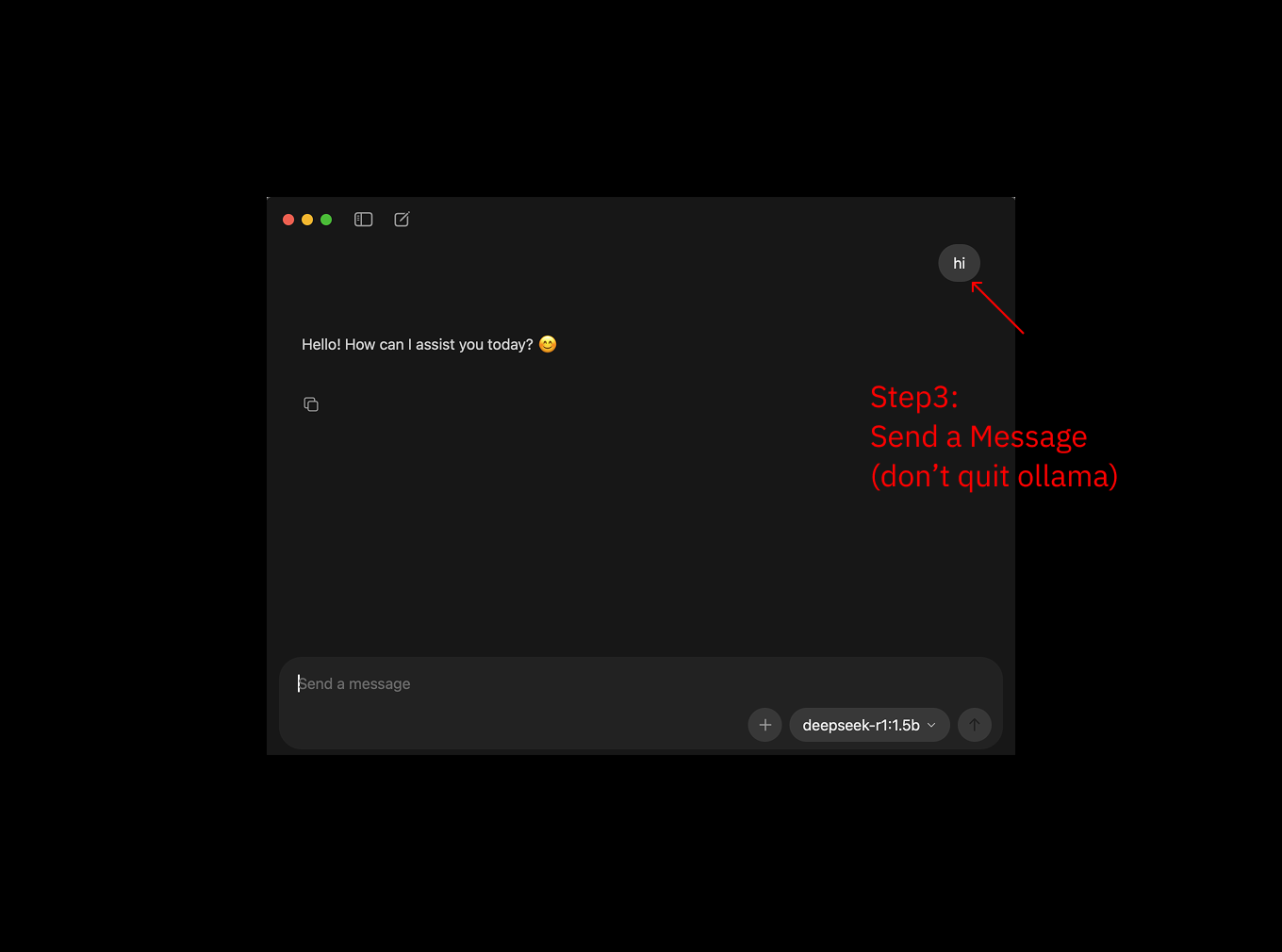

步驟 3:執行模型

下載完成後,執行模型:

bash

ollama serve

ollama run deepseek-r1:1.5b首次啟動會較慢,之後您可以直接在終端機中與模型聊天進行測試

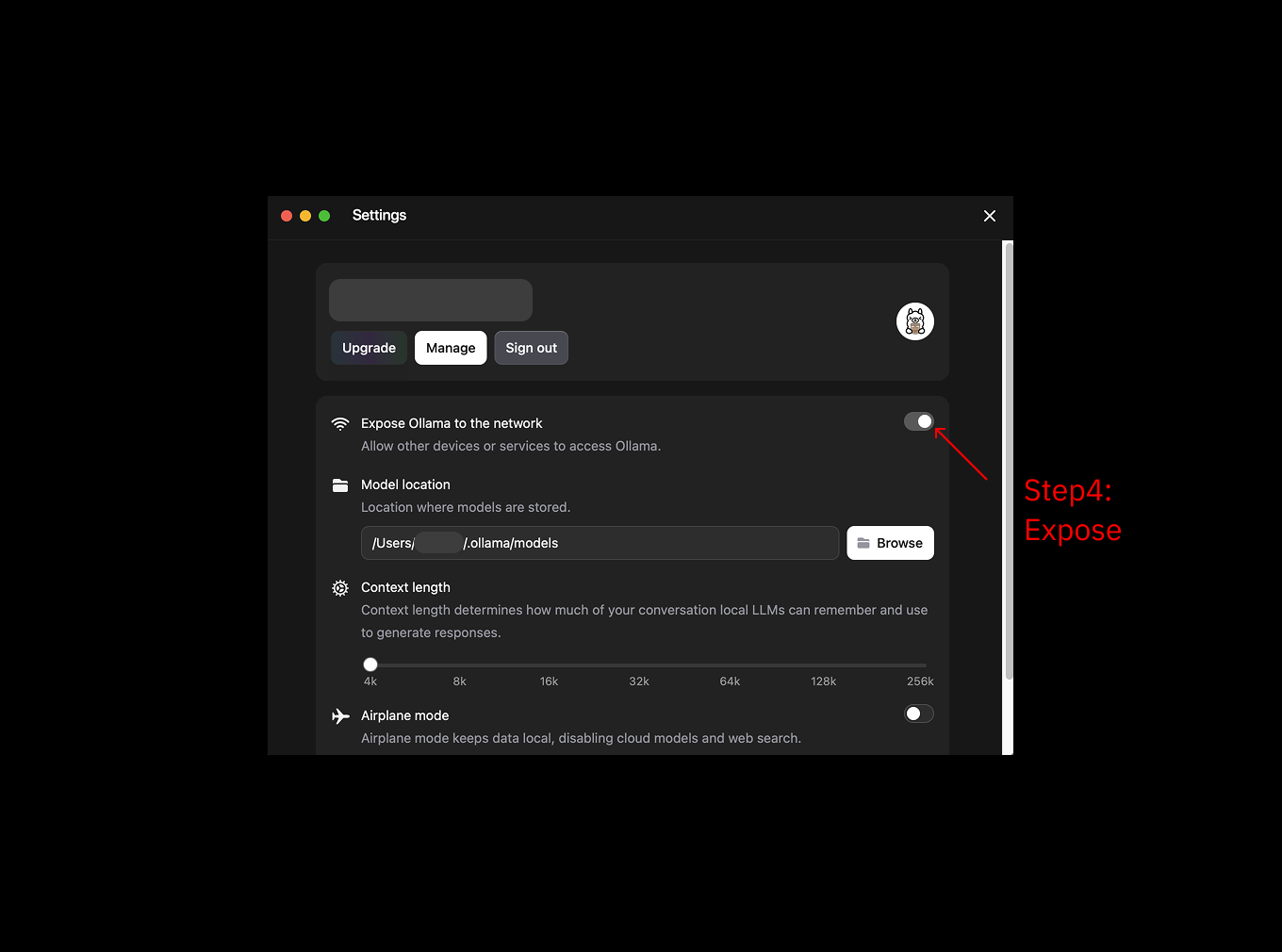

步驟 4:啟用區域網路存取

在 Ollama 設定中啟用區域網路存取,以允許手機連線到電腦上的 Ollama

為什麼需要這樣做?

- MiniTavern 在手機上執行,需要透過區域網路存取電腦上的 Ollama

- 預設情況下,Ollama 僅允許本地存取

- 啟用後,同一 Wi-Fi 上的裝置就可以存取它

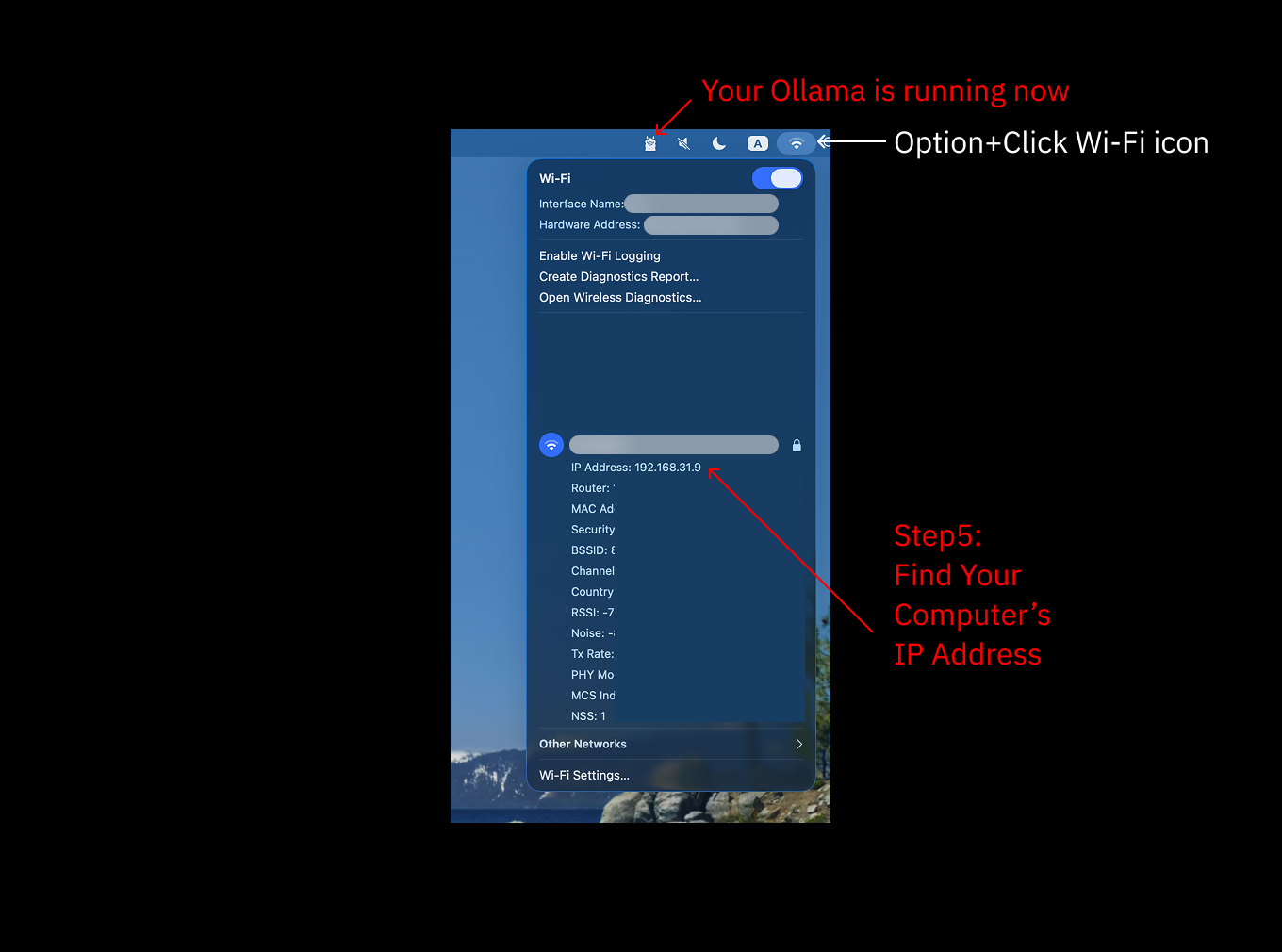

步驟 5:取得電腦 IP 位址

在系統設定中檢查您電腦的 IP 位址(通常以 192.168 開頭)

macOS IP 檢查方法:

系統設定 → 網路 → Wi-Fi → 詳細資訊 → TCP/IP → IPv4 位址

或使用終端機指令:

bash

ifconfig | grep "inet " | grep -v 127.0.0.1步驟 6:在 MiniTavern 中設定

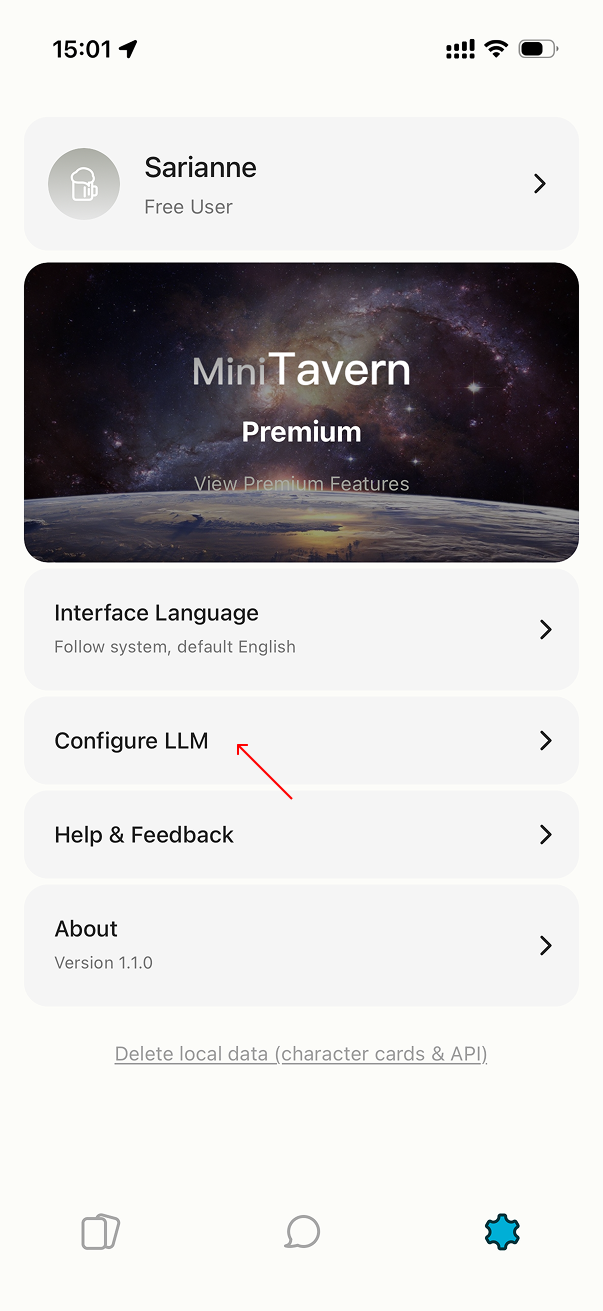

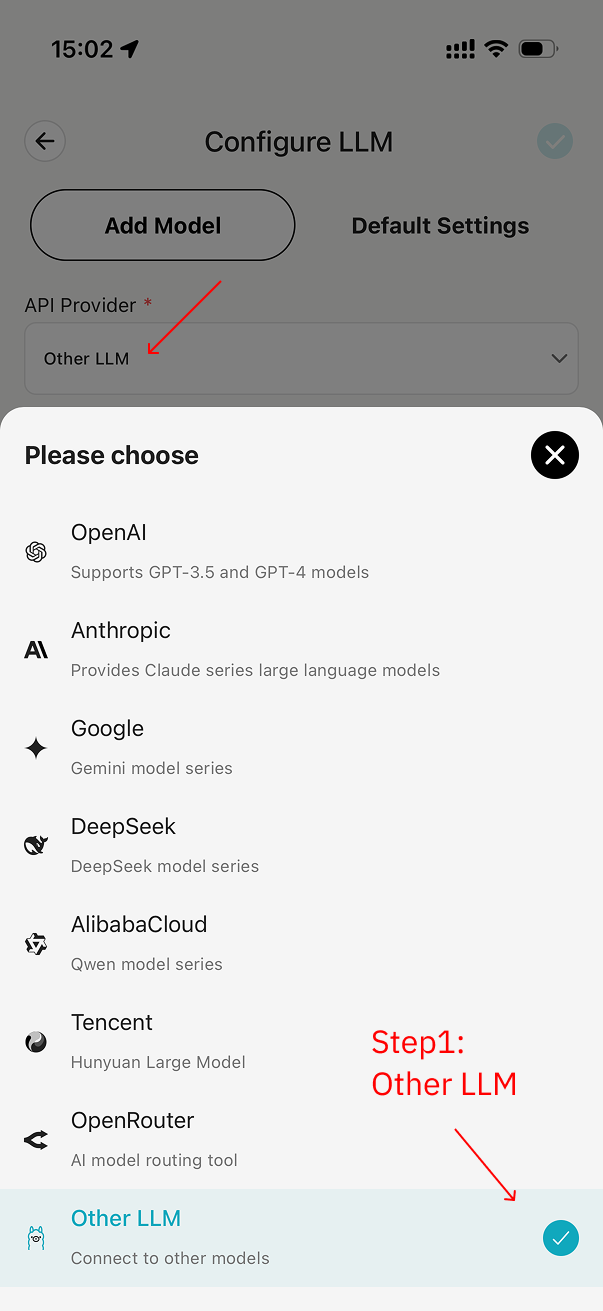

6.1 選擇 Other LLM 提供商

開啟 MiniTavern → 設定 → LLM 設定 → AI 提供商 → 選擇 Other

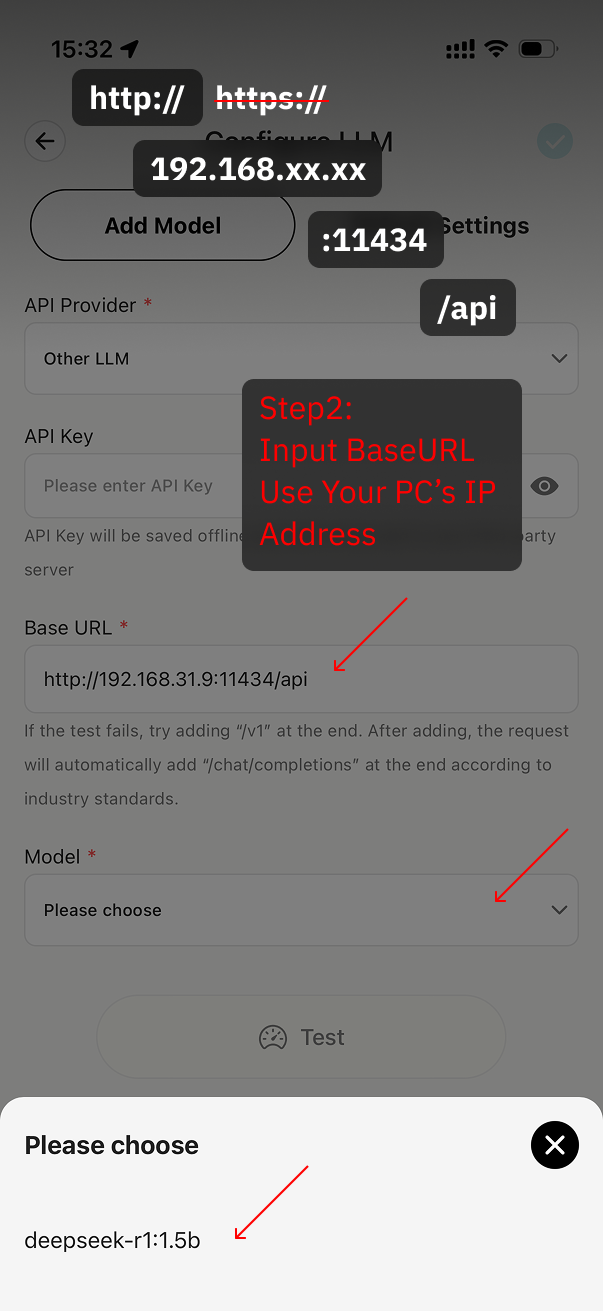

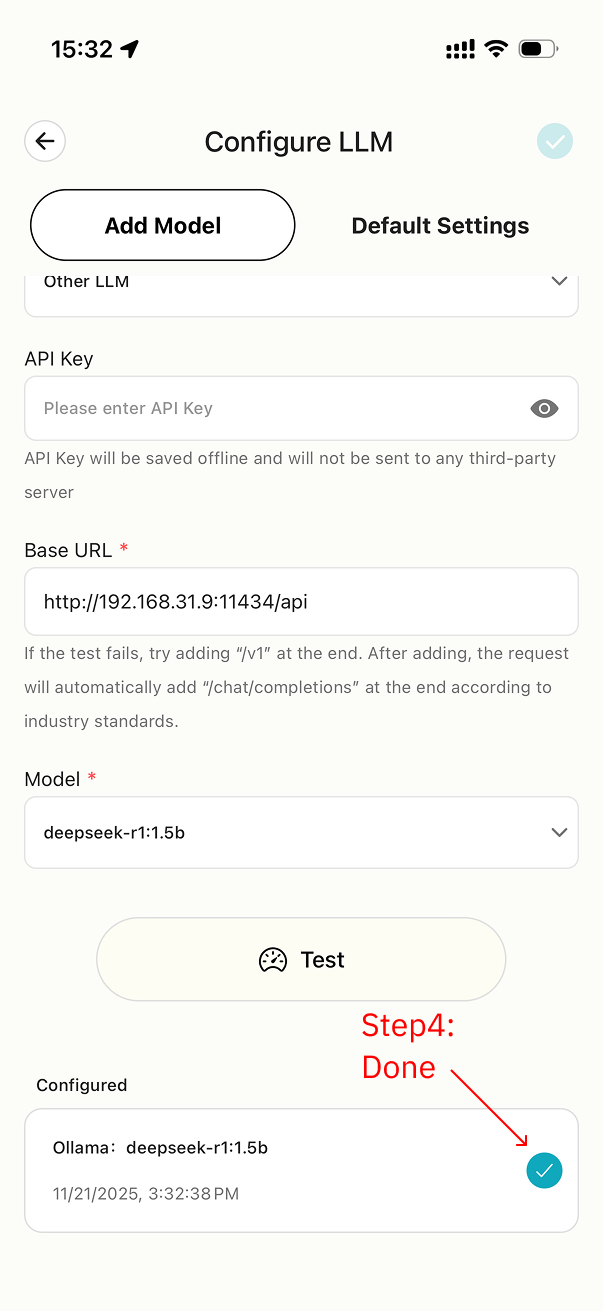

6.2 輸入 Ollama Base URL

輸入 Ollama Base URL:http://your-computer-IP:11434/api

範例:http://192.168.1.2:11434/api

重要提示

- 必須使用

http(不是 https) - 連接埠必須是

11434 - 結尾必須加上

/api

點擊取得模型清單

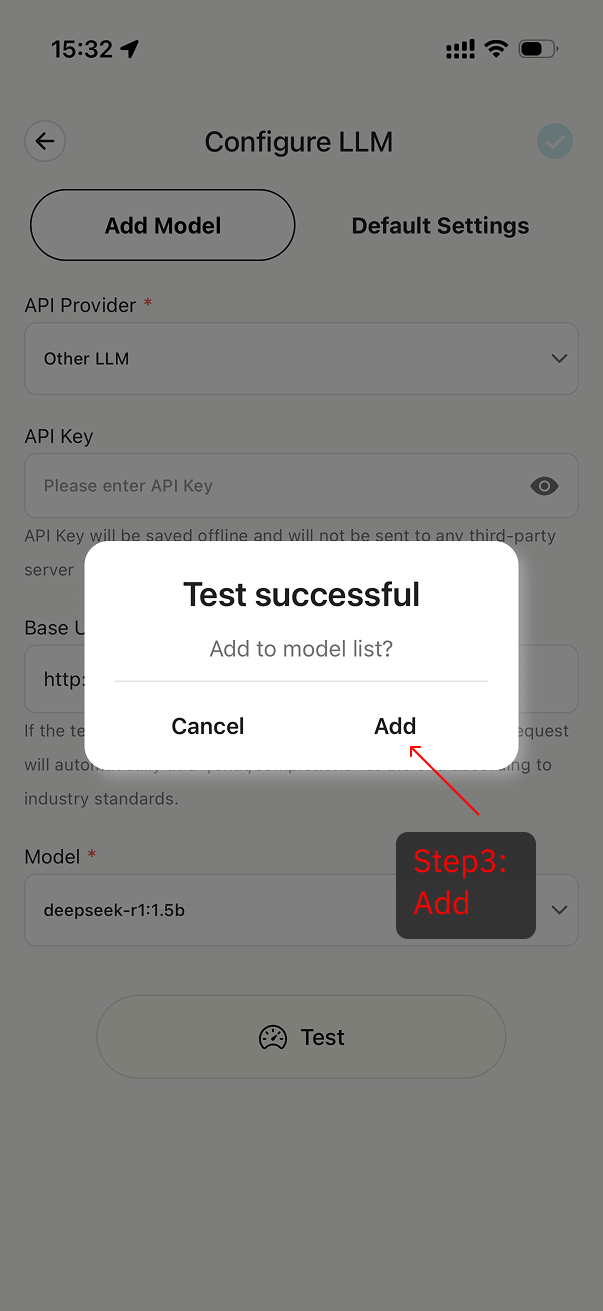

6.3 測試連線

選擇模型後,點擊測試連線以驗證設定是否正確

如果無法連線:

- 檢查 Ollama 是否正在執行

- 確認 IP 位址是否正確

- 確保手機和電腦在同一個 Wi-Fi

- 檢查 Base URL 格式是否正確

6.4 新增完成

測試成功後,點擊儲存,模型新增完成

使用 Brew 安裝 Ollama

bash

brew install ollama常用 Ollama 指令

bash

# 檢視所有已下載的模型

ollama list

# 下載教學範例模型

ollama pull deepseek-r1:1.5b

# 啟動 Ollama 服務

ollama serve

# 在新程序中執行指定模型

ollama run deepseek-r1:1.5b

# 停止 Ollama 服務

Ctrl + C常見問題

Q:對話品質不佳?

A:

- 嘗試使用更大的模型(7B 或以上)

- 嘗試不同的角色卡