3.6 IA locale gratuite : Ollama

Ollama est un outil gratuit qui prend en charge l'exécution de modèles IA localement. En utilisant Ollama, vous pouvez utiliser l'IA complètement gratuitement et hors ligne sans acheter de clé API.

Informations de configuration de base

Lors de la configuration d'Ollama, vous devez trouver les informations de base suivantes :

- Adresse IP de l'hôte : Commence généralement par

192.168(par exemple,192.168.1.2) - Format d'URL de base :

http://192.168.1.2:11434/api

Remarque importante

- Doit utiliser le protocole

http(pas https) - Doit utiliser le port

11434 - Doit ajouter

/apià la fin

Exemple : http://192.168.1.2:11434/api (où 192.168.1.2 est l'IP de votre ordinateur)

Pourquoi choisir Ollama ?

- Entièrement gratuit : Pas besoin d'acheter de clé API

- Protection de la vie privée : Toutes les données de conversation sont traitées localement

- Utilisation hors ligne : Aucune connexion réseau requise

- Support multi-modèles : Prend en charge Llama, Mistral, DeepSeek, etc.

Exigences

- Un ordinateur (ce tutoriel utilise macOS comme exemple, Windows et Linux fonctionnent également)

- Téléphone et ordinateur sur le même réseau Wi-Fi

- L'ordinateur doit rester allumé et connecté au Wi-Fi lors de l'utilisation

Étapes (Exemple macOS)

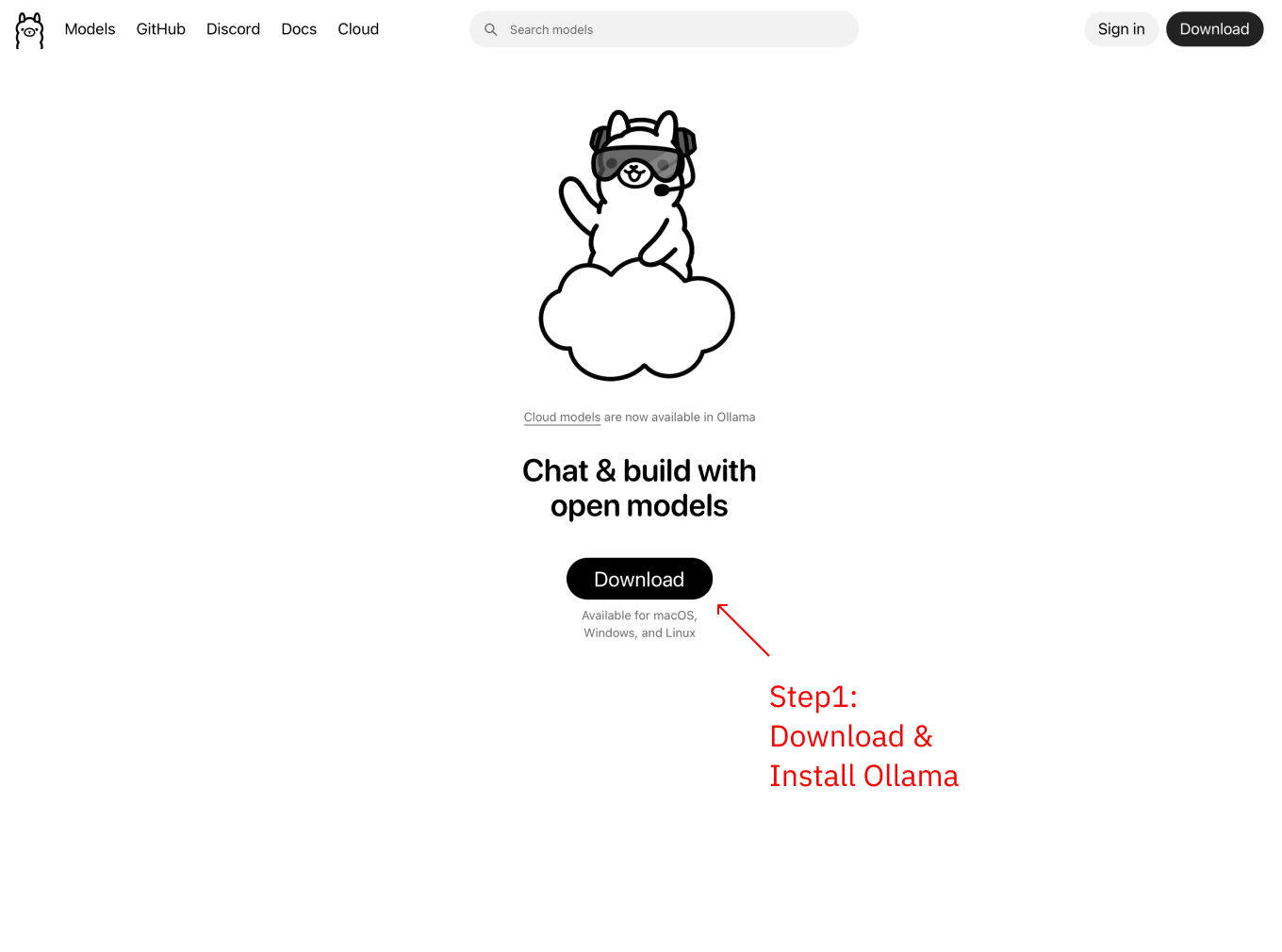

Étape 1 : Télécharger et installer Ollama

Visitez https://ollama.com pour télécharger et installer Ollama

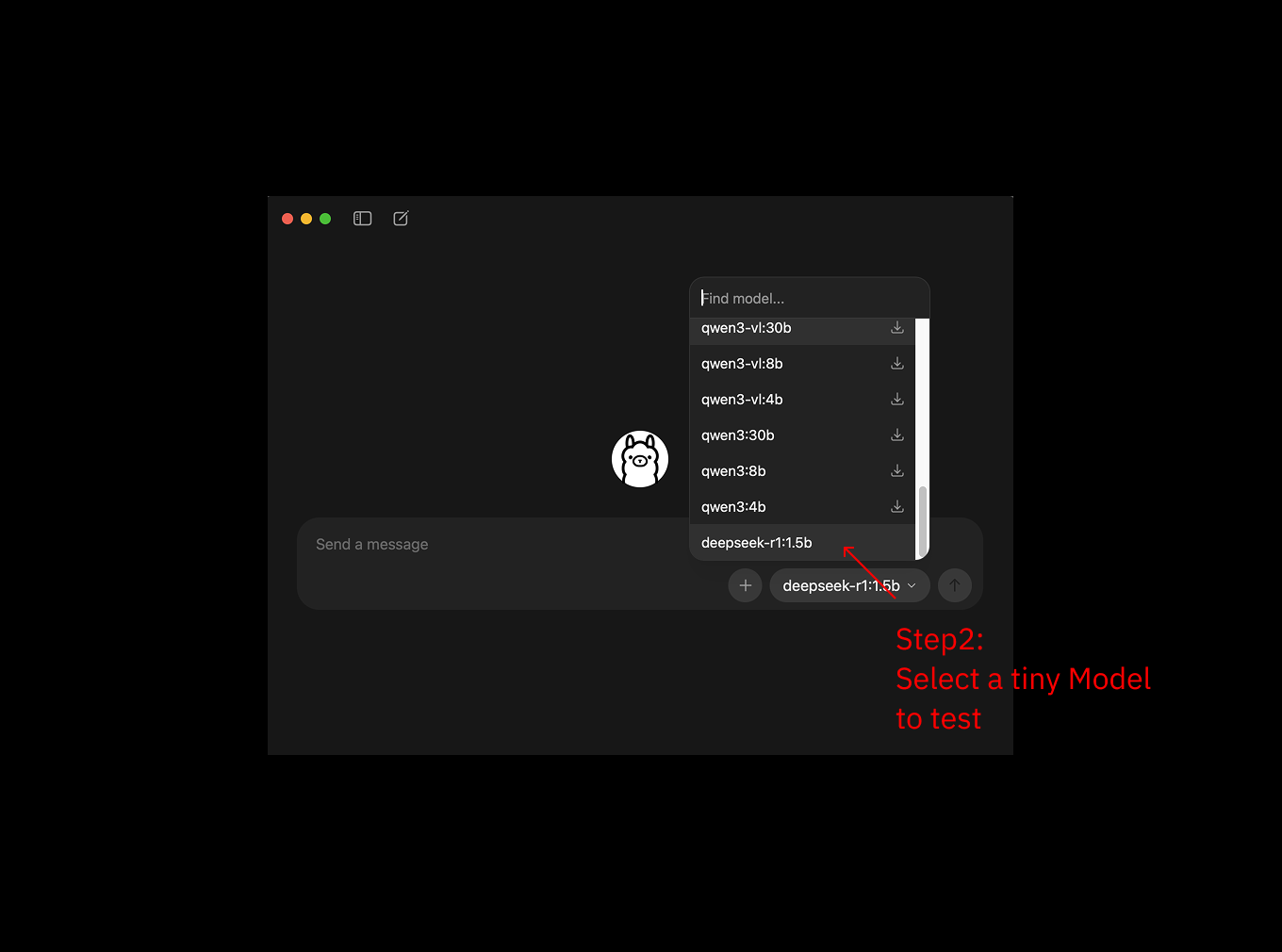

Étape 2 : Télécharger le modèle

Ouvrez le terminal et téléchargez un petit modèle pour les tests (par exemple, deepseek-r1:1.5b, environ 1 Go) :

ollama pull deepseek-r1:1.5b

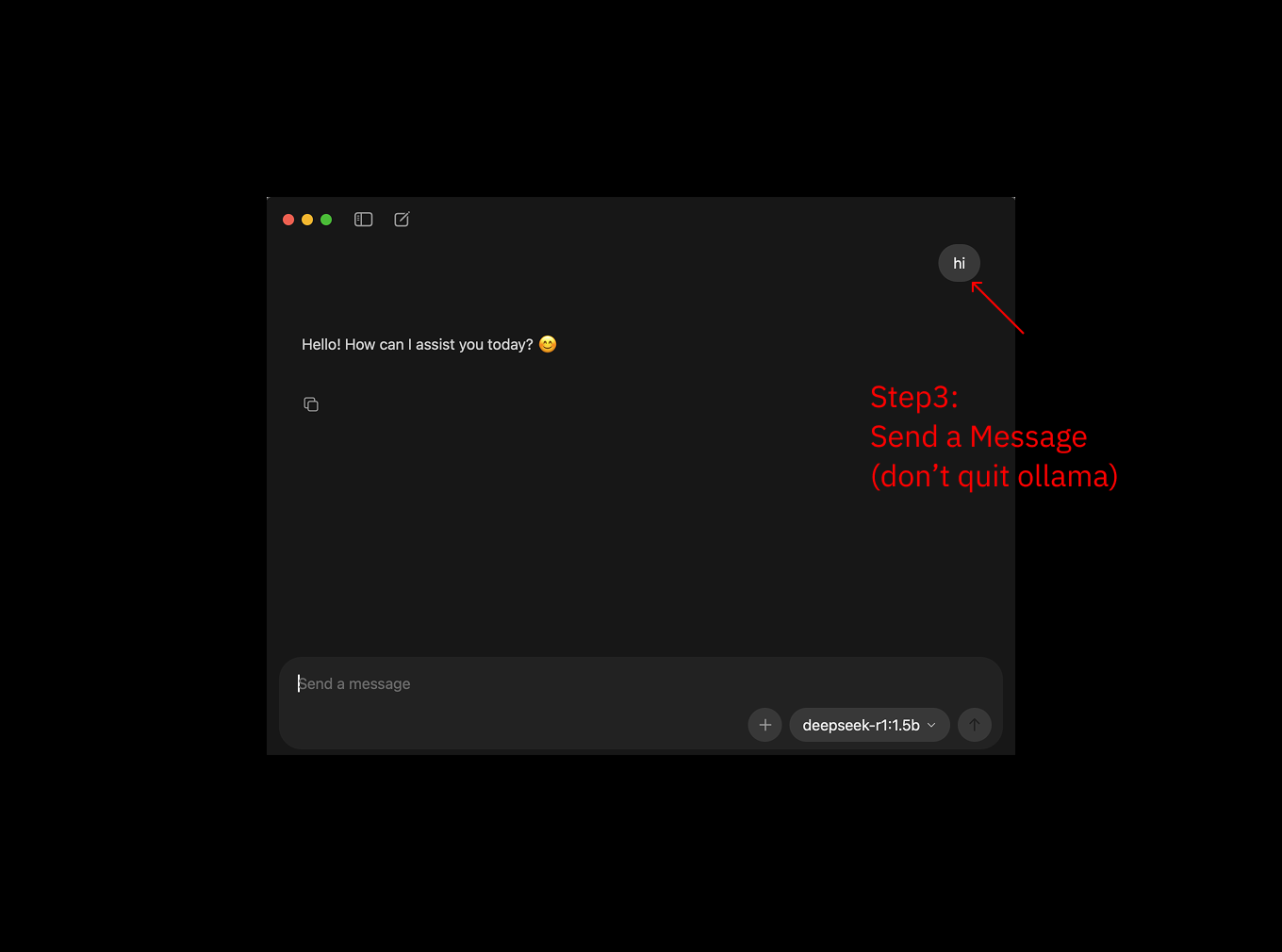

Étape 3 : Exécuter le modèle

Après la fin du téléchargement, exécutez le modèle :

ollama serve

ollama run deepseek-r1:1.5bLe premier démarrage sera plus lent, ensuite vous pourrez discuter avec le modèle directement dans le terminal pour les tests

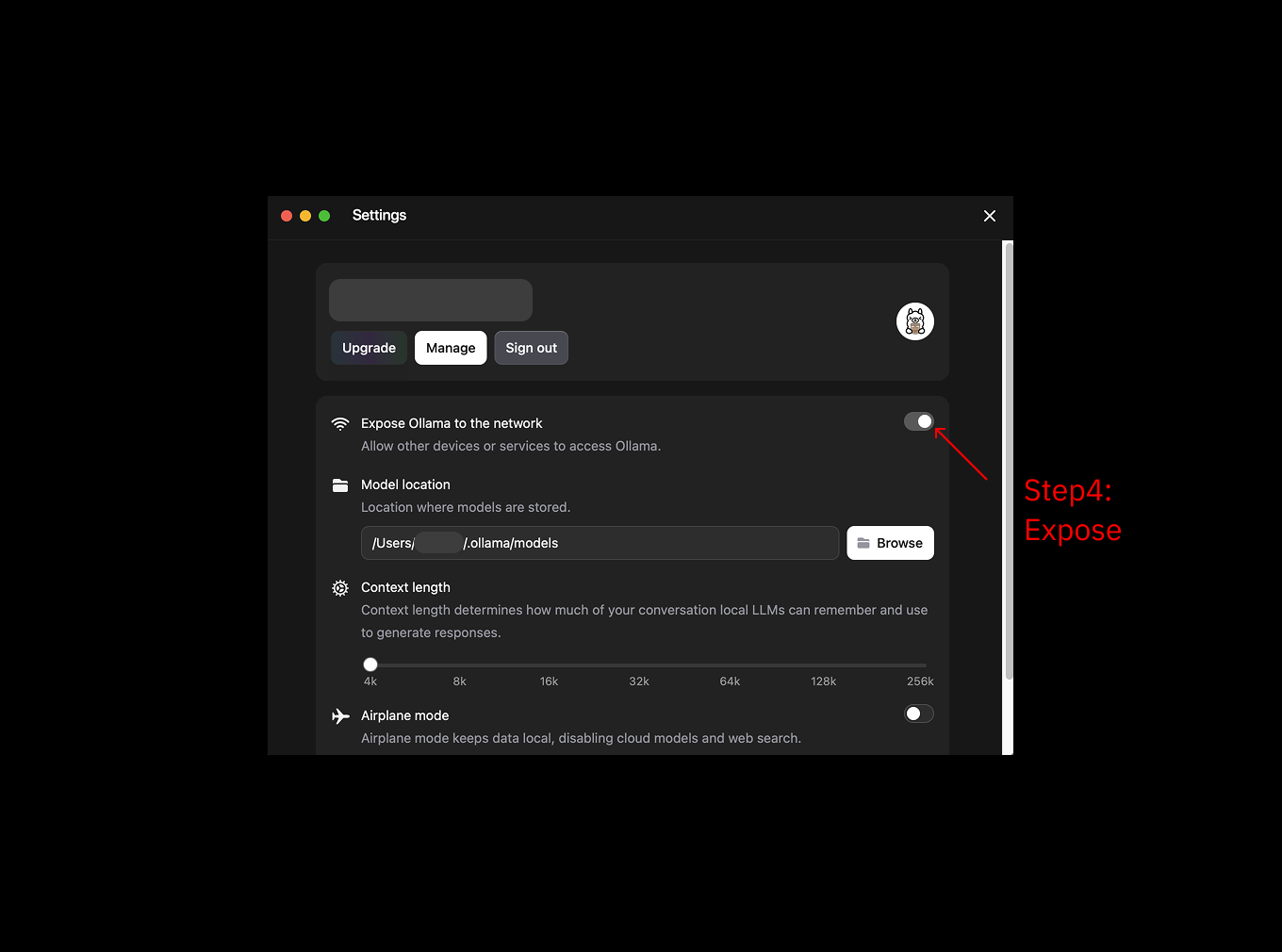

Étape 4 : Activer l'accès LAN

Activez l'accès LAN dans les paramètres Ollama pour permettre au téléphone de se connecter à Ollama sur votre ordinateur

Pourquoi est-ce nécessaire ?

- MiniTavern s'exécute sur le téléphone et doit accéder à Ollama sur l'ordinateur via LAN

- Par défaut, Ollama n'autorise que l'accès local

- Après activation, les appareils sur le même Wi-Fi peuvent y accéder

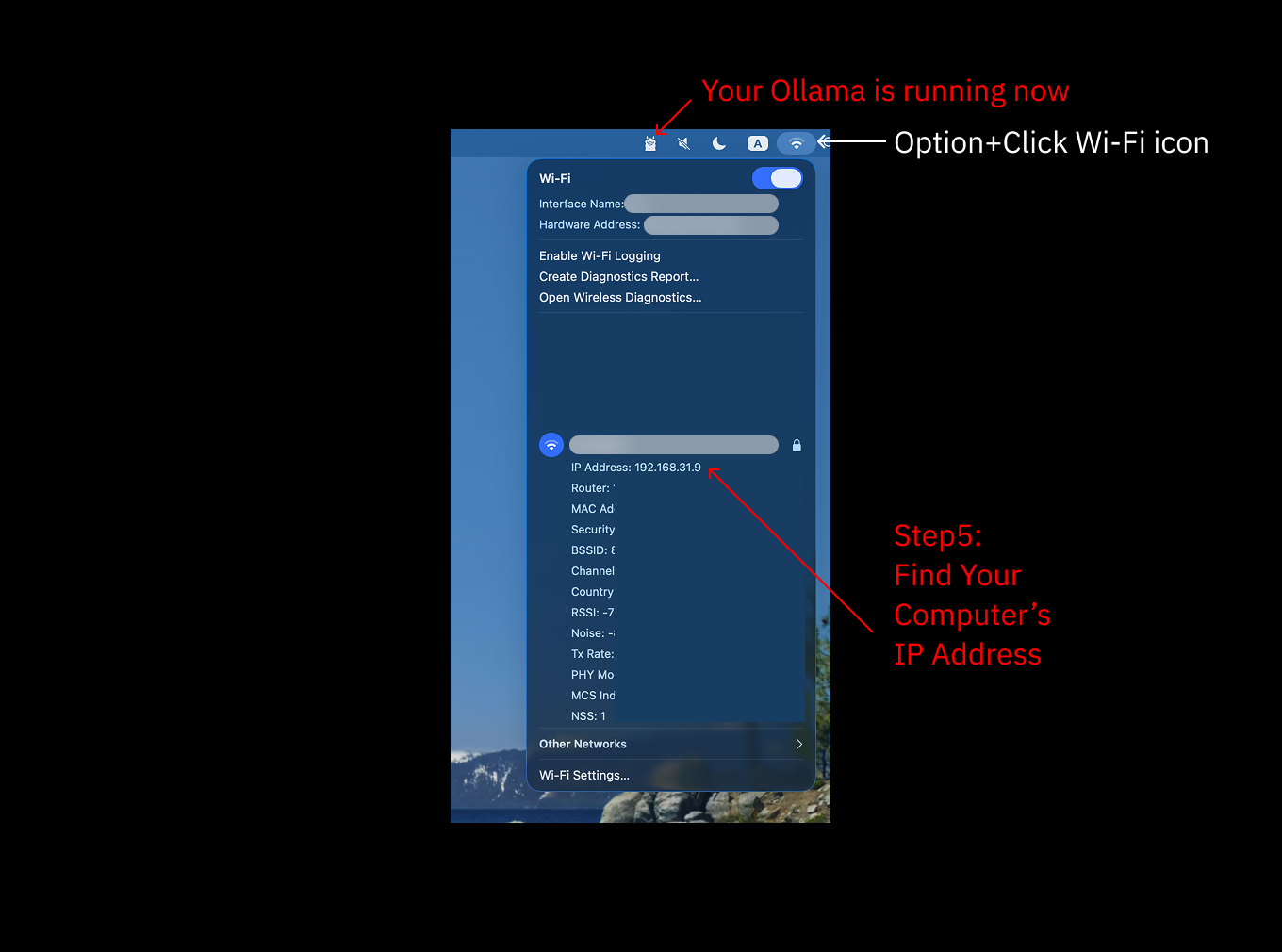

Étape 5 : Obtenir l'adresse IP de l'ordinateur

Vérifiez l'adresse IP de votre ordinateur dans les paramètres système (commence généralement par 192.168)

Méthode de vérification IP macOS :

Paramètres système → Réseau → Wi-Fi → Détails → TCP/IP → Adresse IPv4

Ou utilisez la commande terminal :

ifconfig | grep "inet " | grep -v 127.0.0.1Étape 6 : Configurer dans MiniTavern

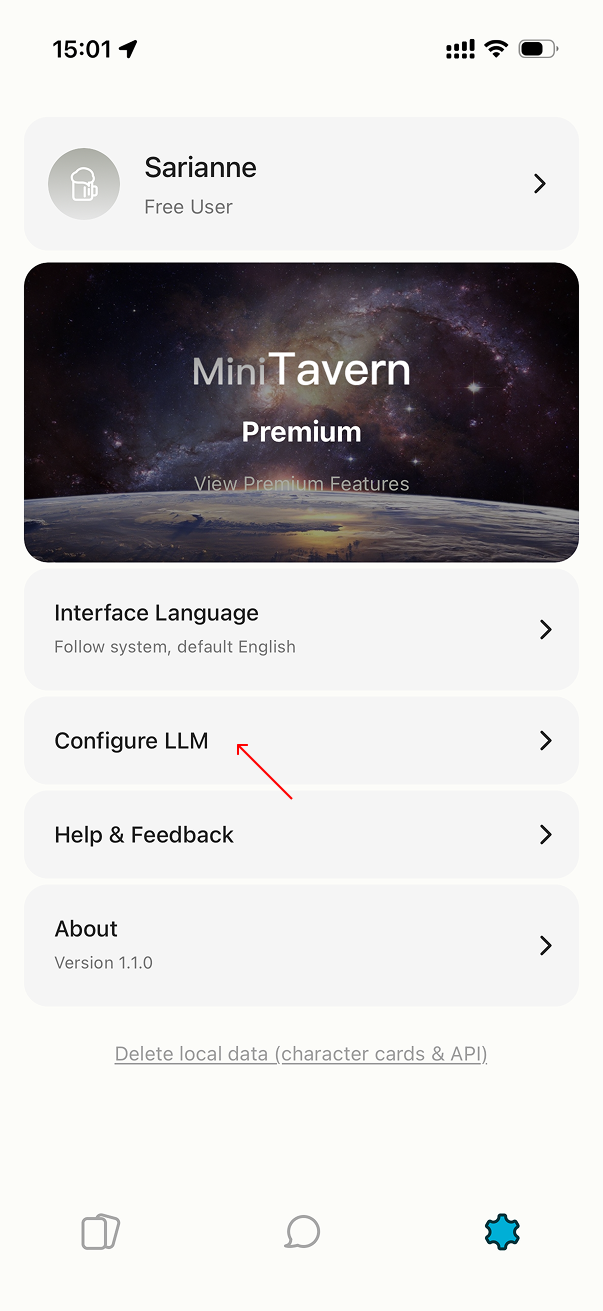

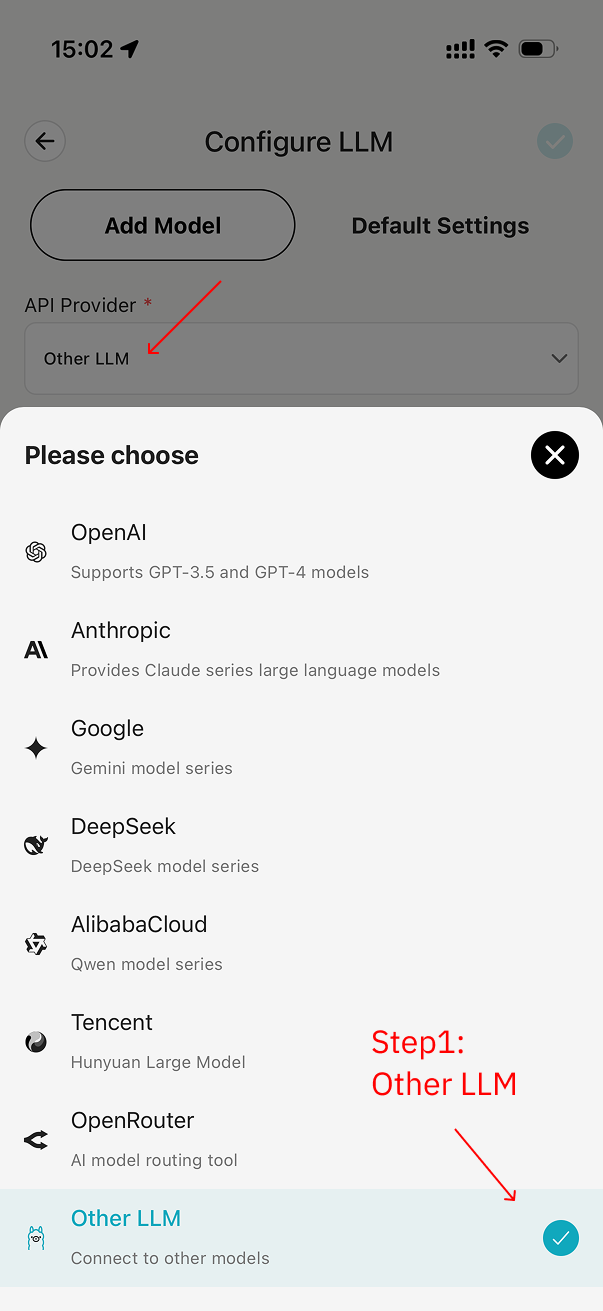

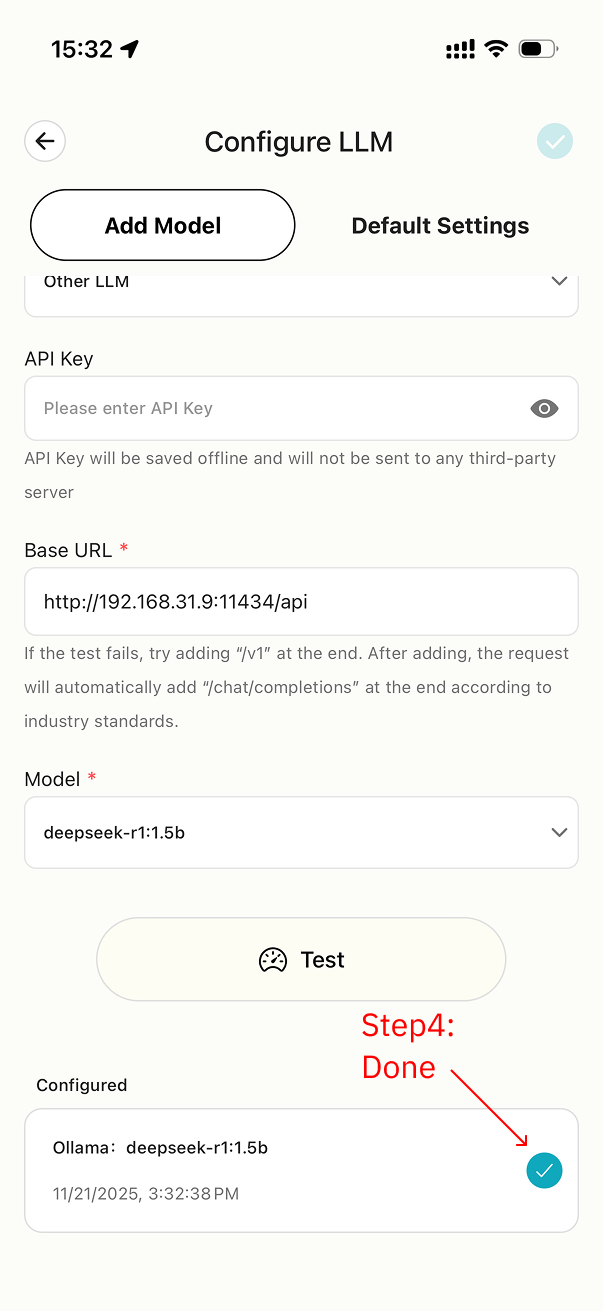

6.1 Sélectionner le fournisseur Other LLM

Ouvrez MiniTavern → Paramètres → Paramètres LLM → Fournisseur IA → Sélectionnez Other

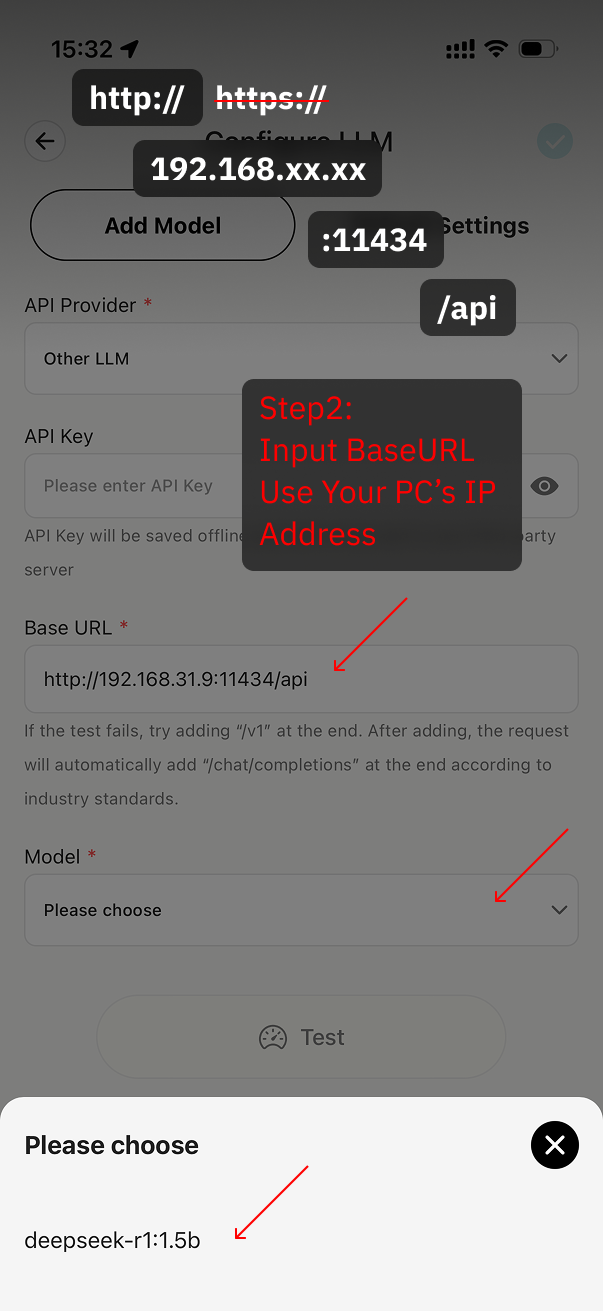

6.2 Entrer l'URL de base Ollama

Entrez l'URL de base Ollama : http://your-computer-IP:11434/api

Exemple : http://192.168.1.2:11434/api

Remarque importante

- Doit utiliser

http(pas https) - Le port doit être

11434 - Doit ajouter

/apià la fin

Cliquez sur Obtenir la liste des modèles

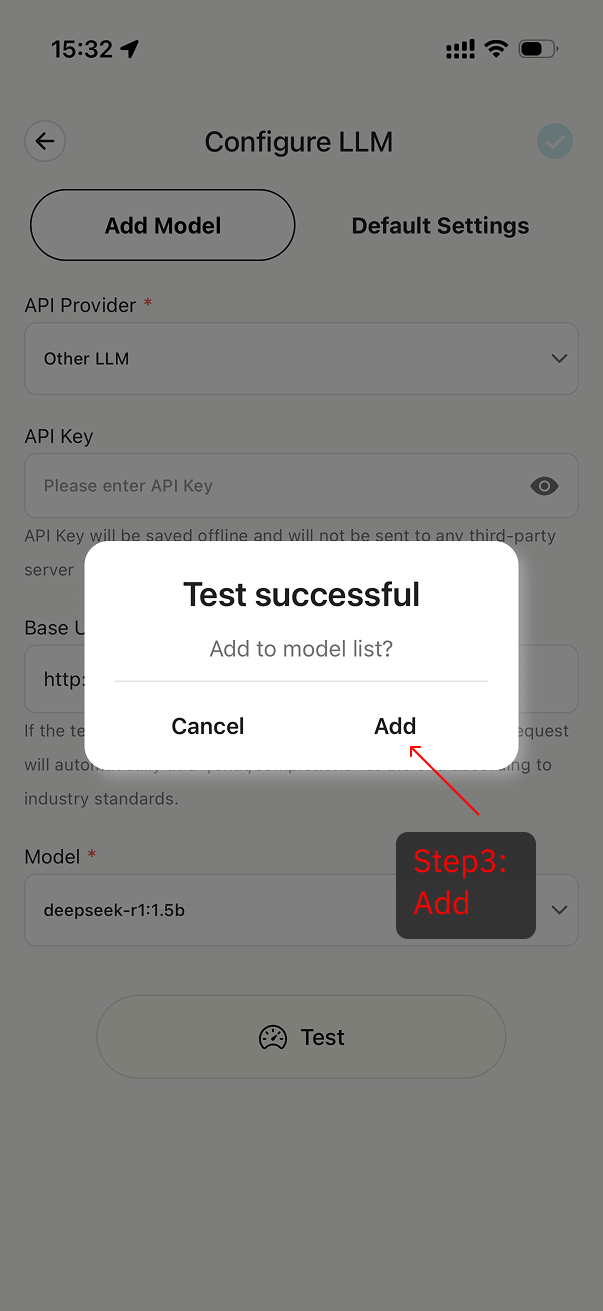

6.3 Tester la connexion

Après avoir sélectionné le modèle, cliquez sur Tester la connexion pour vérifier que la configuration est correcte

Si impossible de se connecter :

- Vérifiez si Ollama est en cours d'exécution

- Confirmez que l'adresse IP est correcte

- Assurez-vous que le téléphone et l'ordinateur sont sur le même Wi-Fi

- Vérifiez si le format de l'URL de base est correct

6.4 Ajout terminé

Après un test réussi, cliquez sur enregistrer, ajout du modèle terminé

Installer Ollama avec Brew

brew install ollamaCommandes Ollama courantes

# Afficher tous les modèles téléchargés

ollama list

# Télécharger le modèle d'exemple du tutoriel

ollama pull deepseek-r1:1.5b

# Démarrer le service Ollama

ollama serve

# Exécuter le modèle spécifié dans un nouveau processus

ollama run deepseek-r1:1.5b

# Arrêter le service Ollama

Ctrl + CFAQ

Q : Mauvaise qualité de conversation ?

R :

- Essayez d'utiliser des modèles plus grands (7B ou plus)

- Essayez différentes cartes de personnages