3.6 Локальный бесплатный ИИ: Ollama

Ollama — это бесплатный инструмент, который поддерживает запуск моделей ИИ локально. Используя Ollama, вы можете использовать ИИ совершенно бесплатно и в автономном режиме без покупки ключа API.

Основная информация о конфигурации

При настройке Ollama вам необходимо найти следующую основную информацию:

- IP-адрес хоста: обычно начинается с

192.168(например,192.168.1.2) - Формат базового URL:

http://192.168.1.2:11434/api

Важное примечание

- Должен использоваться протокол

http(не https) - Должен использоваться порт

11434 - В конце необходимо добавить

/api

Пример: http://192.168.1.2:11434/api (где 192.168.1.2 — IP-адрес вашего компьютера)

Почему стоит выбрать Ollama?

- Совершенно бесплатно: нет необходимости покупать ключ API

- Защита конфиденциальности: все данные разговоров обрабатываются локально

- Автономное использование: подключение к сети не требуется

- Поддержка нескольких моделей: поддерживает Llama, Mistral, DeepSeek и др.

Требования

- Компьютер (в этом руководстве в качестве примера используется macOS, также подходят Windows и Linux)

- Телефон и компьютер в одной сети Wi-Fi

- Компьютер должен оставаться включенным и подключенным к Wi-Fi во время использования

Шаги (на примере macOS)

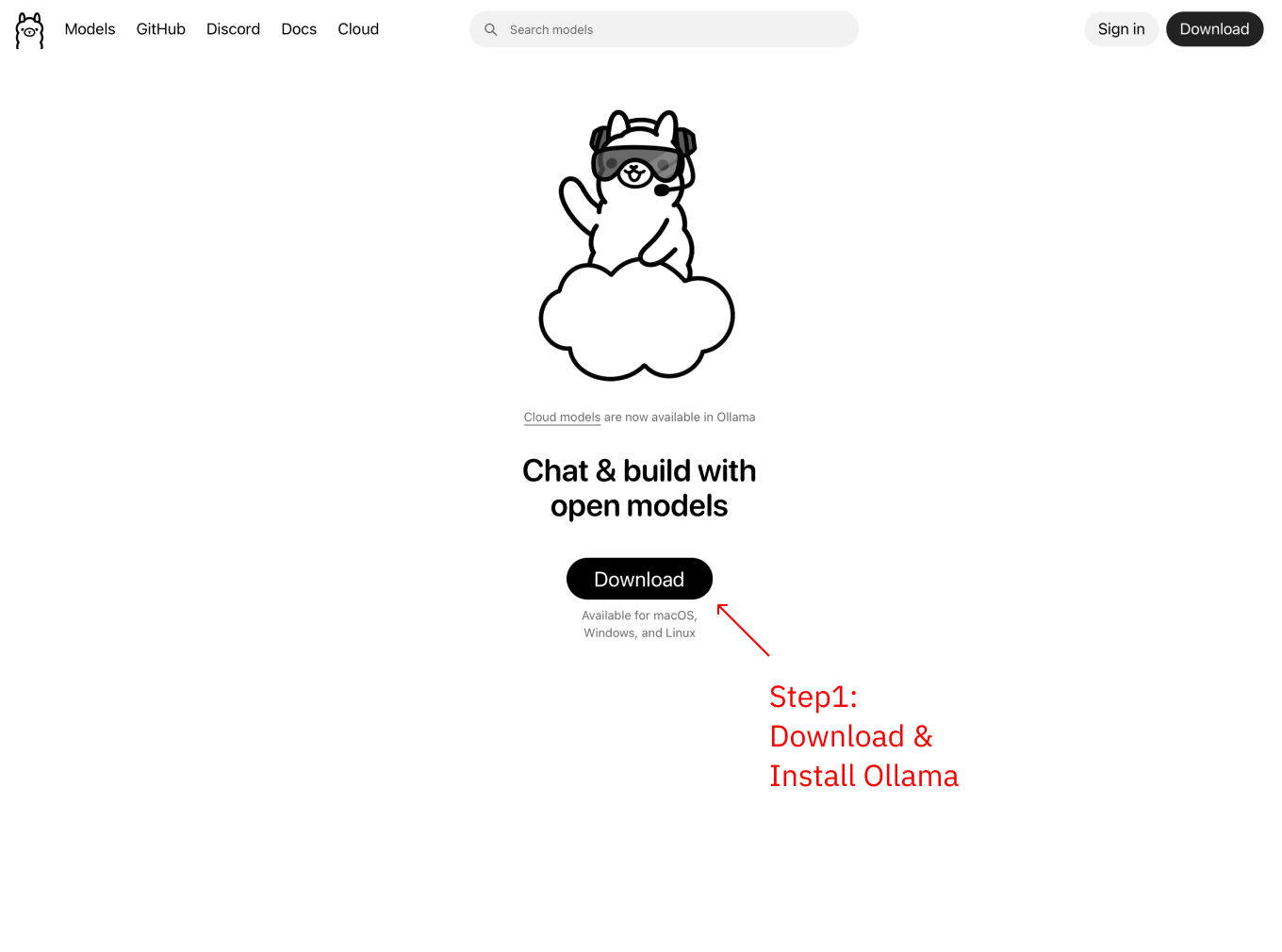

Шаг 1: Загрузка и установка Ollama

Посетите https://ollama.com, чтобы загрузить и установить Ollama.

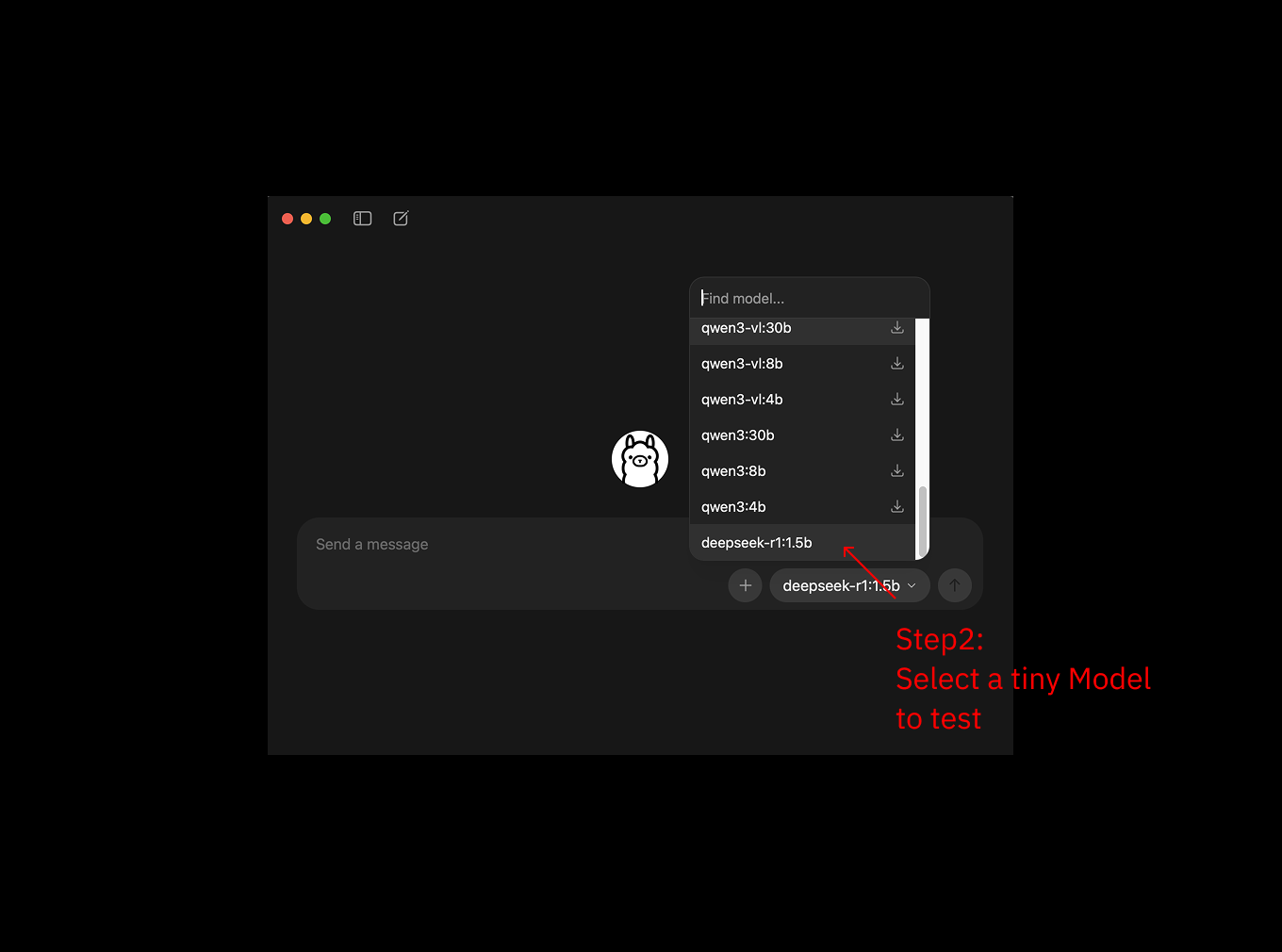

Шаг 2: Загрузка модели

Откройте терминал и загрузите небольшую модель для тестирования (например, deepseek-r1:1.5b, около 1 ГБ):

ollama pull deepseek-r1:1.5b

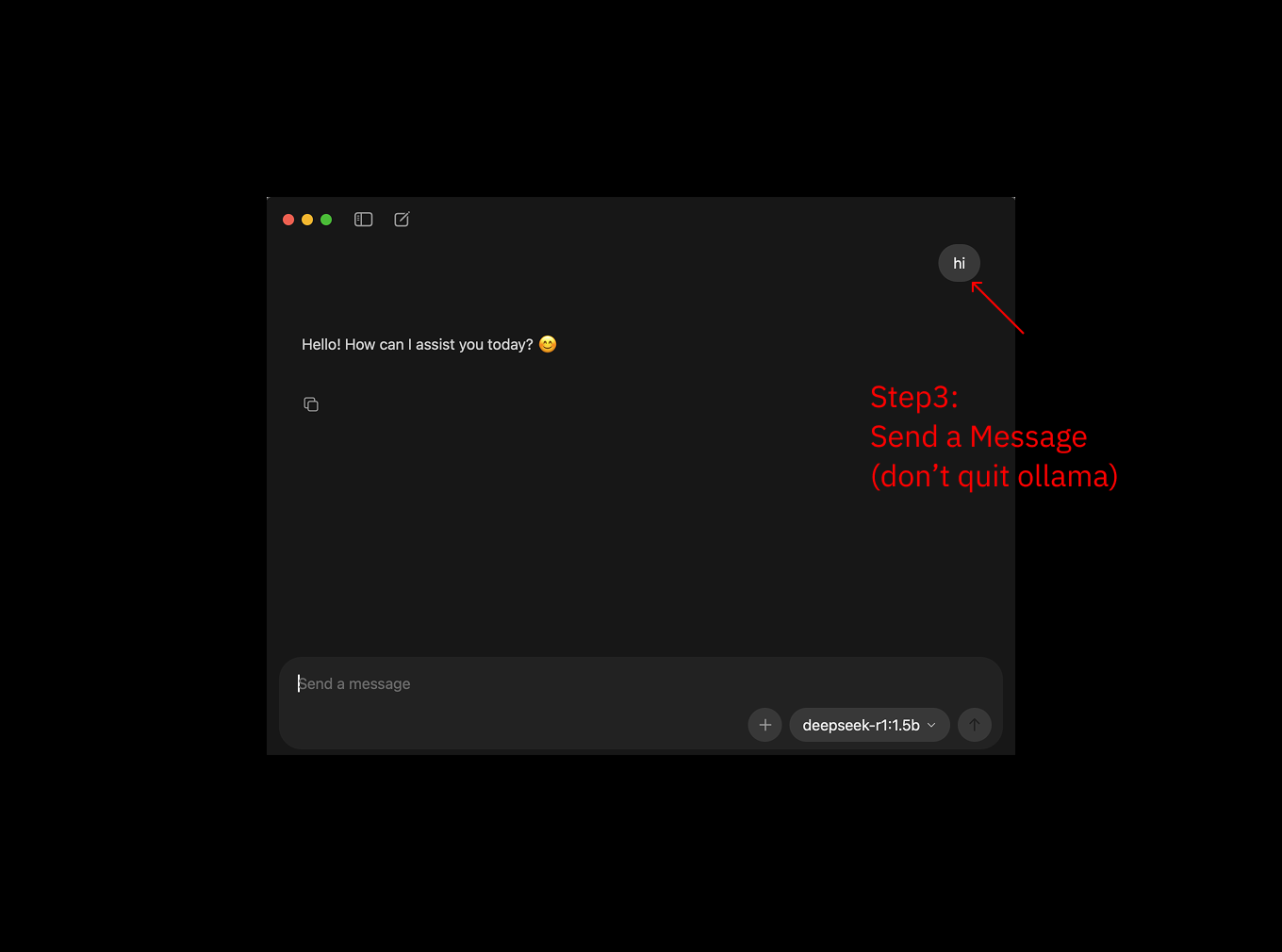

Шаг 3: Запуск модели

После завершения загрузки запустите модель:

ollama serve

ollama run deepseek-r1:1.5bПервый запуск будет медленнее, после чего вы сможете общаться с моделью прямо в терминале для тестирования.

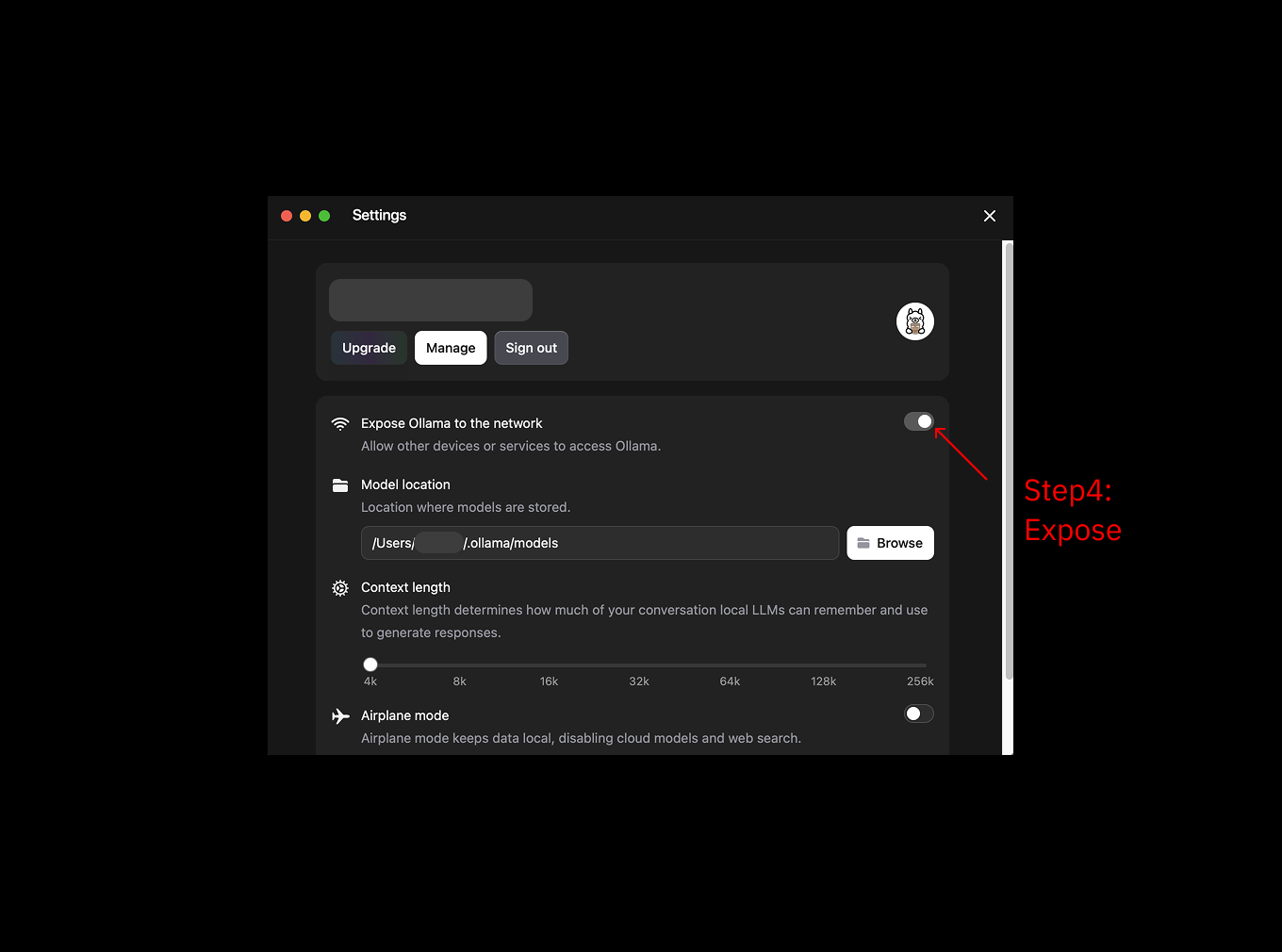

Шаг 4: Включение доступа по локальной сети

Включите доступ по локальной сети в настройках Ollama, чтобы телефон мог подключиться к Ollama на вашем компьютере.

Зачем это нужно?

- MiniTavern работает на телефоне и должен иметь доступ к Ollama на компьютере через локальную сеть.

- По умолчанию Ollama разрешает только локальный доступ.

- После включения устройства в той же сети Wi-Fi смогут получить к нему доступ.

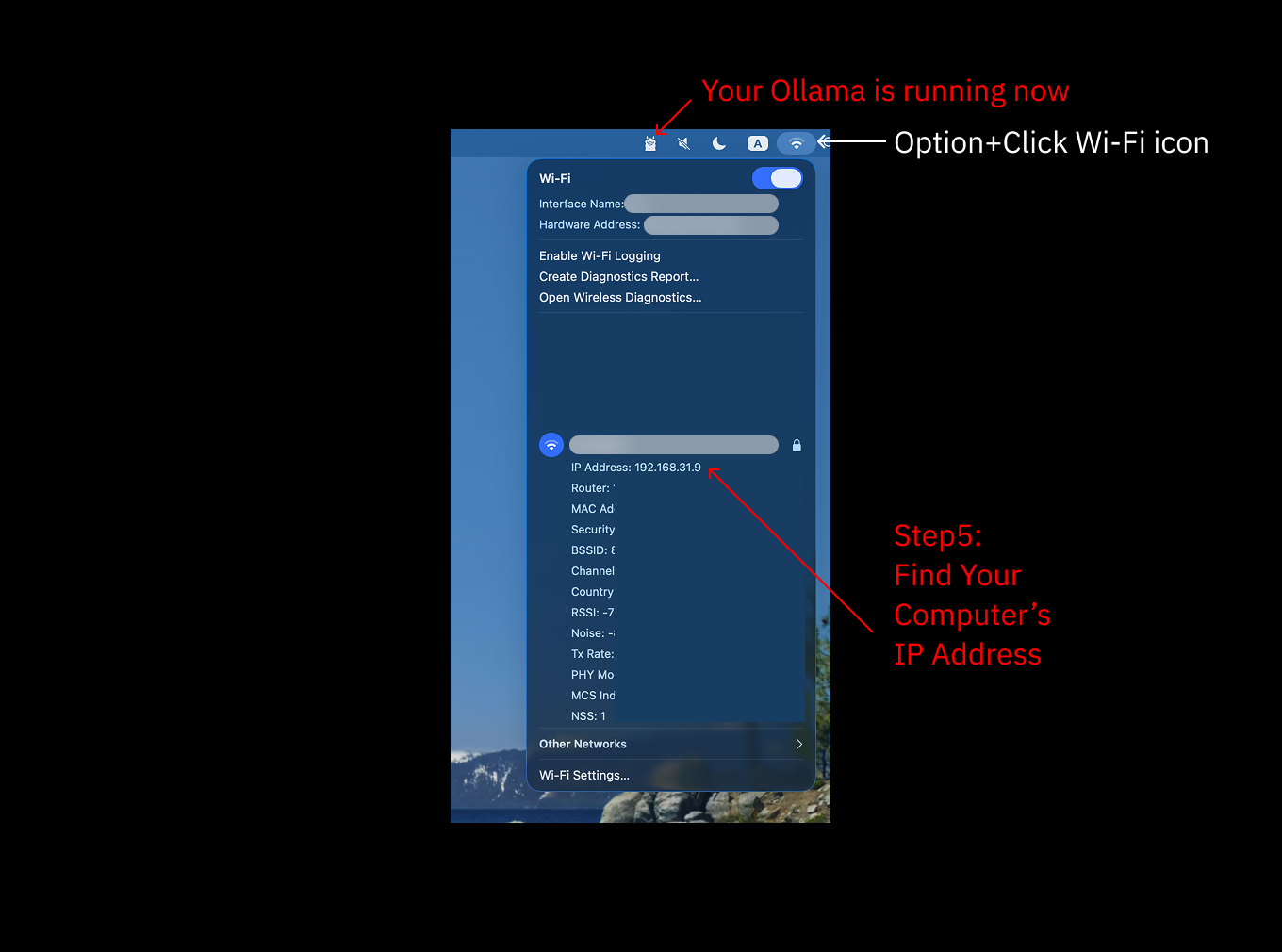

Шаг 5: Получение IP-адреса компьютера

Проверьте IP-адрес вашего компьютера в настройках системы (обычно начинается с 192.168).

Способ проверки IP в macOS:

Настройки системы → Сеть → Wi-Fi → Подробнее → TCP/IP → IPv4-адрес

Или используйте команду терминала:

ifconfig | grep "inet " | grep -v 127.0.0.1Шаг 6: Настройка в MiniTavern

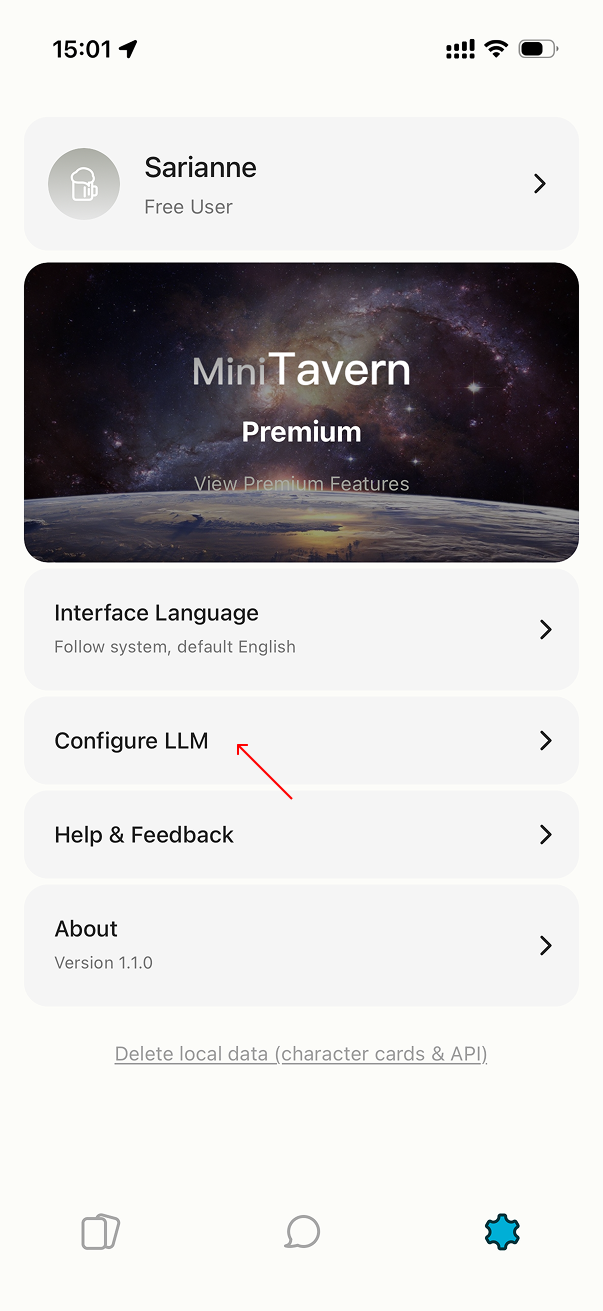

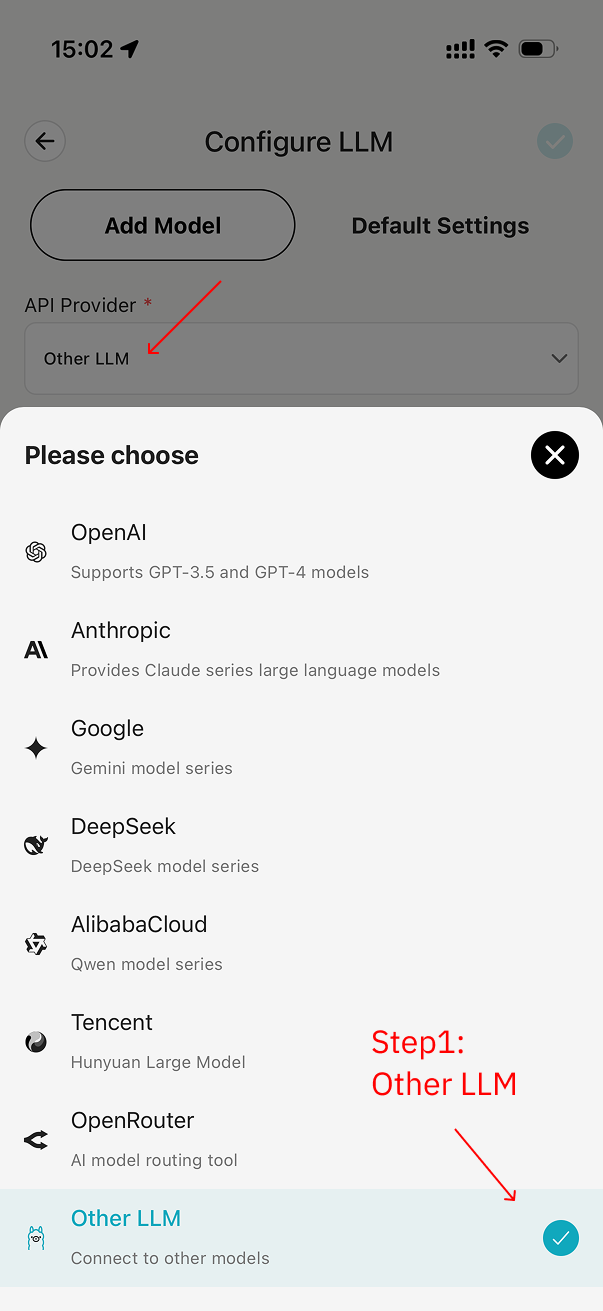

6.1 Выбор провайдера Other LLM

Откройте MiniTavern → Настройки → Настройки LLM → Провайдер ИИ → Выберите Other

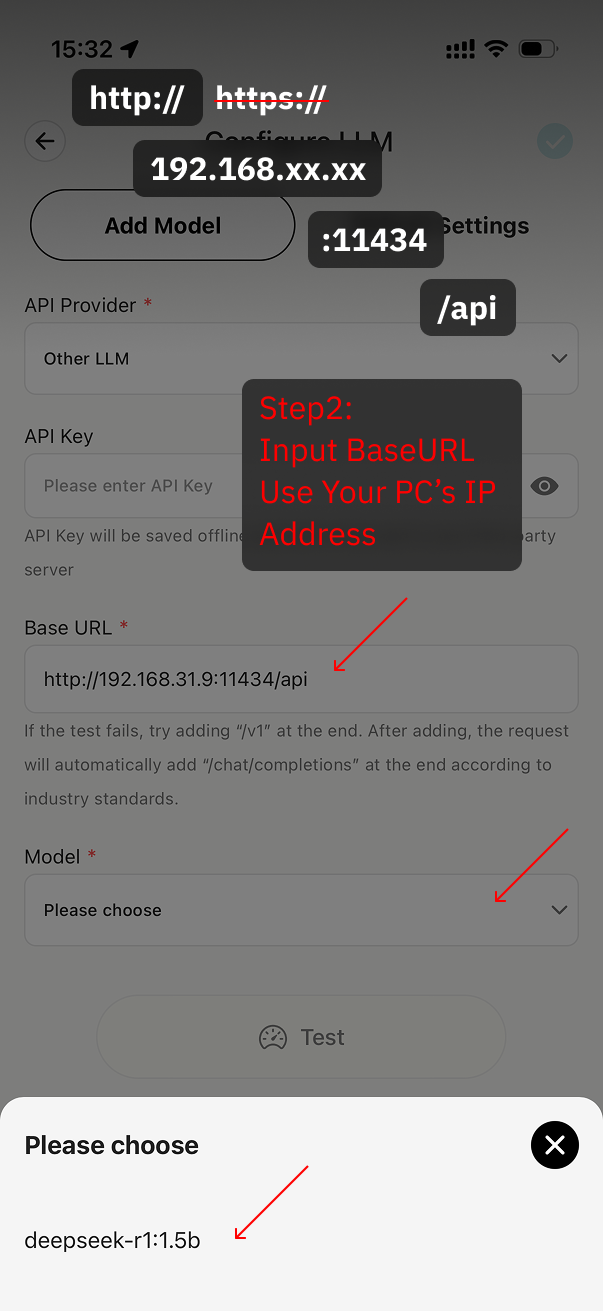

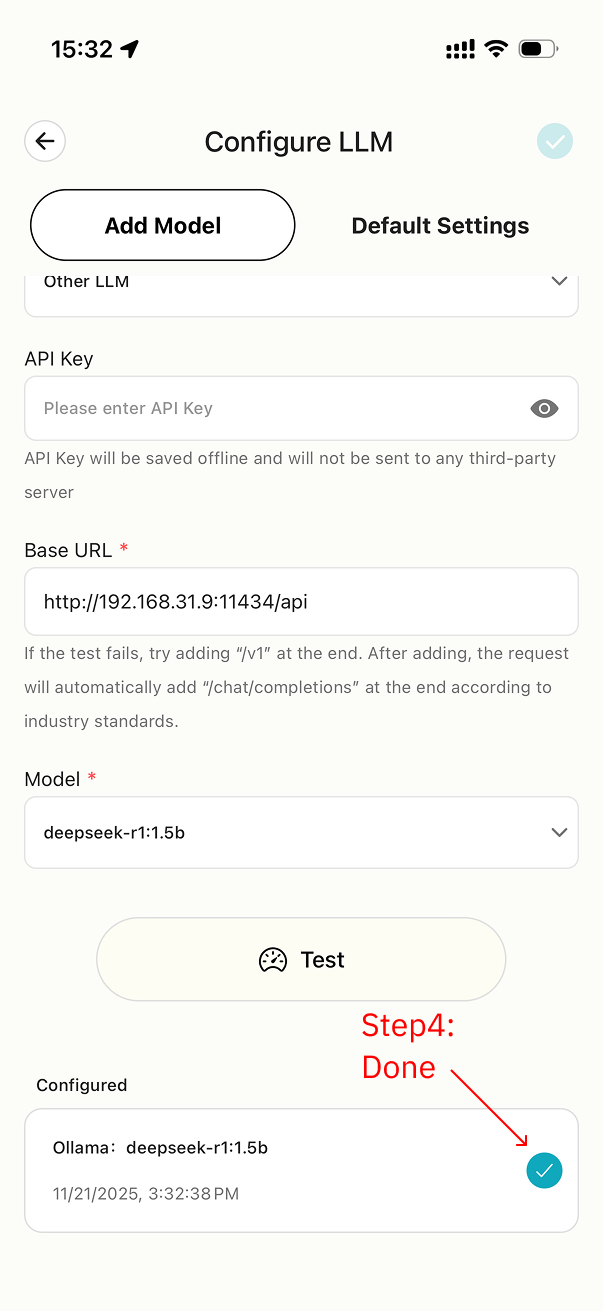

6.2 Ввод базового URL Ollama

Введите базовый URL Ollama: http://IP-вашего-компьютера:11434/api

Пример: http://192.168.1.2:11434/api

Важное примечание

- Должен использоваться

http(не https) - Порт должен быть

11434 - В конце необходимо добавить

/api

Нажмите Получить список моделей

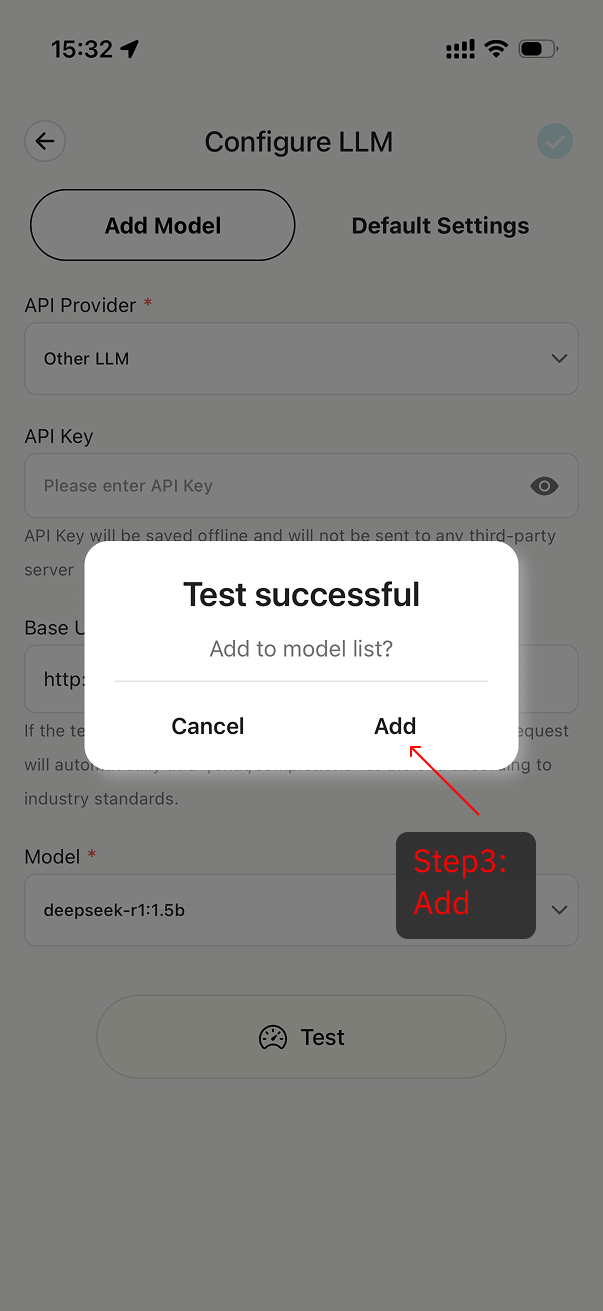

6.3 Проверка соединения

После выбора модели нажмите Проверить соединение, чтобы убедиться в правильности конфигурации.

Если не удается подключиться:

- Проверьте, запущен ли Ollama.

- Подтвердите правильность IP-адреса.

- Убедитесь, что телефон и компьютер находятся в одной сети Wi-Fi.

- Проверьте правильность формата базового URL.

6.4 Добавление завершено

После успешного теста нажмите «Сохранить», добавление модели завершено.

Установка Ollama с помощью Brew

brew install ollamaОбщие команды Ollama

# Просмотр всех загруженных моделей

ollama list

# Загрузка примера модели из руководства

ollama pull deepseek-r1:1.5b

# Запуск службы Ollama

ollama serve

# Запуск указанной модели в новом процессе

ollama run deepseek-r1:1.5b

# Остановка службы Ollama

Ctrl + CFAQ

В: Низкое качество разговора?

О:

- Попробуйте использовать более крупные модели (7B или выше).

- Попробуйте другие карточки персонажей.