3.6 Lokale kostenlose KI: Ollama

Ollama ist ein kostenloses Tool, das das lokale Ausführen von KI-Modellen unterstützt. Mit Ollama können Sie KI völlig kostenlos und offline nutzen, ohne einen API Key zu kaufen.

Kern-Konfigurationsinformationen

Bei der Konfiguration von Ollama müssen Sie die folgenden Kerninformationen finden:

- Host-IP-Adresse: Beginnt normalerweise mit

192.168(z.B.192.168.1.2) - Base URL Format:

http://192.168.1.2:11434/api

Wichtiger Hinweis

- Muss

http-Protokoll verwenden (nicht https) - Muss Port

11434verwenden - Muss am Ende

/apihinzufügen

Beispiel: http://192.168.1.2:11434/api (wobei 192.168.1.2 die IP Ihres Computers ist)

Warum Ollama wählen?

- Völlig kostenlos: Kein Kauf von API Key erforderlich

- Datenschutz: Alle Gesprächsdaten werden lokal verarbeitet

- Offline-Nutzung: Keine Netzwerkverbindung erforderlich

- Multi-Modell-Unterstützung: Unterstützt Llama, Mistral, DeepSeek, etc.

Anforderungen

- Ein Computer (dieses Tutorial verwendet macOS als Beispiel, Windows und Linux funktionieren auch)

- Telefon und Computer im selben Wi-Fi-Netzwerk

- Computer muss während der Nutzung eingeschaltet und mit Wi-Fi verbunden bleiben

Schritte (macOS Beispiel)

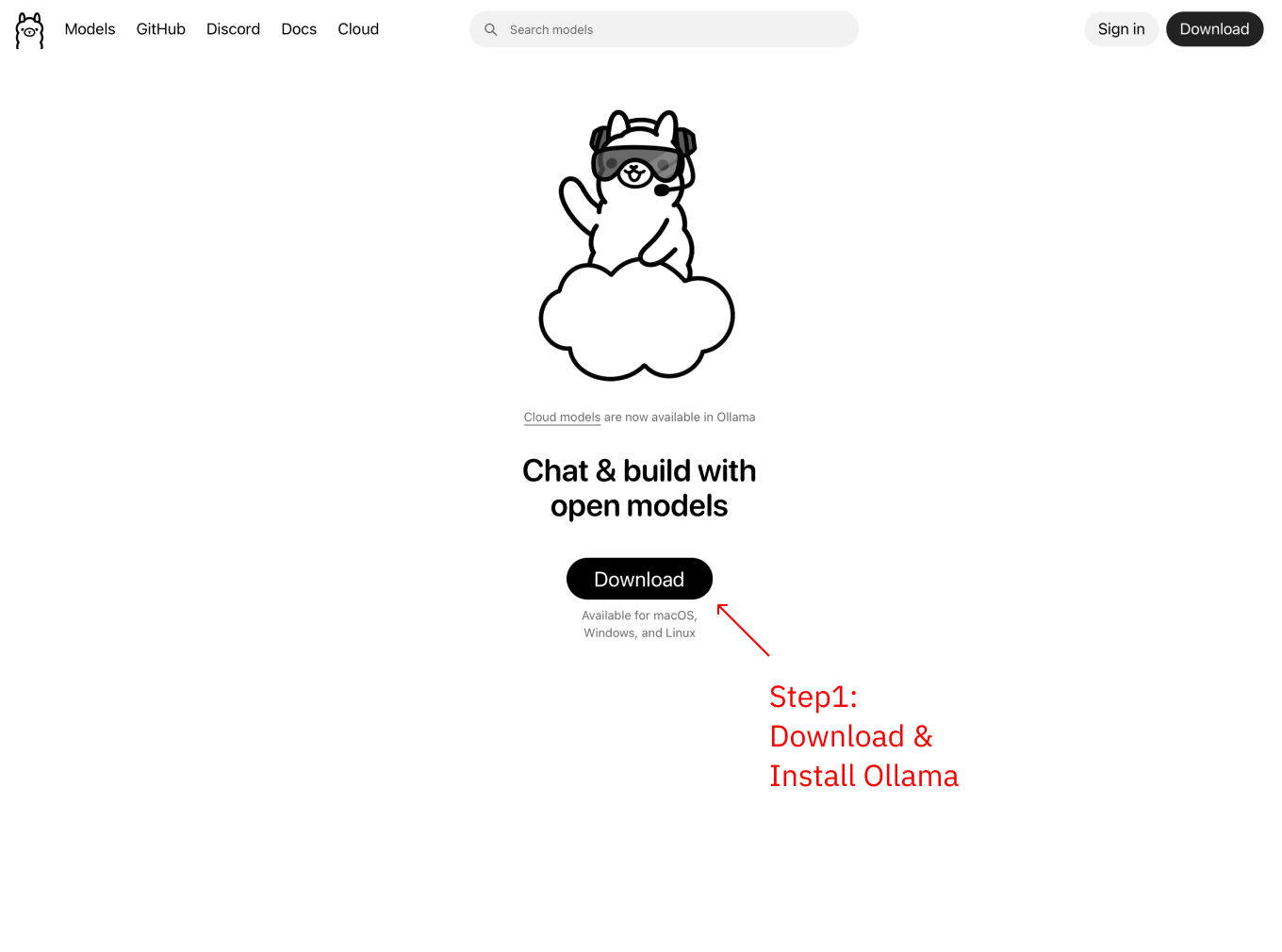

Schritt 1: Ollama herunterladen und installieren

Besuchen Sie https://ollama.com, um Ollama herunterzuladen und zu installieren

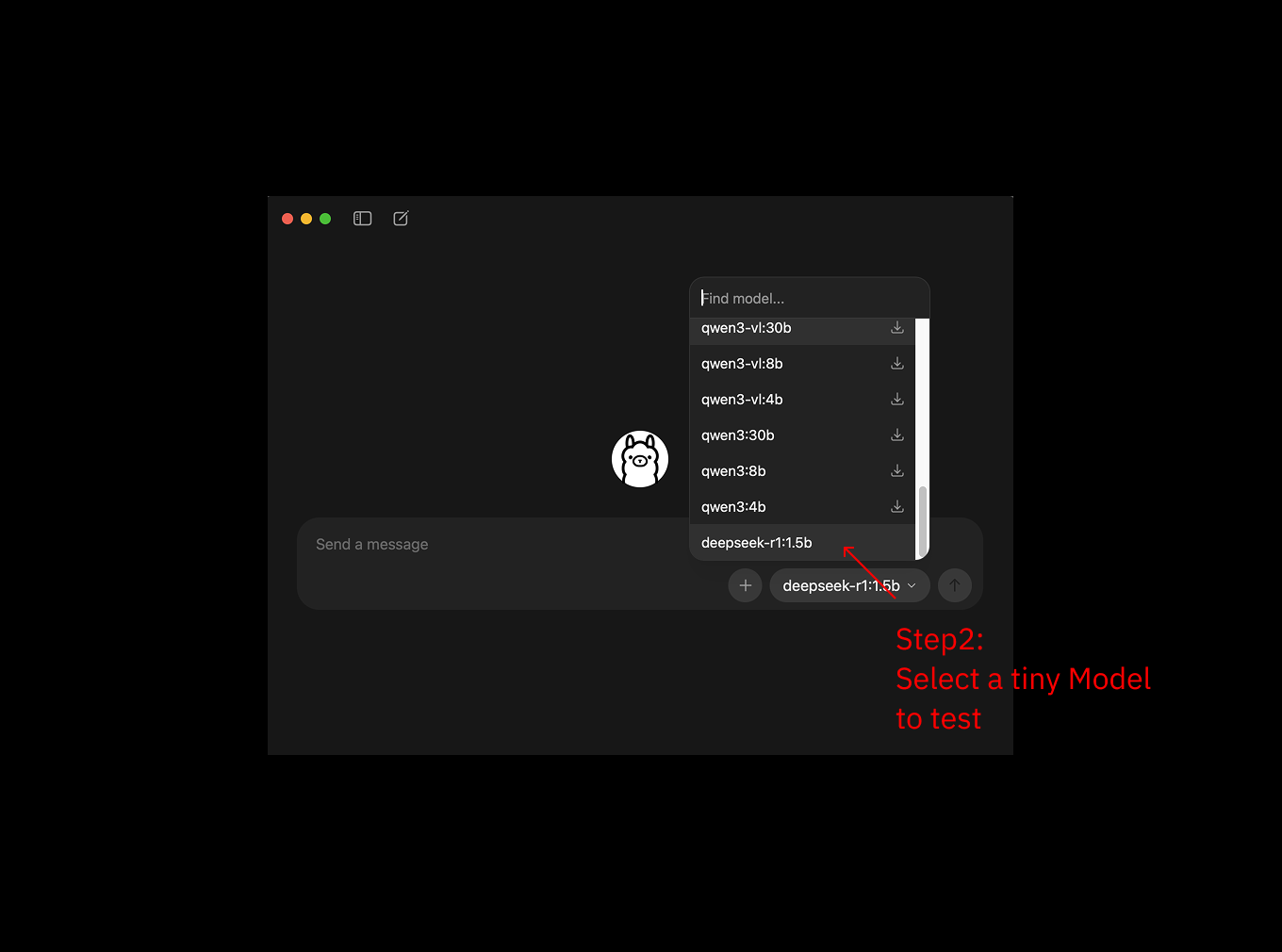

Schritt 2: Modell herunterladen

Öffnen Sie das Terminal und laden Sie ein kleines Modell zum Testen herunter (z.B. deepseek-r1:1.5b, etwa 1GB):

ollama pull deepseek-r1:1.5b

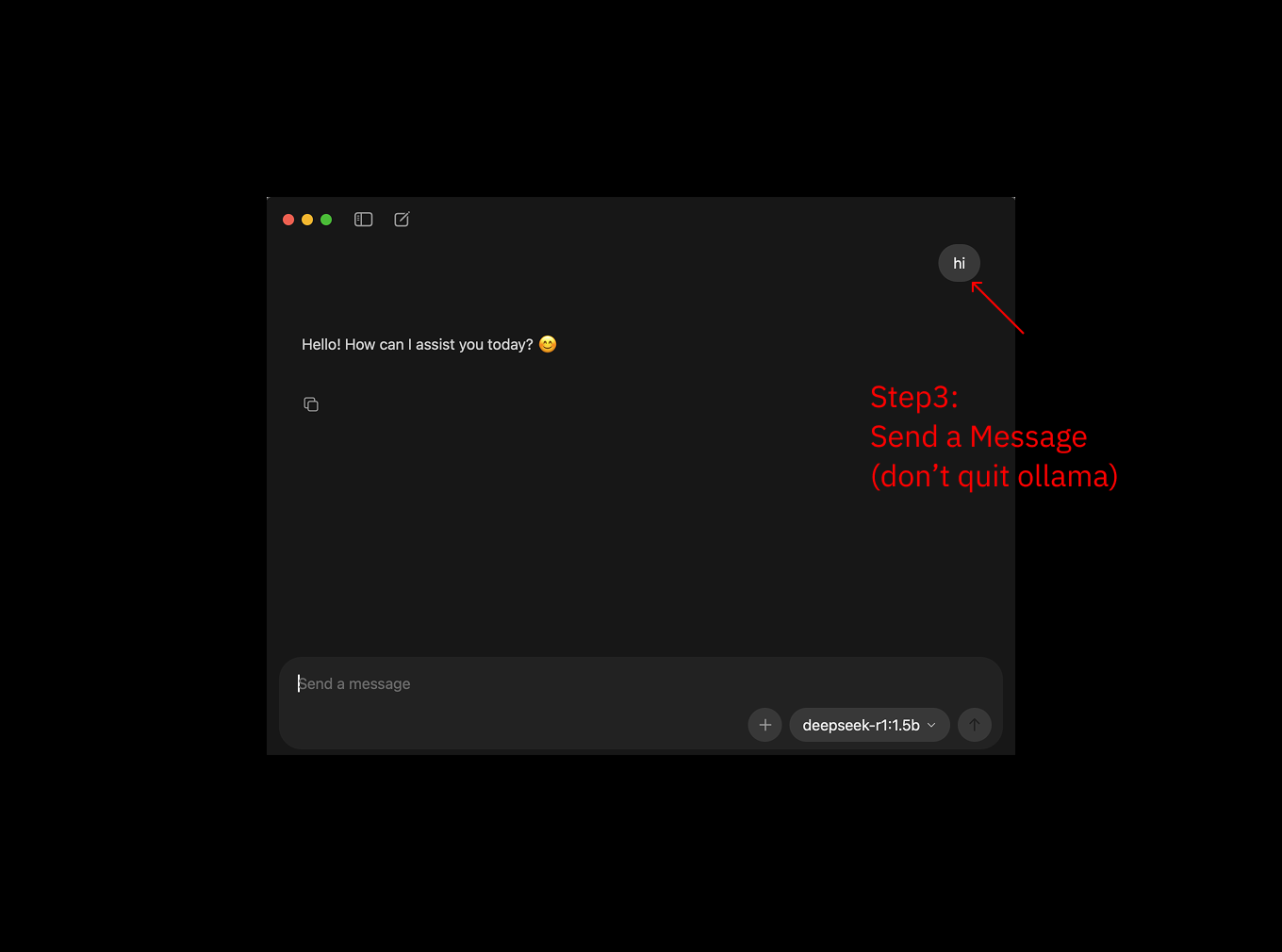

Schritt 3: Modell ausführen

Nach Abschluss des Downloads führen Sie das Modell aus:

ollama serve

ollama run deepseek-r1:1.5bDer erste Start wird langsamer sein, danach können Sie direkt im Terminal mit dem Modell zum Testen chatten

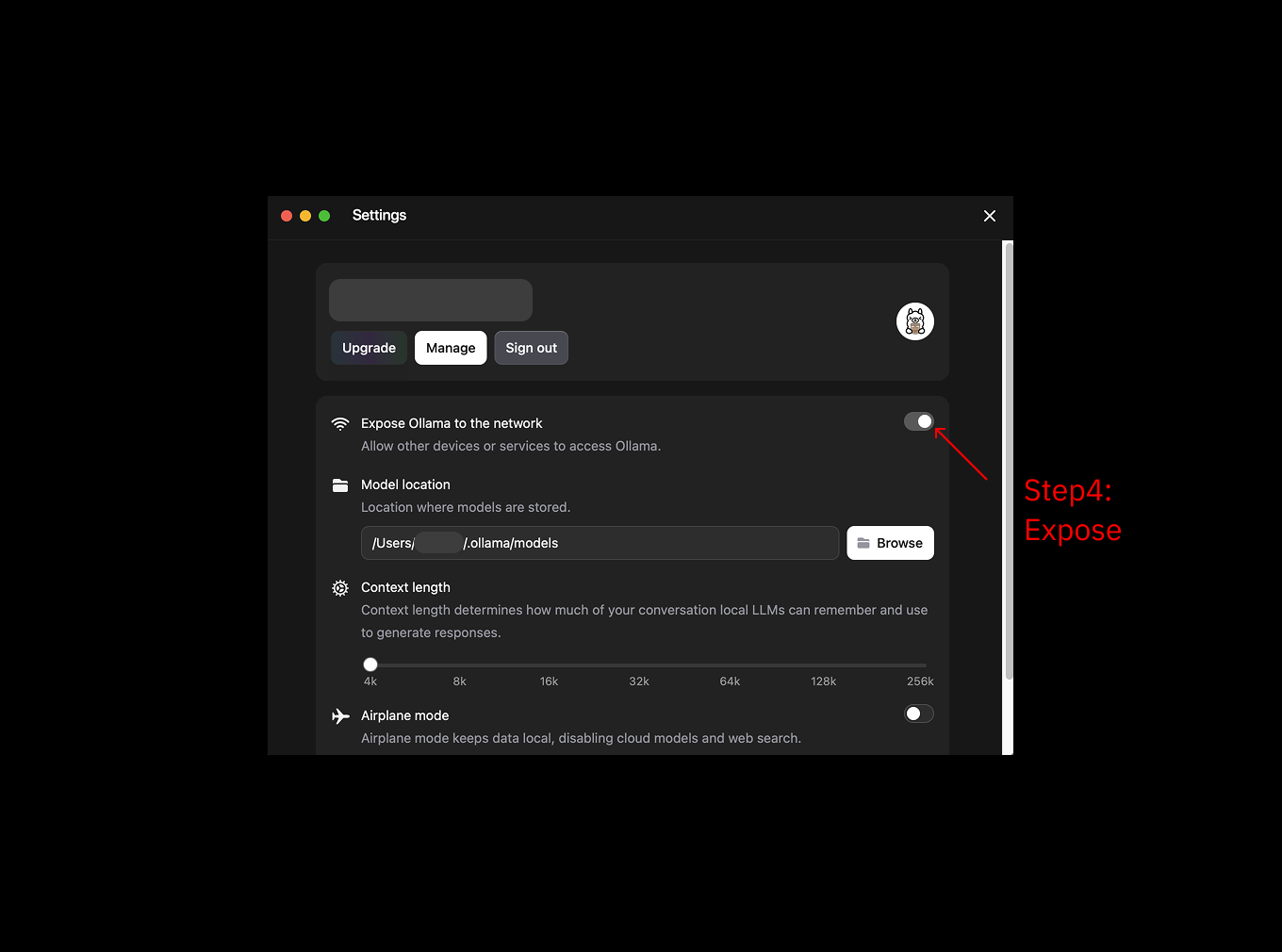

Schritt 4: LAN-Zugriff aktivieren

Aktivieren Sie den LAN-Zugriff in den Ollama-Einstellungen, um dem Telefon den Zugriff auf Ollama auf Ihrem Computer zu ermöglichen

Warum ist das erforderlich?

- MiniTavern läuft auf dem Telefon und muss über LAN auf Ollama auf dem Computer zugreifen

- Standardmäßig erlaubt Ollama nur lokalen Zugriff

- Nach der Aktivierung können Geräte im selben Wi-Fi darauf zugreifen

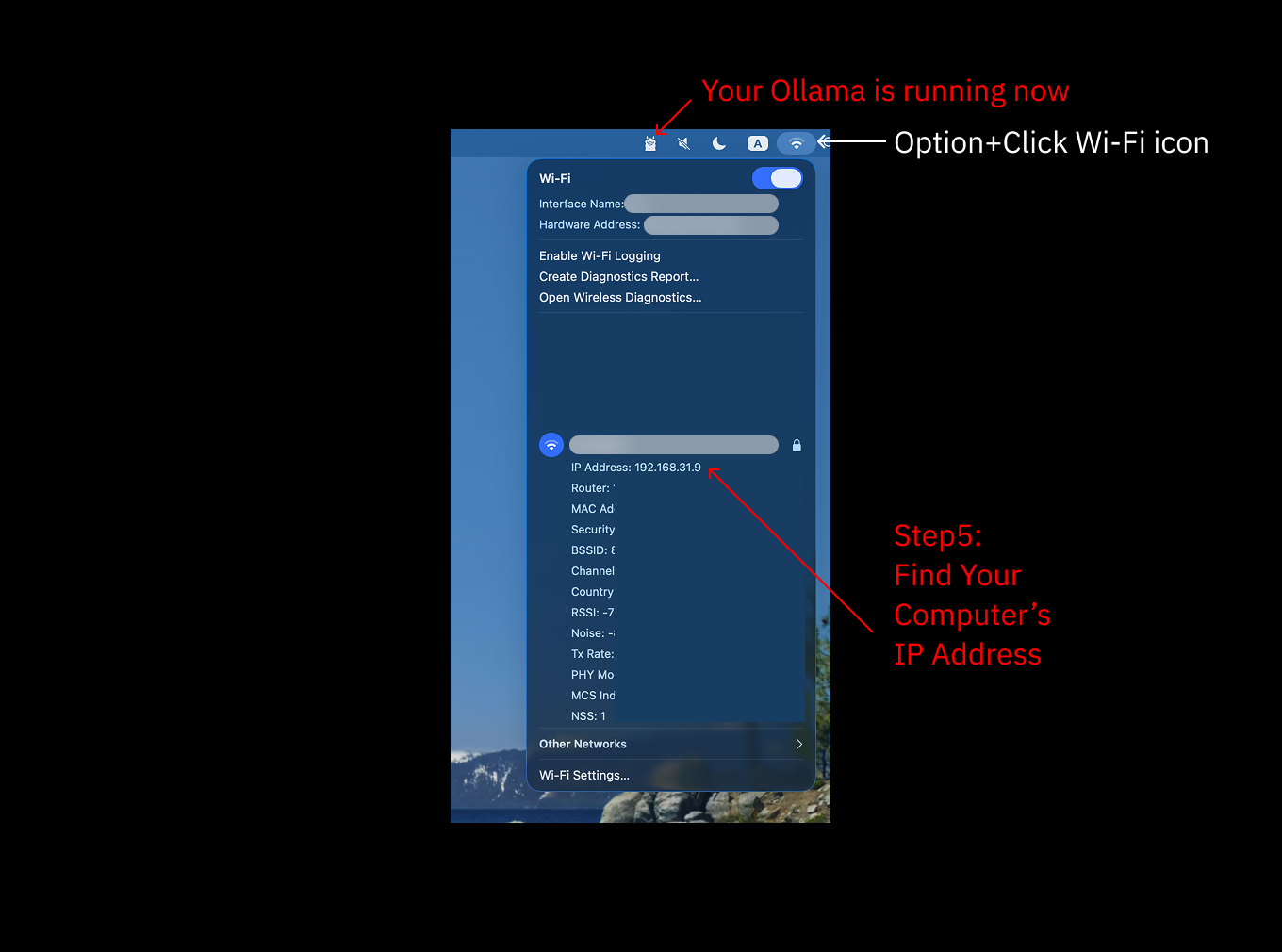

Schritt 5: Computer-IP-Adresse abrufen

Überprüfen Sie die IP-Adresse Ihres Computers in den Systemeinstellungen (beginnt normalerweise mit 192.168)

macOS IP-Überprüfungsmethode:

Systemeinstellungen → Netzwerk → Wi-Fi → Details → TCP/IP → IPv4-Adresse

Oder verwenden Sie den Terminal-Befehl:

ifconfig | grep "inet " | grep -v 127.0.0.1Schritt 6: In MiniTavern konfigurieren

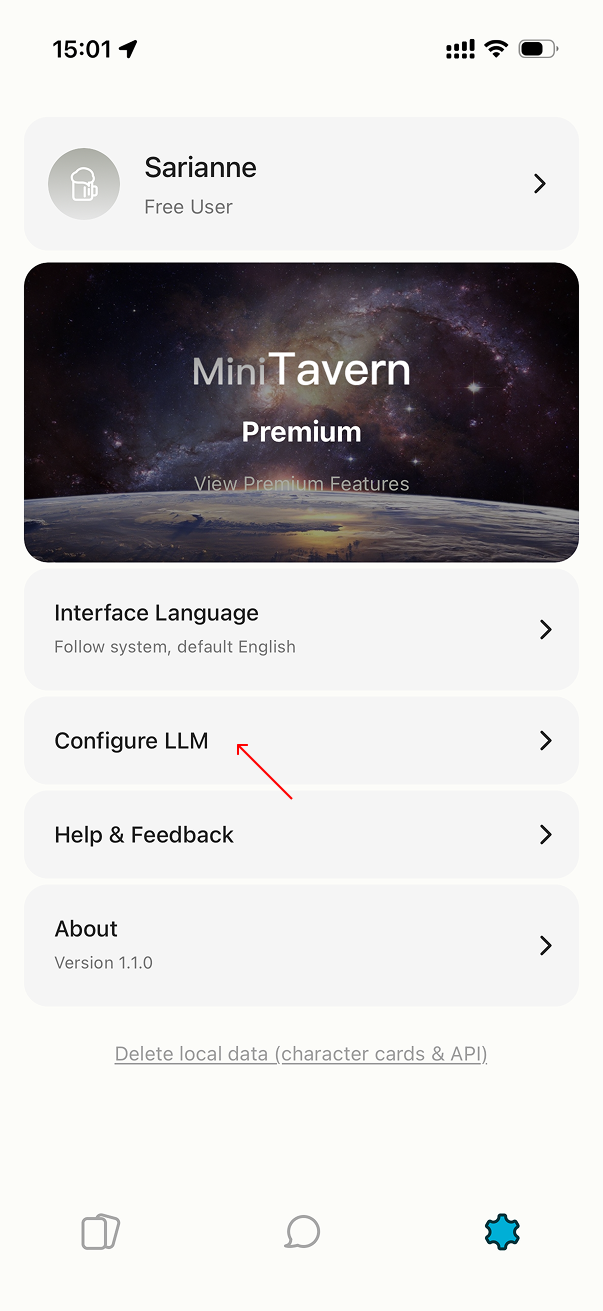

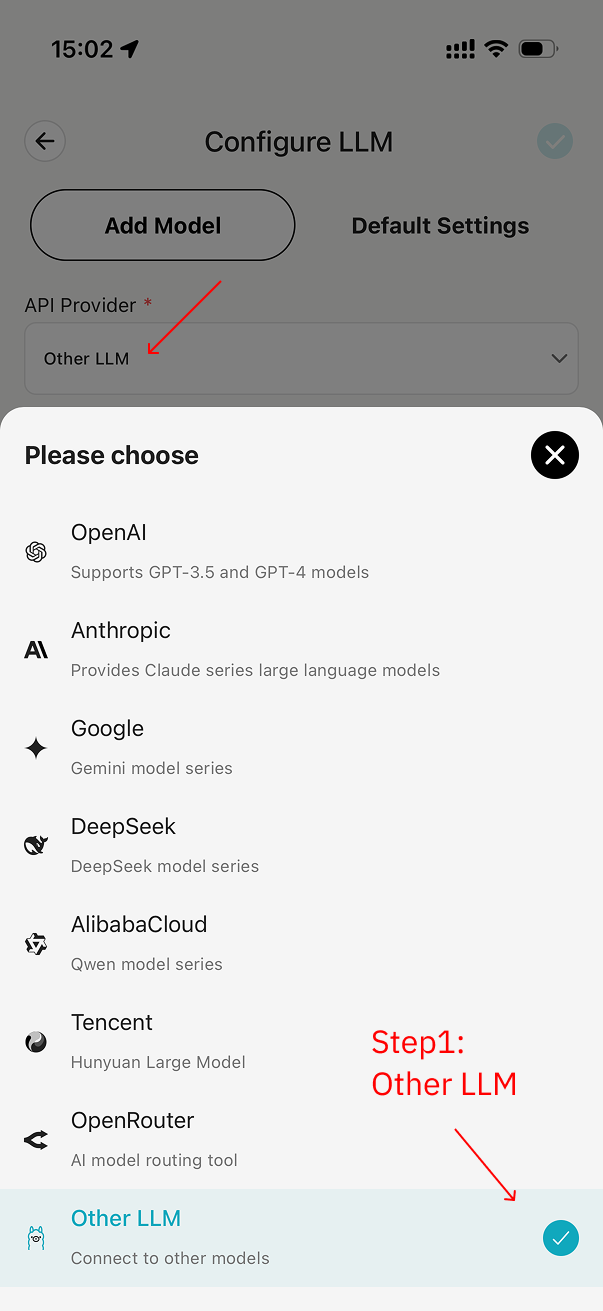

6.1 Other LLM Anbieter auswählen

Öffnen Sie MiniTavern → Einstellungen → LLM-Einstellungen → AI-Anbieter → Wählen Sie Other

6.2 Ollama Base URL eingeben

Geben Sie Ollama Base URL ein: http://your-computer-IP:11434/api

Beispiel: http://192.168.1.2:11434/api

Wichtiger Hinweis

- Muss

httpverwenden (nicht https) - Port muss

11434sein - Muss am Ende

/apihinzufügen

Klicken Sie auf Modellliste abrufen

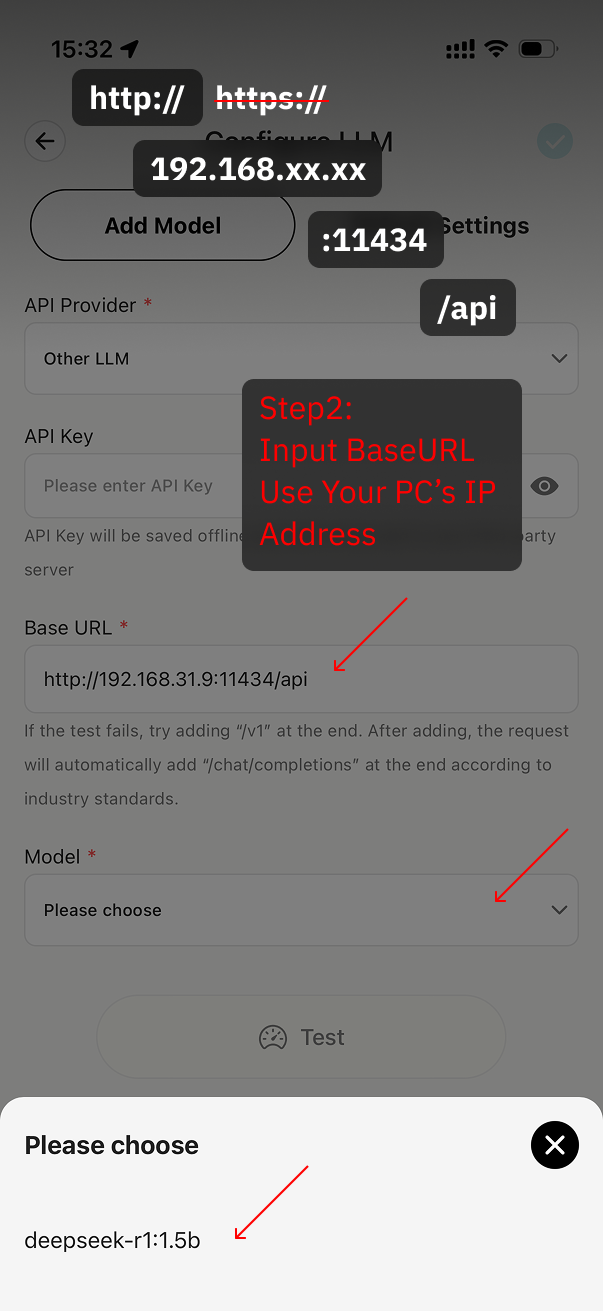

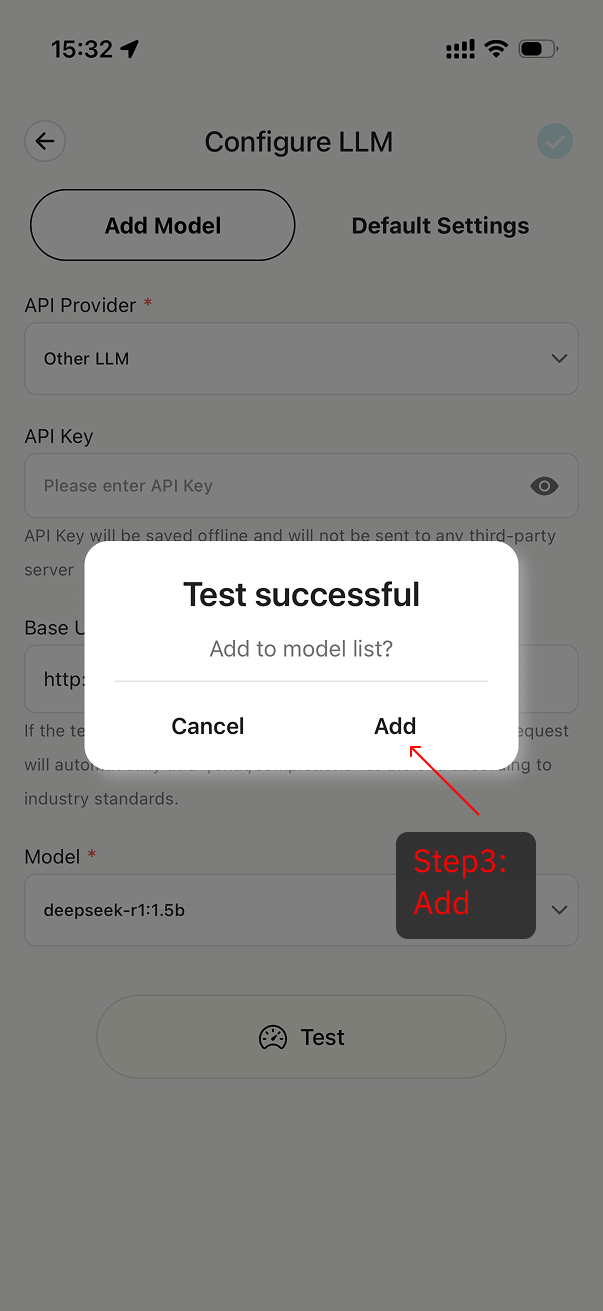

6.3 Verbindung testen

Nach Auswahl des Modells klicken Sie auf Verbindung testen, um zu überprüfen, ob die Konfiguration korrekt ist

Wenn keine Verbindung möglich ist:

- Überprüfen Sie, ob Ollama läuft

- Bestätigen Sie, dass die IP-Adresse korrekt ist

- Stellen Sie sicher, dass Telefon und Computer im selben Wi-Fi sind

- Überprüfen Sie, ob das Base URL-Format korrekt ist

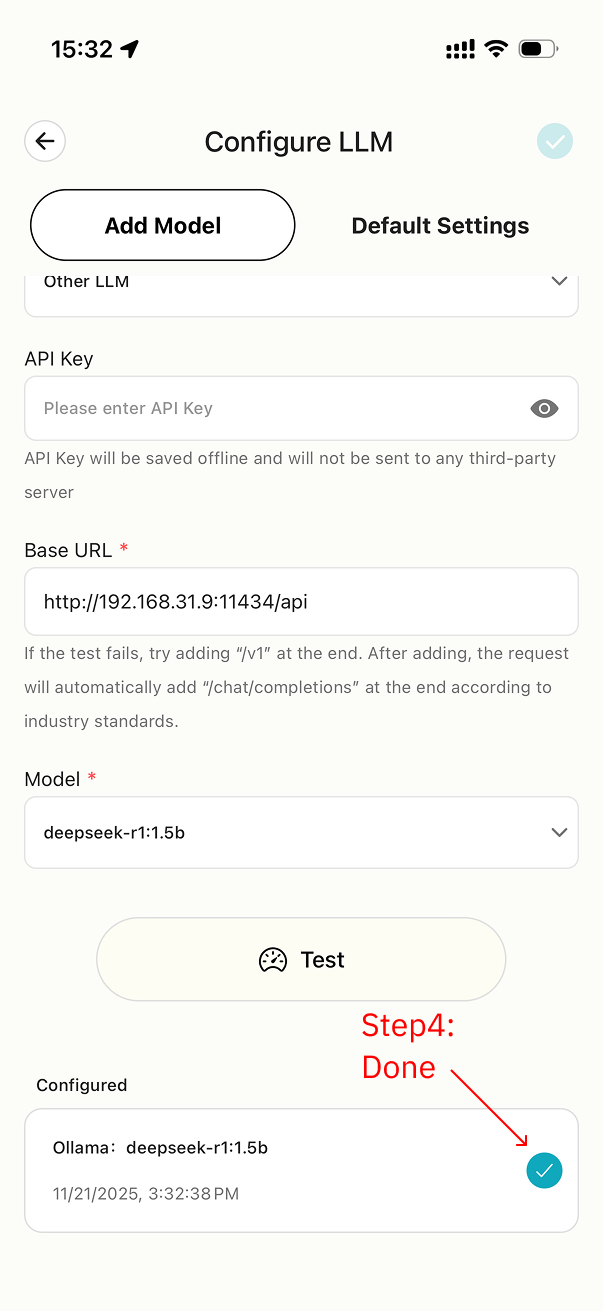

6.4 Hinzufügen abgeschlossen

Nach erfolgreichem Test klicken Sie auf Speichern, Modellhinzufügung abgeschlossen

Ollama mit Brew installieren

brew install ollamaHäufige Ollama-Befehle

# Alle heruntergeladenen Modelle anzeigen

ollama list

# Tutorial-Beispielmodell herunterladen

ollama pull deepseek-r1:1.5b

# Ollama-Dienst starten

ollama serve

# Angegebenes Modell in neuem Prozess ausführen

ollama run deepseek-r1:1.5b

# Ollama-Dienst stoppen

Ctrl + CFAQ

F: Schlechte Gesprächsqualität?

A:

- Versuchen Sie größere Modelle zu verwenden (7B oder höher)

- Versuchen Sie verschiedene Charakterkarten