3.6 IA local gratuita: Ollama

Ollama es una herramienta gratuita que admite la ejecución de modelos de IA localmente. Usando Ollama, puedes usar IA completamente gratis y sin conexión sin comprar una clave API.

Información de configuración básica

Al configurar Ollama, necesitas encontrar la siguiente información básica:

- Dirección IP del host: Generalmente comienza con

192.168(por ejemplo,192.168.1.2) - Formato de Base URL:

http://192.168.1.2:11434/api

Nota importante

- Debe usar el protocolo

http(no https) - Debe usar el puerto

11434 - Debe agregar

/apial final

Ejemplo: http://192.168.1.2:11434/api (donde 192.168.1.2 es la IP de tu computadora)

¿Por qué elegir Ollama?

- Completamente gratis: No necesitas comprar clave API

- Protección de privacidad: Todos los datos de conversación se procesan localmente

- Uso sin conexión: No se requiere conexión de red

- Soporte multi-modelo: Admite Llama, Mistral, DeepSeek, etc.

Requisitos

- Una computadora (este tutorial usa macOS como ejemplo, Windows y Linux también funcionan)

- Teléfono y computadora en la misma red Wi-Fi

- La computadora debe permanecer encendida y conectada a Wi-Fi durante el uso

Pasos (Ejemplo macOS)

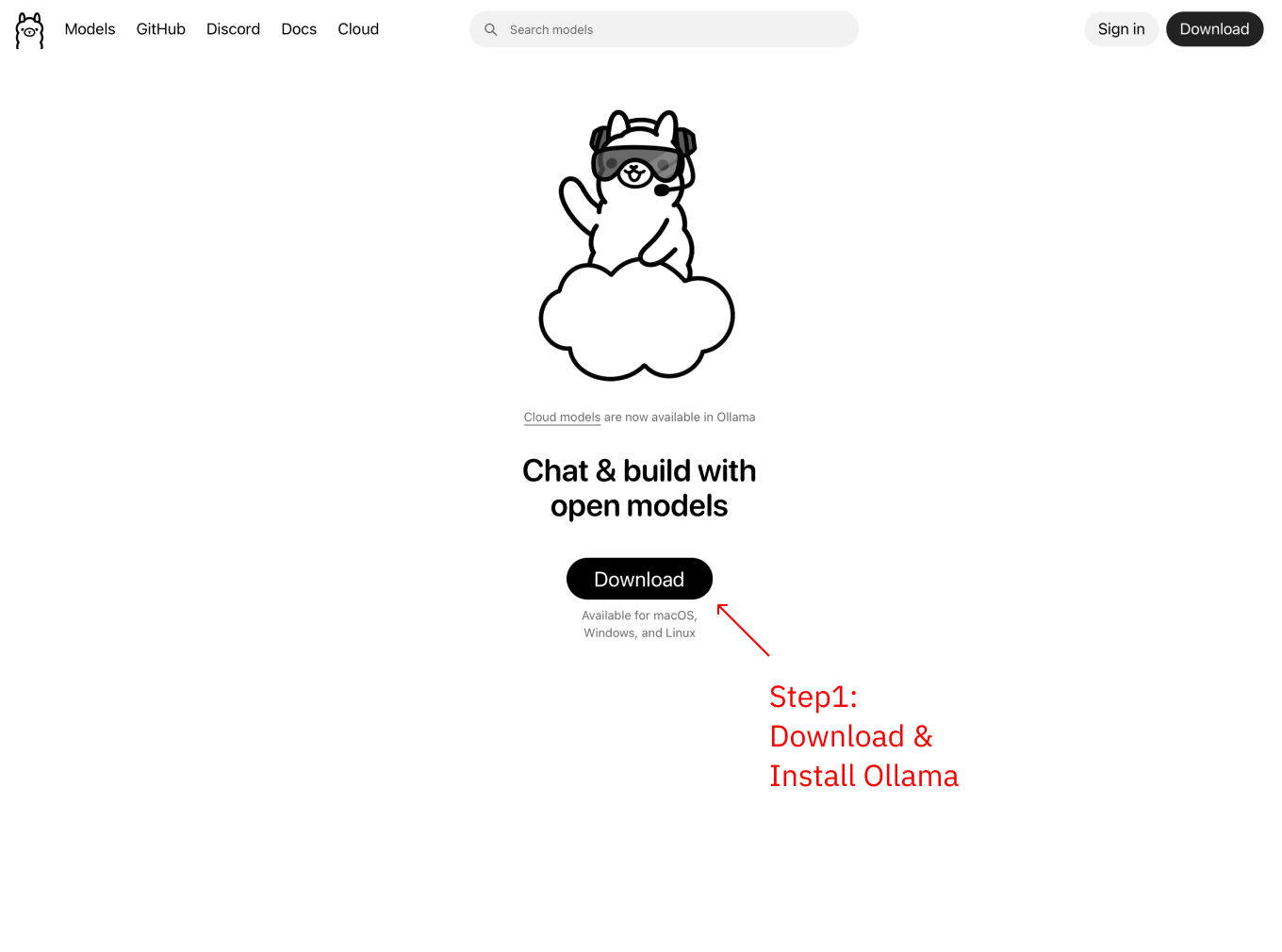

Paso 1: Descargar e instalar Ollama

Visita https://ollama.com para descargar e instalar Ollama

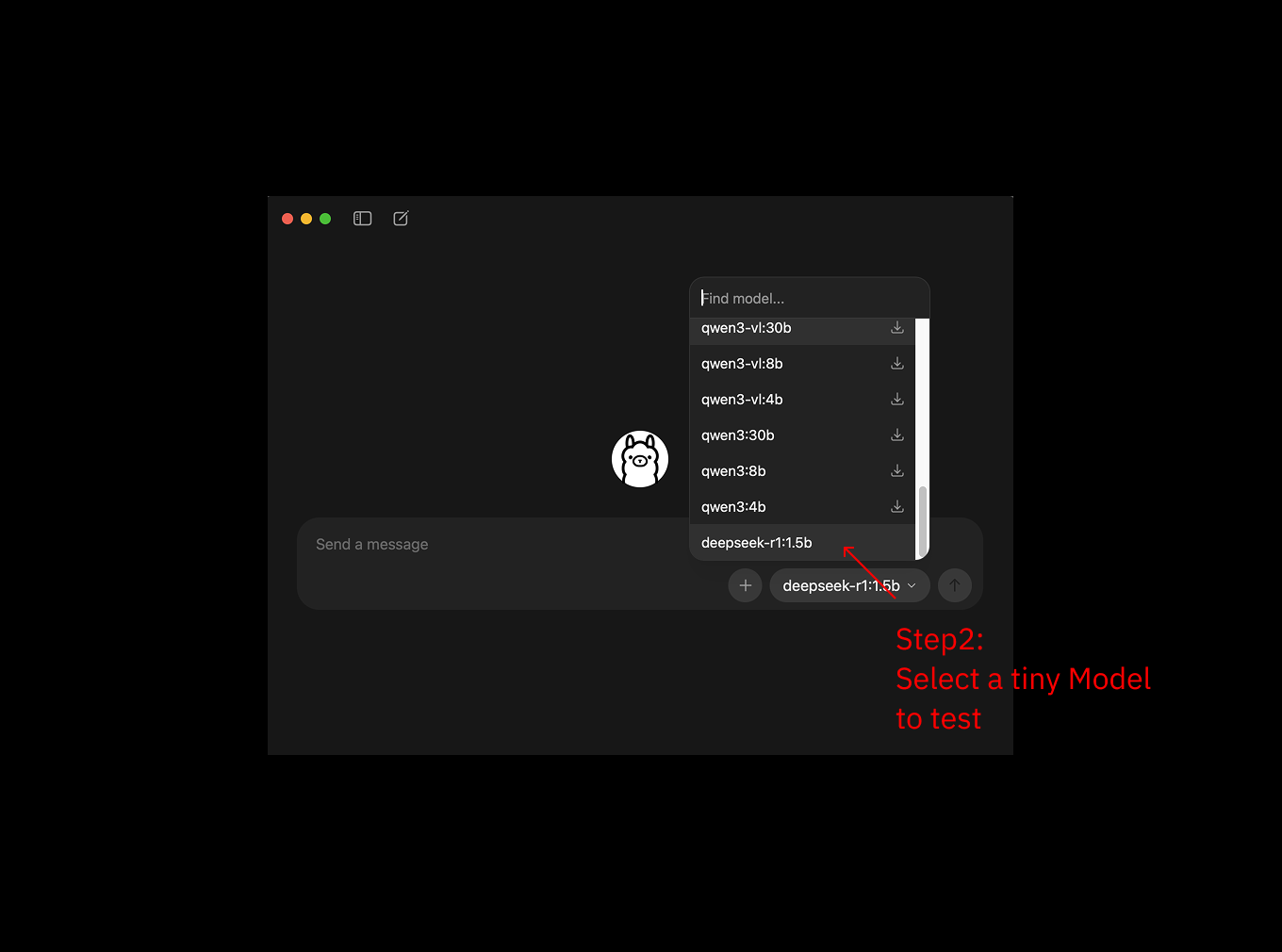

Paso 2: Descargar modelo

Abre la terminal y descarga un modelo pequeño para pruebas (por ejemplo, deepseek-r1:1.5b, aproximadamente 1GB):

ollama pull deepseek-r1:1.5b

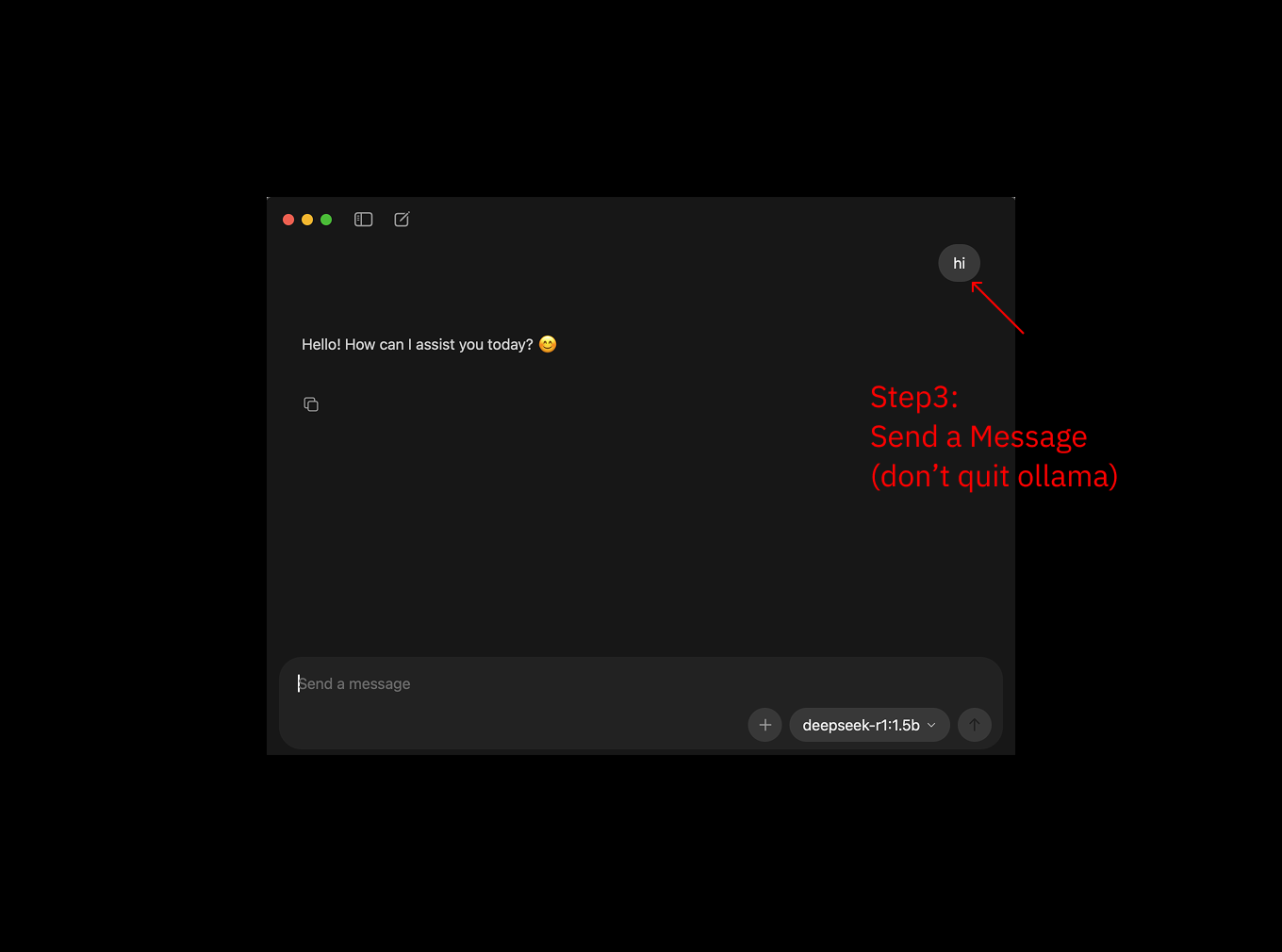

Paso 3: Ejecutar modelo

Después de completar la descarga, ejecuta el modelo:

ollama serve

ollama run deepseek-r1:1.5bEl primer inicio será más lento, después puedes chatear con el modelo directamente en la terminal para pruebas

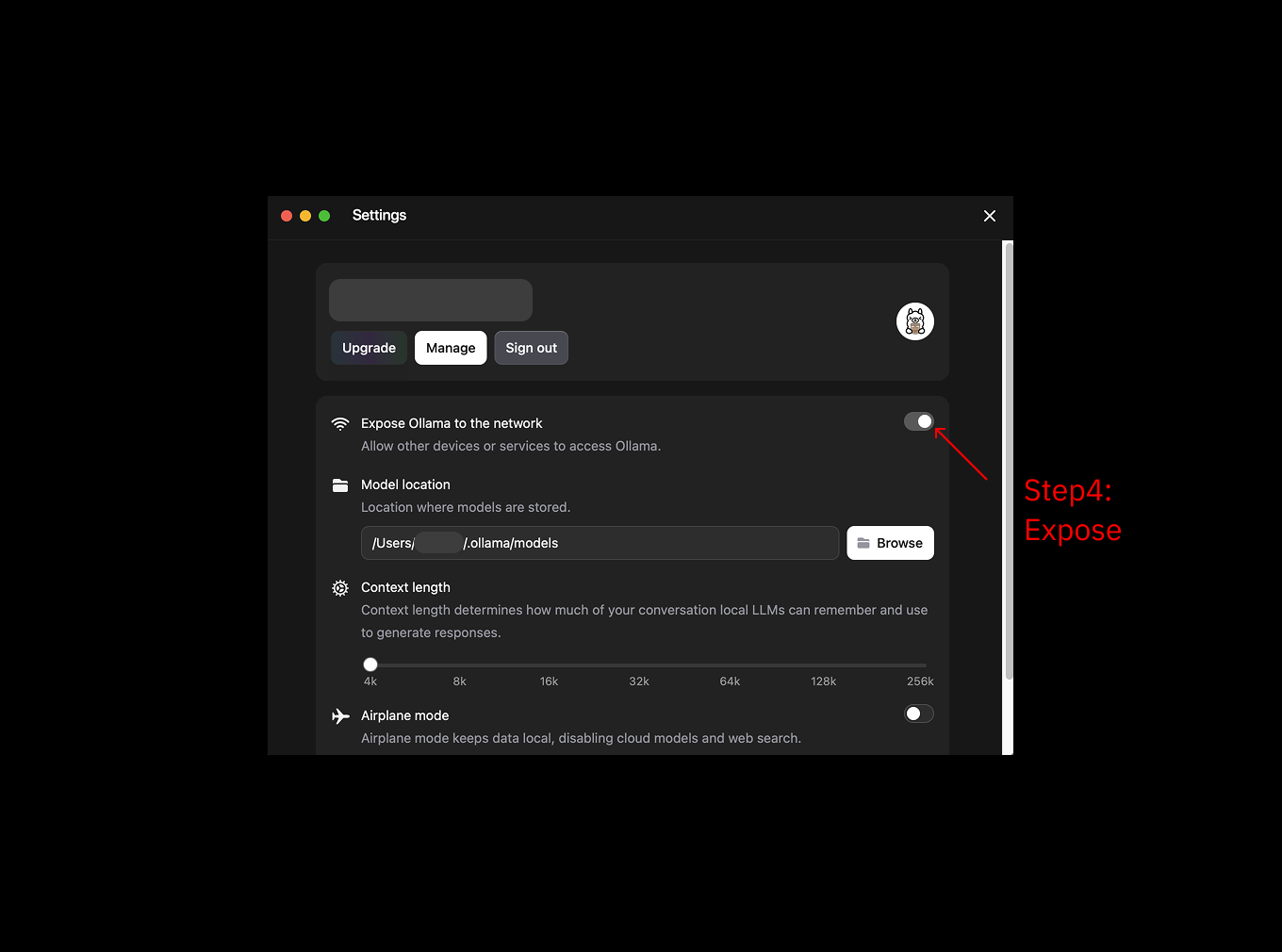

Paso 4: Habilitar acceso LAN

Habilita el acceso LAN en la configuración de Ollama para permitir que el teléfono se conecte a Ollama en tu computadora

¿Por qué es necesario esto?

- MiniTavern se ejecuta en el teléfono y necesita acceder a Ollama en la computadora a través de LAN

- Por defecto, Ollama solo permite acceso local

- Después de habilitar, los dispositivos en el mismo Wi-Fi pueden acceder a él

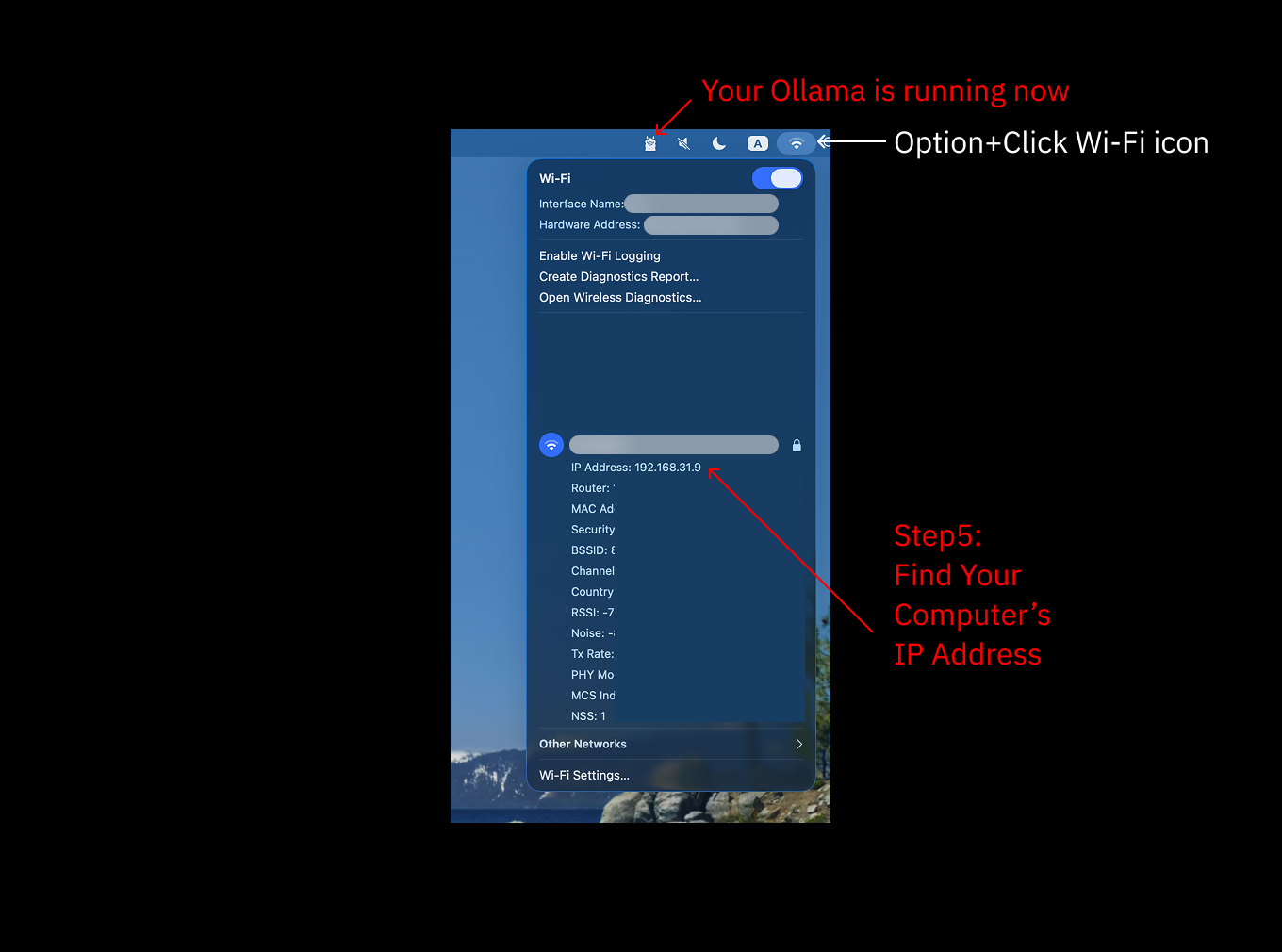

Paso 5: Obtener dirección IP de la computadora

Verifica la dirección IP de tu computadora en la configuración del sistema (generalmente comienza con 192.168)

Método de verificación de IP en macOS:

Configuración del sistema → Red → Wi-Fi → Detalles → TCP/IP → Dirección IPv4

O usa el comando de terminal:

ifconfig | grep "inet " | grep -v 127.0.0.1Paso 6: Configurar en MiniTavern

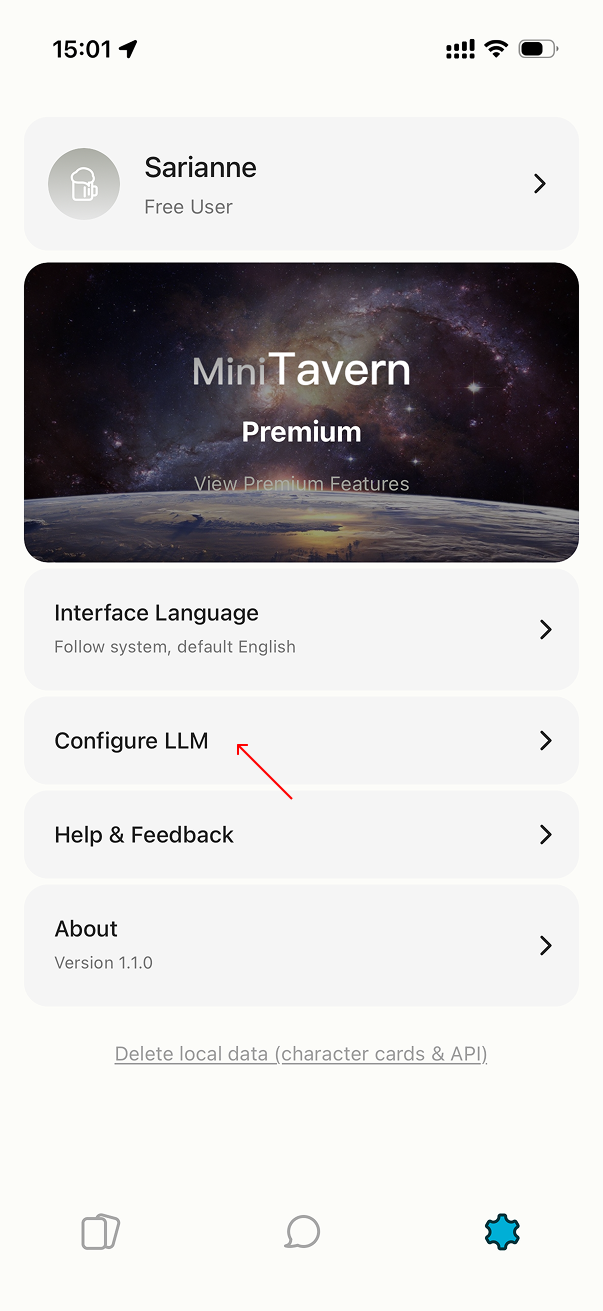

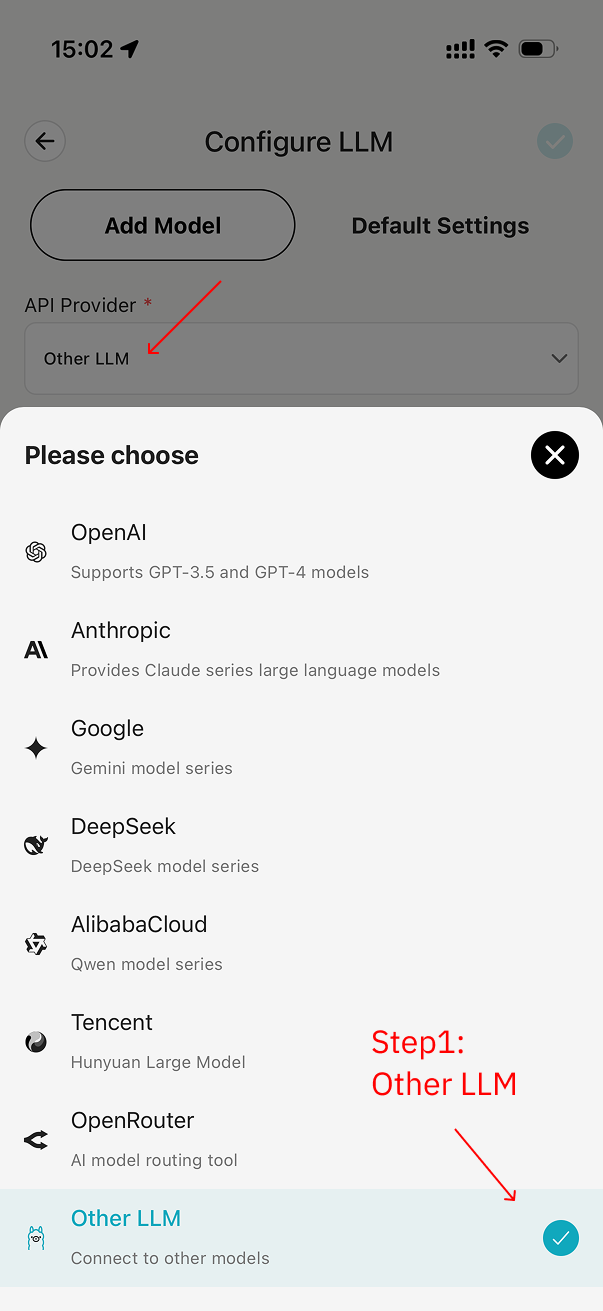

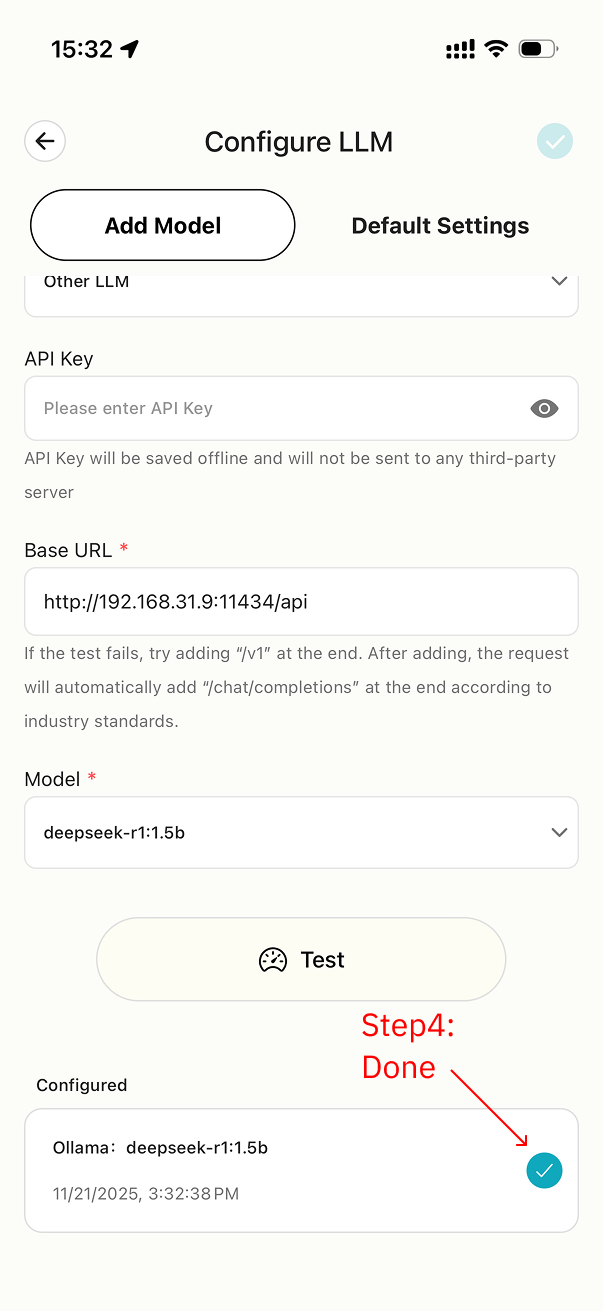

6.1 Seleccionar proveedor Other LLM

Abre MiniTavern → Configuración → Configuración LLM → Proveedor de IA → Selecciona Other

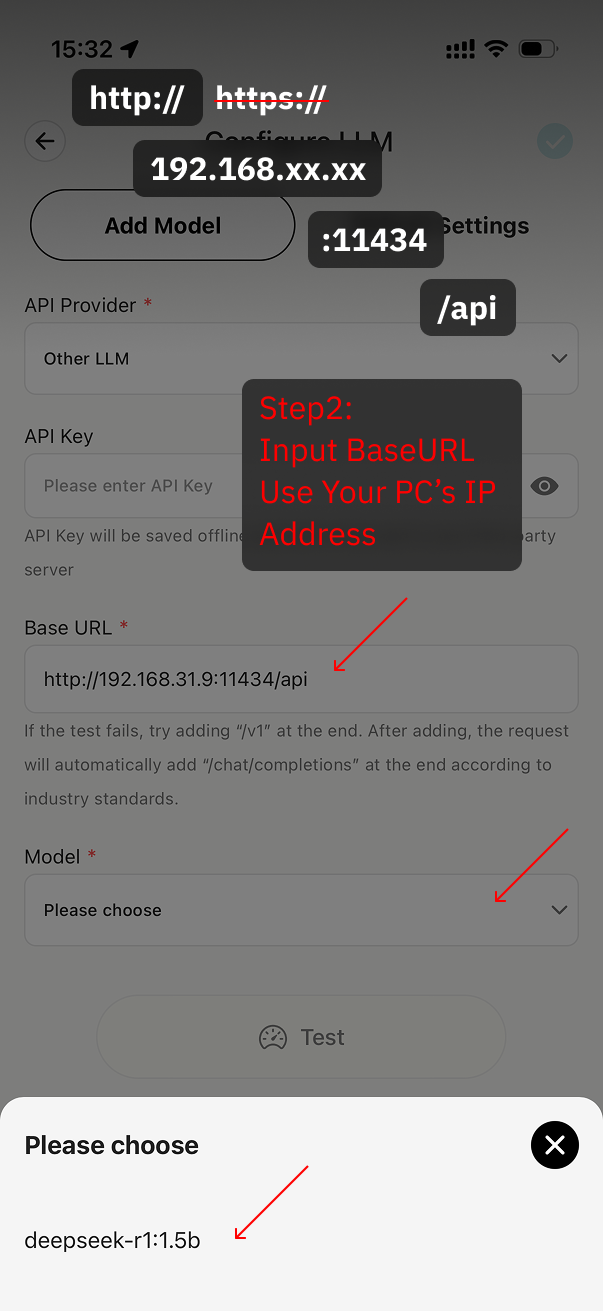

6.2 Ingresar Base URL de Ollama

Ingresa la Base URL de Ollama: http://your-computer-IP:11434/api

Ejemplo: http://192.168.1.2:11434/api

Nota importante

- Debe usar

http(no https) - El puerto debe ser

11434 - Debe agregar

/apial final

Haz clic en Obtener lista de modelos

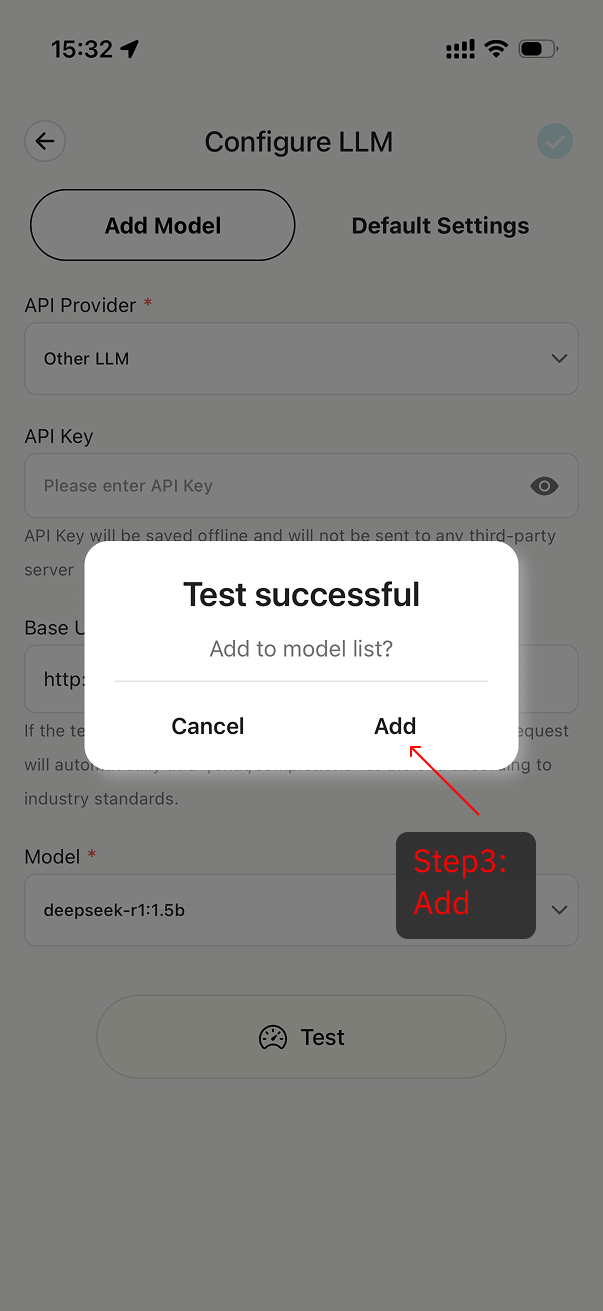

6.3 Probar conexión

Después de seleccionar el modelo, haz clic en Probar conexión para verificar que la configuración sea correcta

Si no se puede conectar:

- Verifica si Ollama está en ejecución

- Confirma que la dirección IP sea correcta

- Asegúrate de que el teléfono y la computadora estén en el mismo Wi-Fi

- Verifica si el formato de Base URL es correcto

6.4 Agregar completo

Después de una prueba exitosa, haz clic en guardar, adición de modelo completa

Instalar Ollama usando Brew

brew install ollamaComandos comunes de Ollama

# Ver todos los modelos descargados

ollama list

# Descargar modelo de ejemplo del tutorial

ollama pull deepseek-r1:1.5b

# Iniciar servicio Ollama

ollama serve

# Ejecutar modelo especificado en nuevo proceso

ollama run deepseek-r1:1.5b

# Detener servicio Ollama

Ctrl + CFAQ

P: ¿Mala calidad de conversación?

R:

- Intenta usar modelos más grandes (7B o superior)

- Intenta diferentes tarjetas de personajes