3.6 本地免费 AI:Ollama

Ollama 是一个支持本地运行 AI 模型的免费工具。使用 Ollama,你可以完全免费、离线地使用 AI,无需购买 API Key。

核心配置信息

在配置 Ollama 时,你需要找到以下核心信息:

- 主机 IP 地址:一般以

192.168开头(例如:192.168.1.2) - Base URL 格式:

http://192.168.1.2:11434/api

重要提示

- 必须使用

http协议(不是 https) - 必须使用

11434端口 - 必须在末尾加上

/api

示例:http://192.168.1.2:11434/api(其中 192.168.1.2 是你的电脑 IP)

为什么选择 Ollama?

- 完全免费:无需购买 API Key

- 隐私保护:所有对话数据都在本地处理

- 离线使用:无需网络连接

- 多模型支持:支持 Llama、Mistral、DeepSeek 等

配置要求

- 一台电脑(本教程以 macOS 为例,Windows、Linux 均可)

- 手机和电脑在同一个 Wi-Fi 网络下

- 使用时电脑需要保持开机并连接 Wi-Fi

操作步骤(以 macOS 为例)

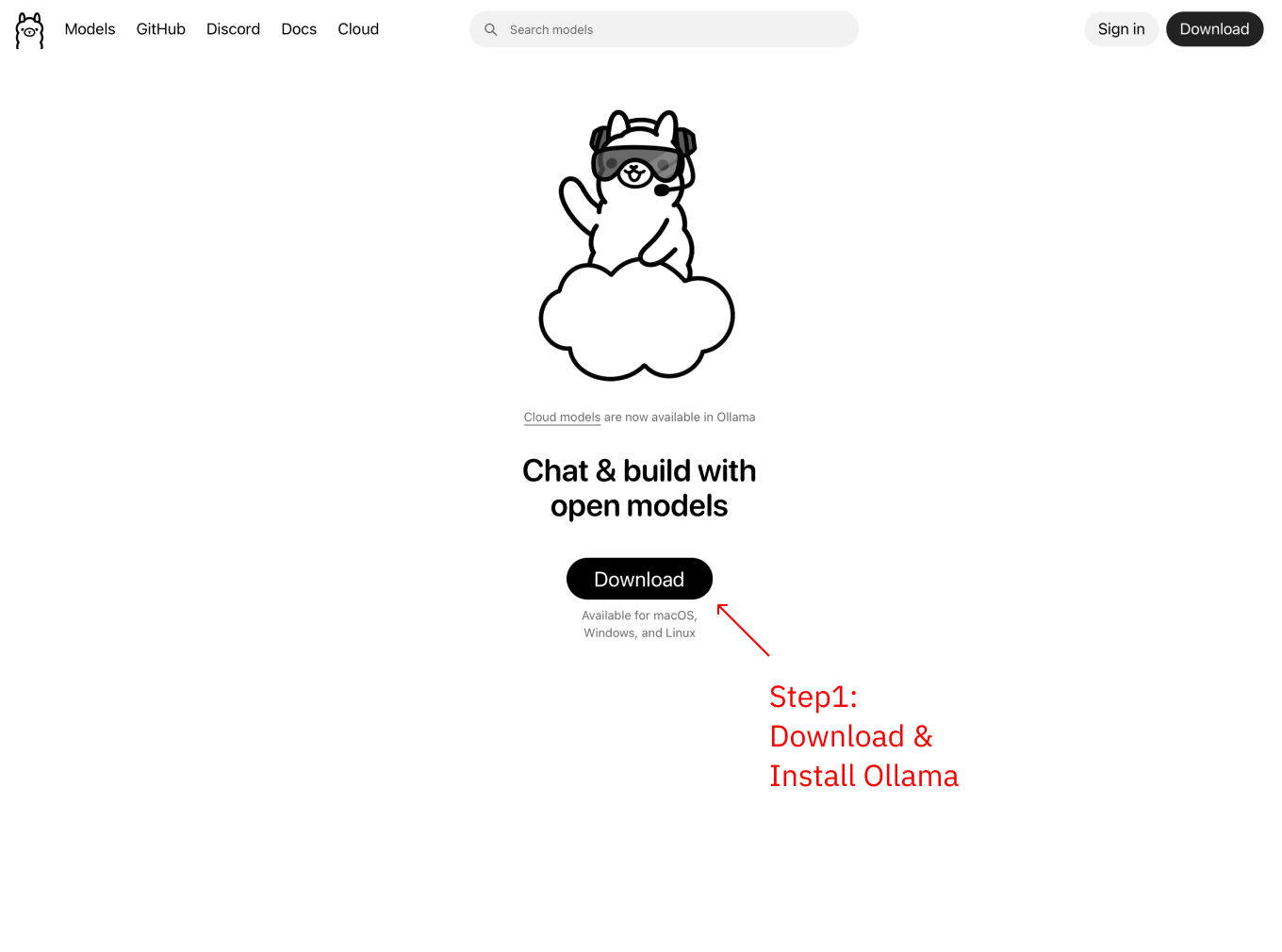

第 1 步:下载并安装 Ollama

访问 https://ollama.com 下载并安装 Ollama

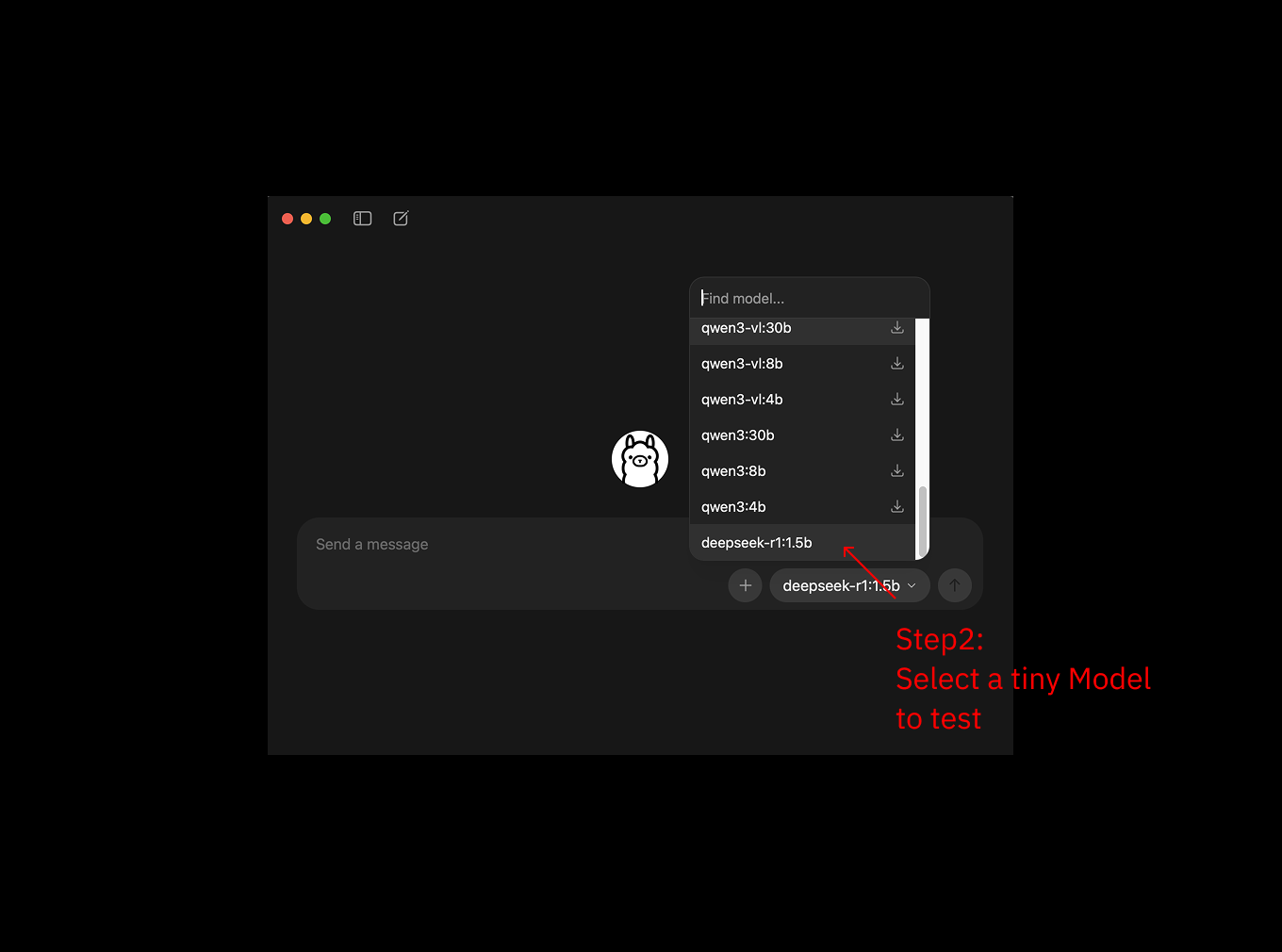

第 2 步:下载模型

打开终端,下载一个小模型进行测试(例如 deepseek-r1:1.5b,约 1GB):

bash

ollama pull deepseek-r1:1.5b

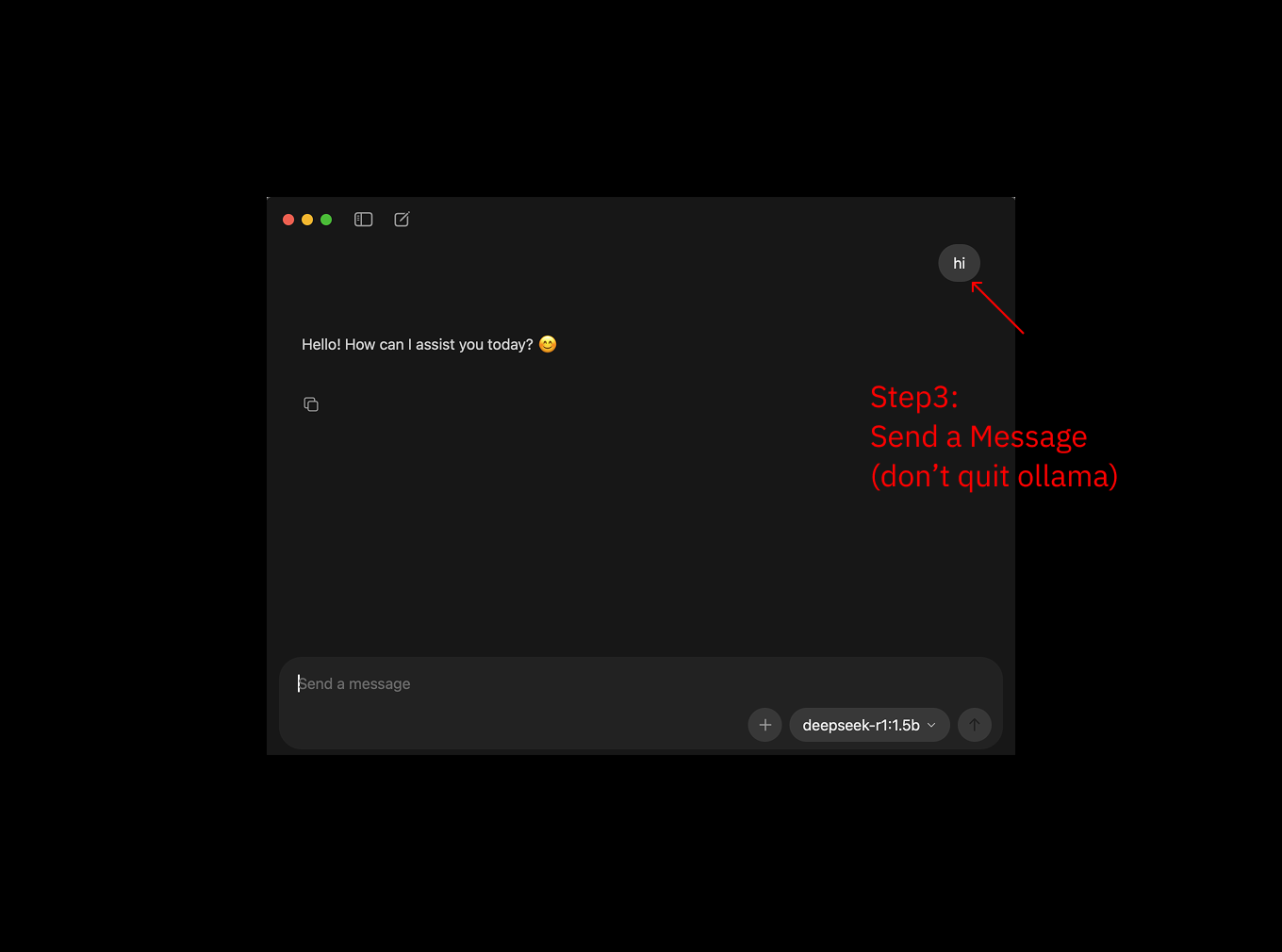

第 3 步:运行模型

下载完成后,运行该模型:

bash

ollama serve

ollama run deepseek-r1:1.5b第一次启动会比较慢,之后可以在终端中直接与模型对话测试

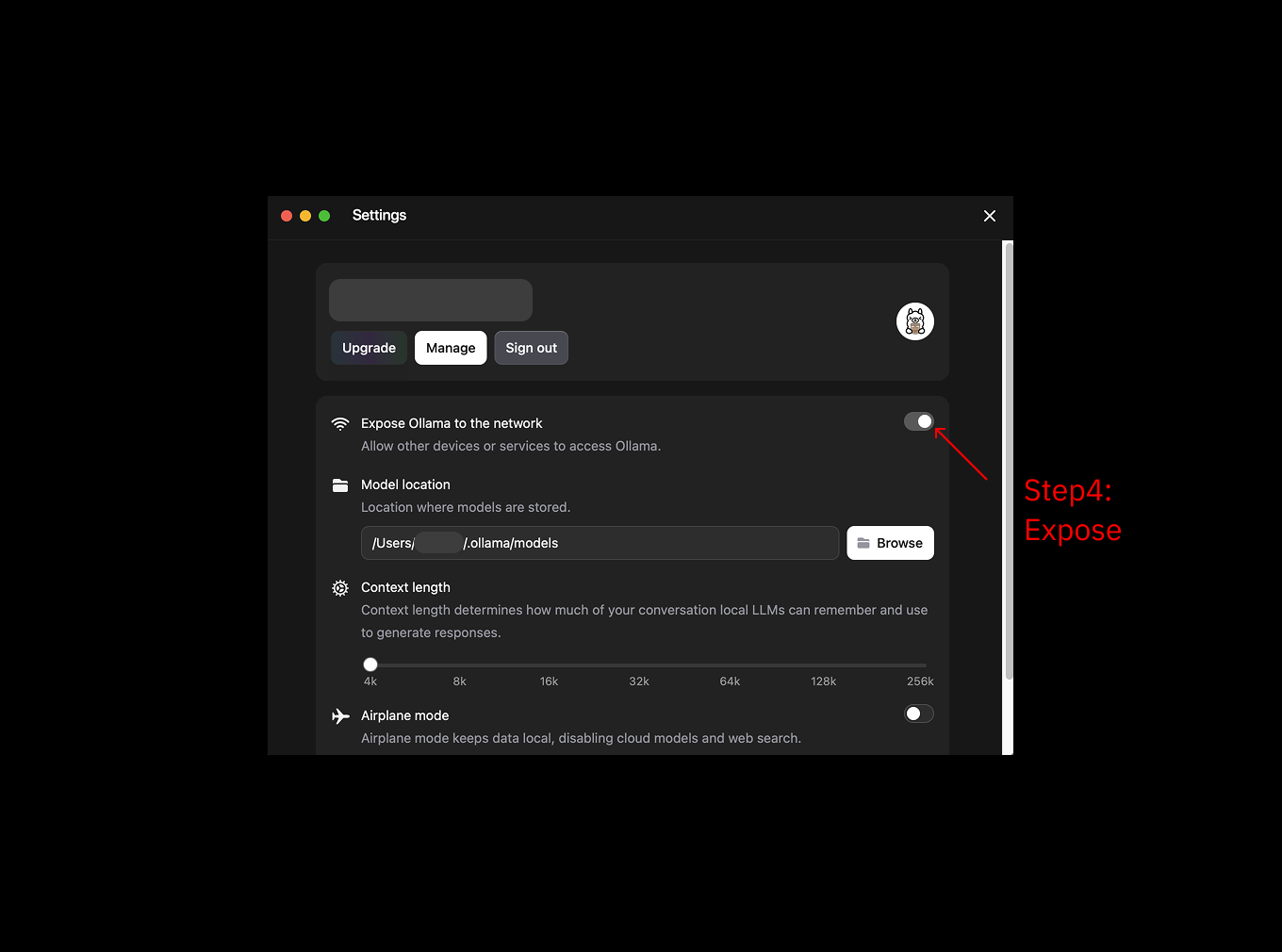

第 4 步:开启局域网访问

在 Ollama 设置中开启局域网访问,允许手机连接电脑上的 Ollama

为什么需要开启?

- MiniTavern 在手机上运行,需要通过局域网访问电脑上的 Ollama

- 默认情况下,Ollama 只允许本地访问

- 开启后,同一 Wi-Fi 下的设备都可以访问

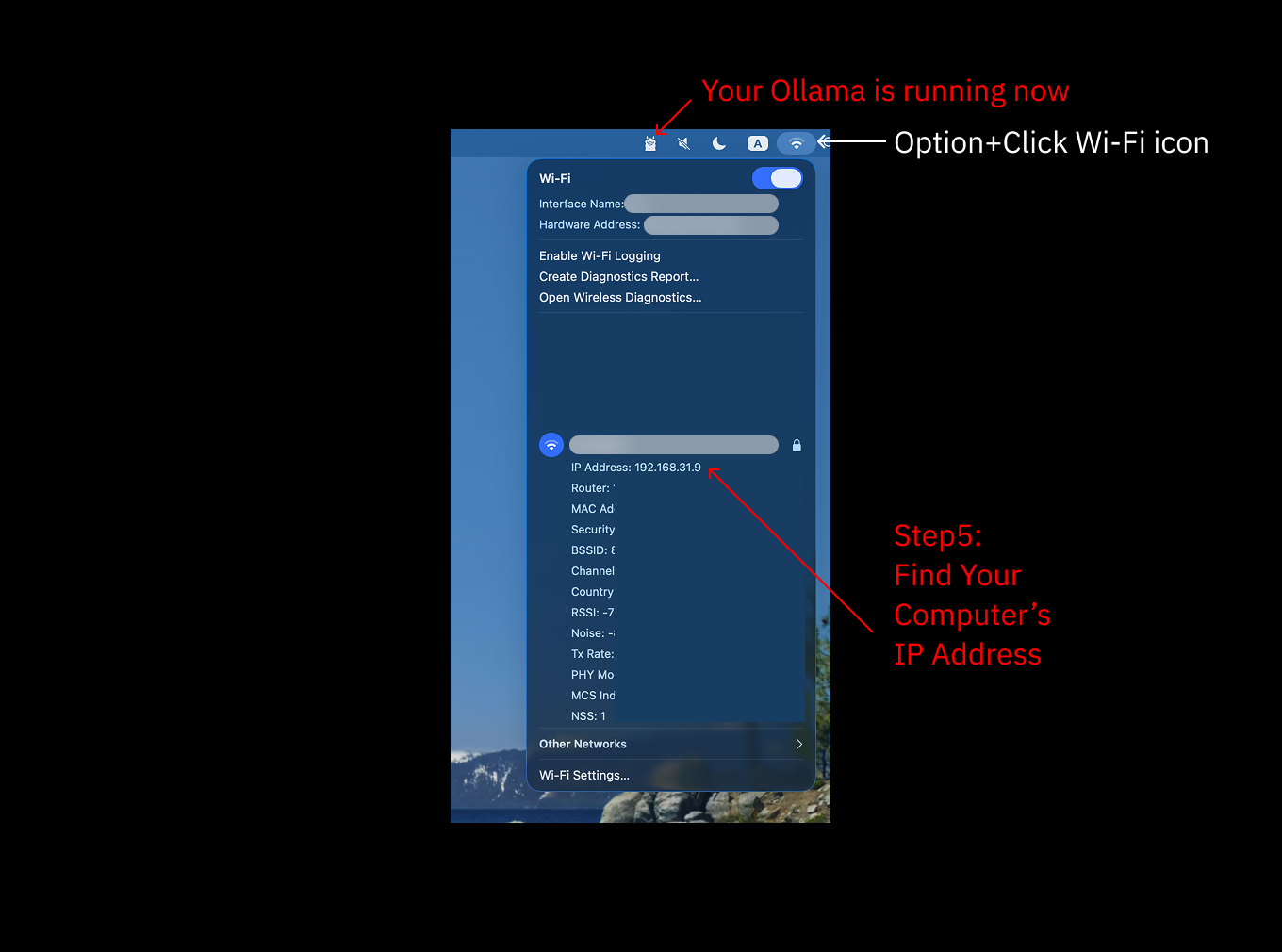

第 5 步:获取电脑 IP 地址

在系统设置中查看你的电脑 IP 地址(通常以 192.168 开头)

macOS 查看 IP 方法:

系统设置 → 网络 → Wi-Fi → 详细信息 → TCP/IP → IPv4 地址

或使用终端命令:

bash

ifconfig | grep "inet " | grep -v 127.0.0.1第 6 步:在 MiniTavern 中配置

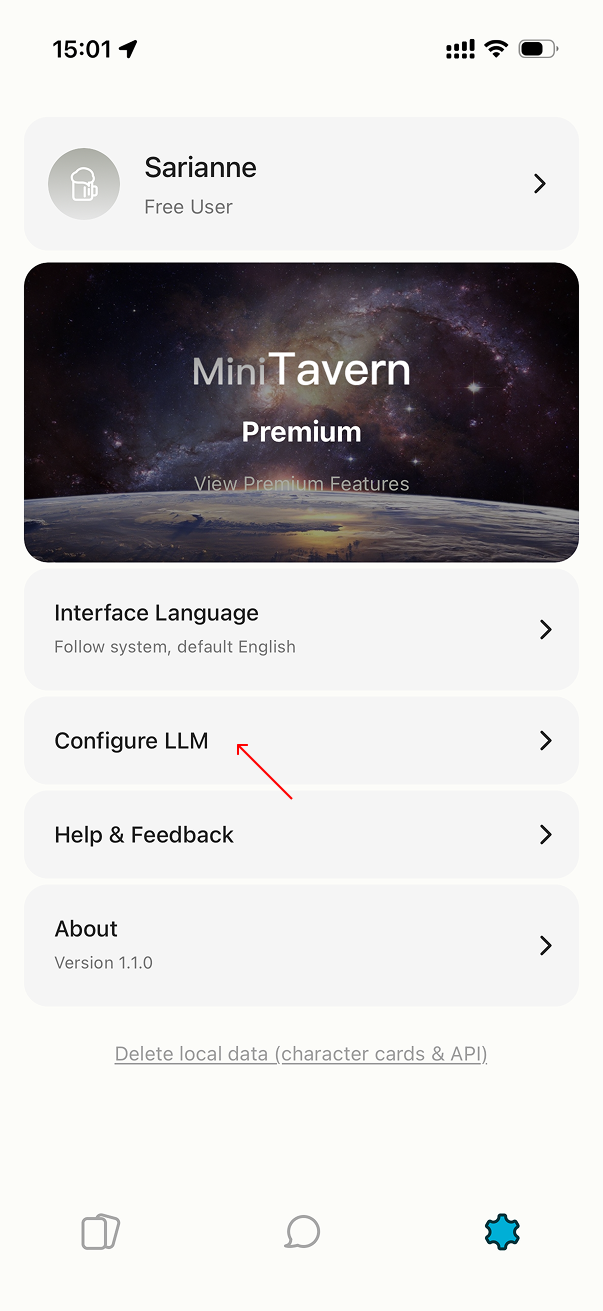

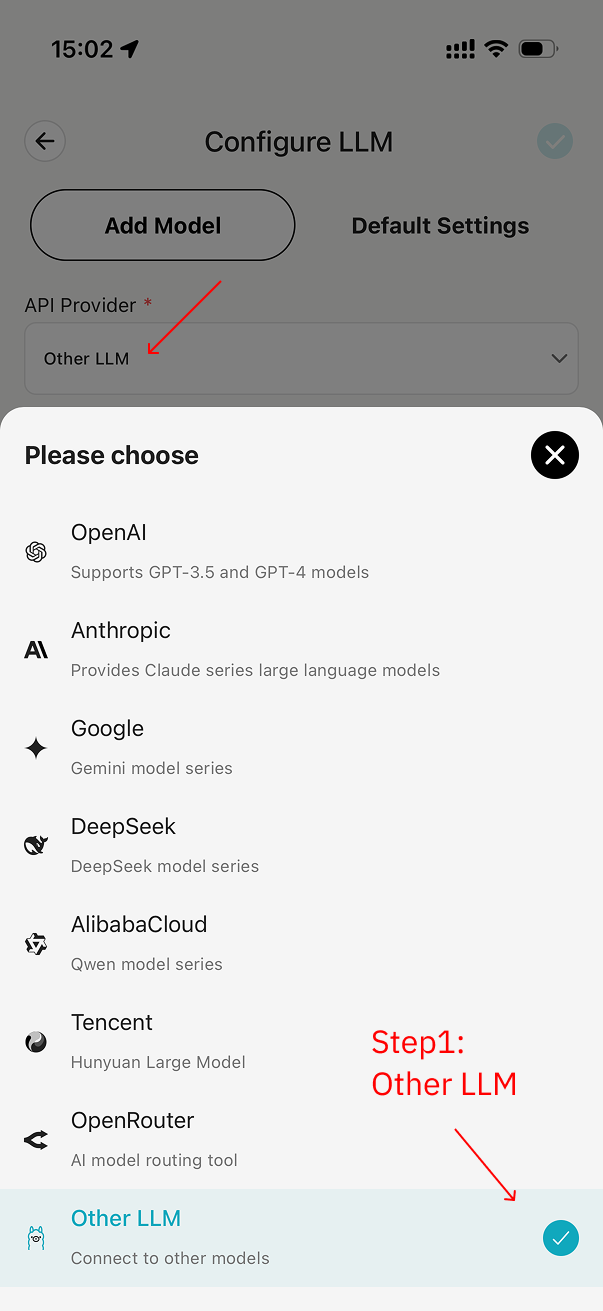

6.1 选择其他 LLM 服务商

打开 MiniTavern → 设置 → LLM 设置 → AI 服务商 → 选择 其他

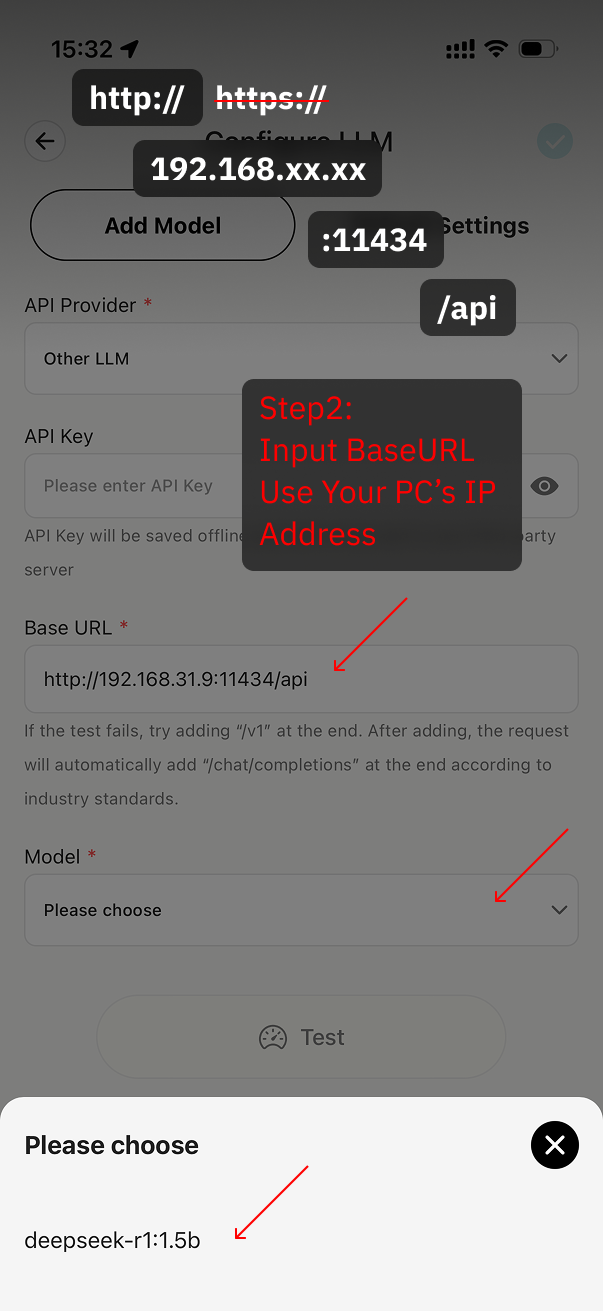

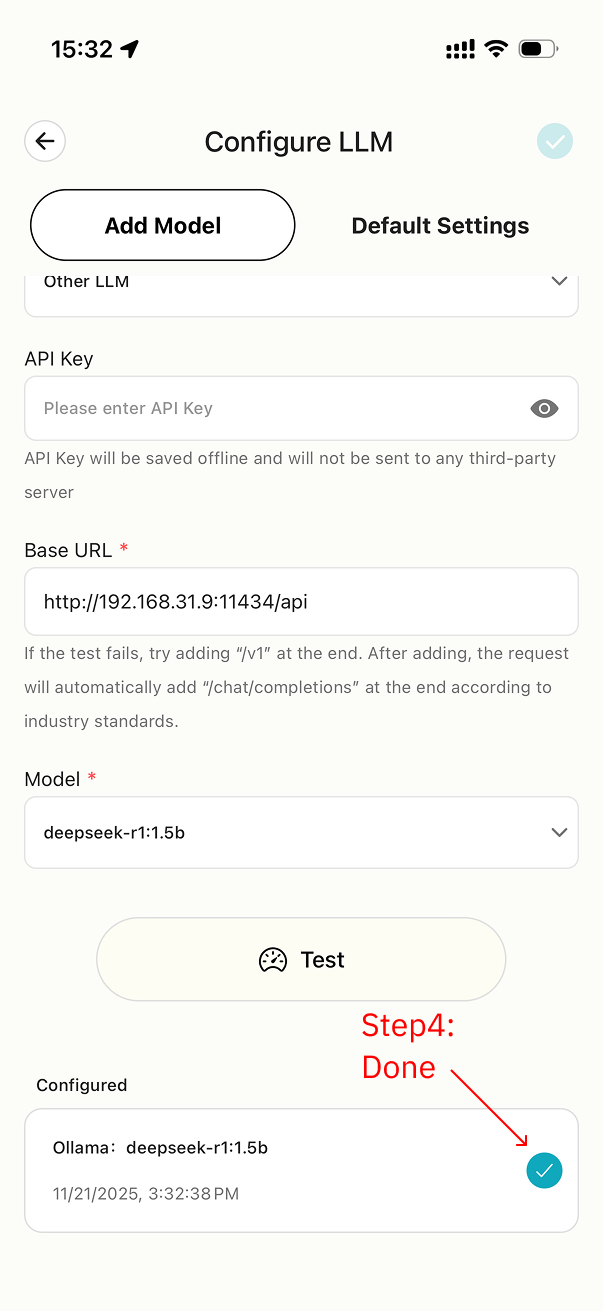

6.2 输入 Ollama Base URL

输入 Ollama 的 Base URL:http://你的电脑IP:11434/api

例如:http://192.168.1.2:11434/api

重要提示

- 必须使用

http(不是 https) - 端口必须是

11434 - 末尾必须加上

/api

点击 获取模型列表

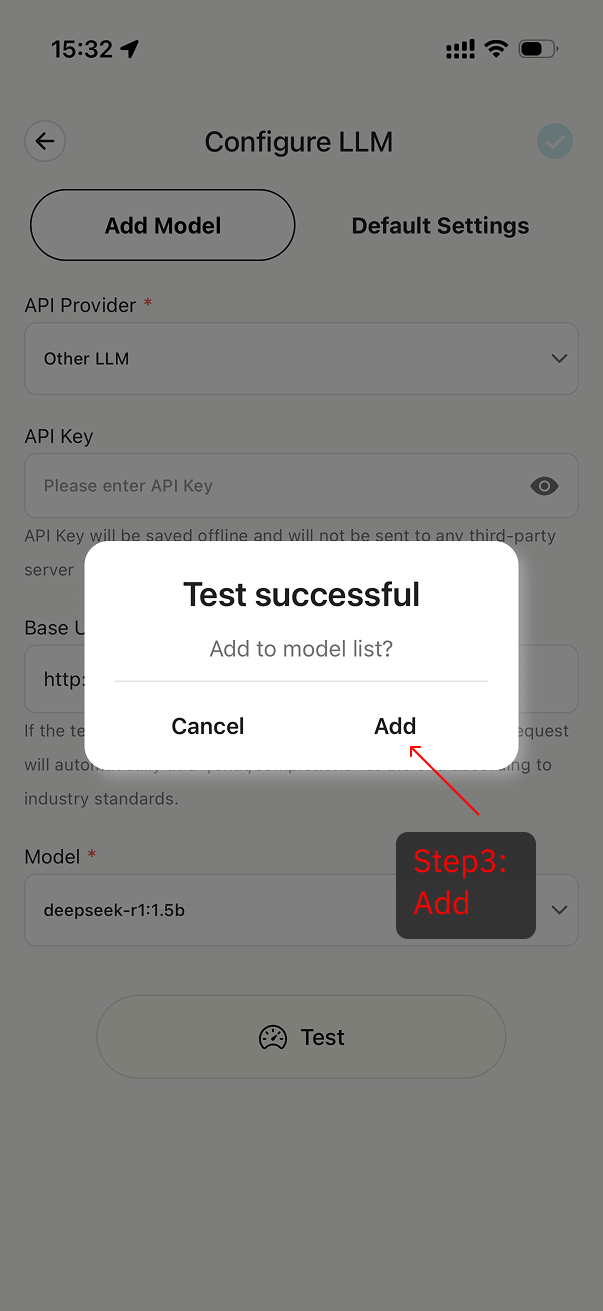

6.3 测试连接

选择模型后,点击 测试连接 验证配置是否正确

如果无法连接:

- 检查 Ollama 是否正在运行

- 确认 IP 地址正确

- 确保手机和电脑在同一 Wi-Fi

- 检查 Base URL 格式是否正确

6.4 添加完成

测试成功后,点击保存,模型添加完成

使用 Brew 安装 Ollama

bash

brew install ollama常用 Ollama 命令

bash

# 查看所有已下载的模型

ollama list

# 下载本教程示例模型

ollama pull deepseek-r1:1.5b

# 启动 Ollama 服务

ollama serve

# 新开进程运行指定模型

ollama run deepseek-r1:1.5b

# 停止 Ollama 服务

Ctrl + C常见问题

Q: 对话质量不好?

A:

- 尝试使用更大的模型(7B 或以上)

- 尝试不同的角色卡