Silly Tavern最新版でOllamaが見つからない?ローカルモデル設定を3ステップで解決

Silly Tavern(現在の最新バージョン 1.16.0)は、セルフホストや自宅サーバーで動かすフロントエンドとして人気があり、Ollama・LM Studioと組み合わせればローカルLLMでチャット内容を端末内に閉じたプライベート運用(いわゆるオンプレミス/ローカルデプロイ)がしやすいツールです。アップデート後にOllamaやLM Studioの設定画面がどこにも見当たらないという声は、その分類整理の影響でよく出ます——消えたわけではなく、API接続画面のメインAPIとAPI Typeの組み合わせが一段深くなっただけ。この記事で正しいルートを3ステップで案内します。

なぜOllamaの入口が見つからないの?

Silly Tavernの新バージョンでは、API接続画面の分類が変わりました。主な変更点は3つです:

1. メインAPIが2つのルートに分かれた

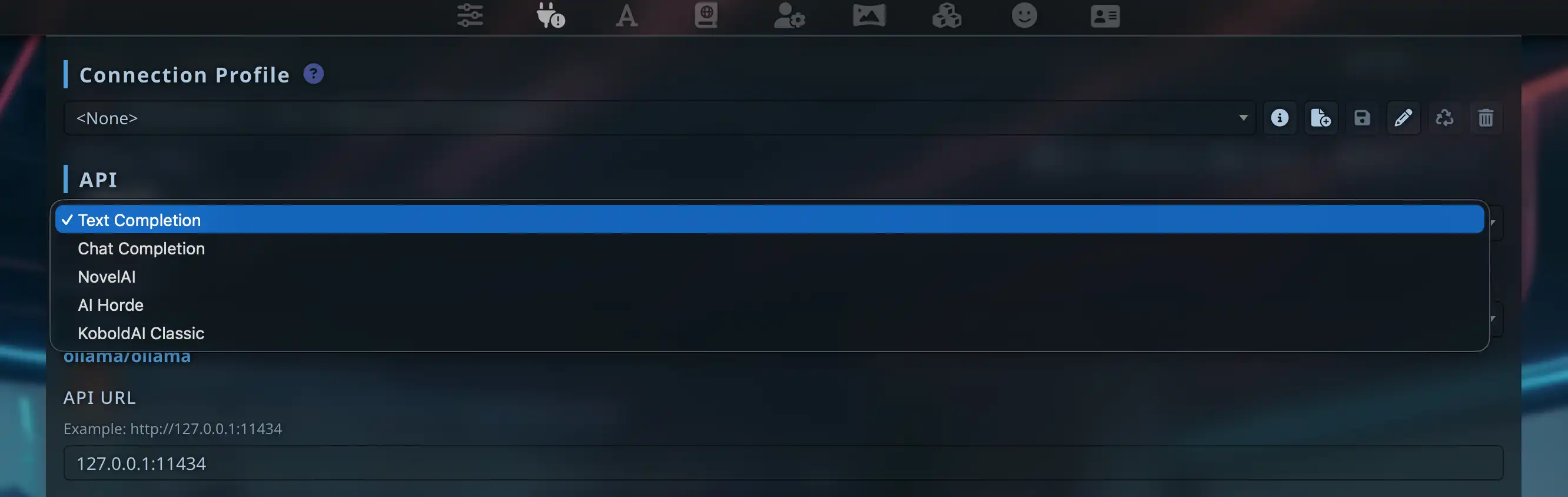

上部ツールバーのプラグアイコン(API Connections)をクリックすると、最初のドロップダウンがメインAPI(main_api)。OllamaとLM Studioが使うのは Text Completion(テキスト補完) のルート。最初に目が行きがちな Chat Completion(チャット補完) ではありません。ここを間違えると次の選択肢が出てこないので要注意。

2. LM Studioが単独で表示されなくなった

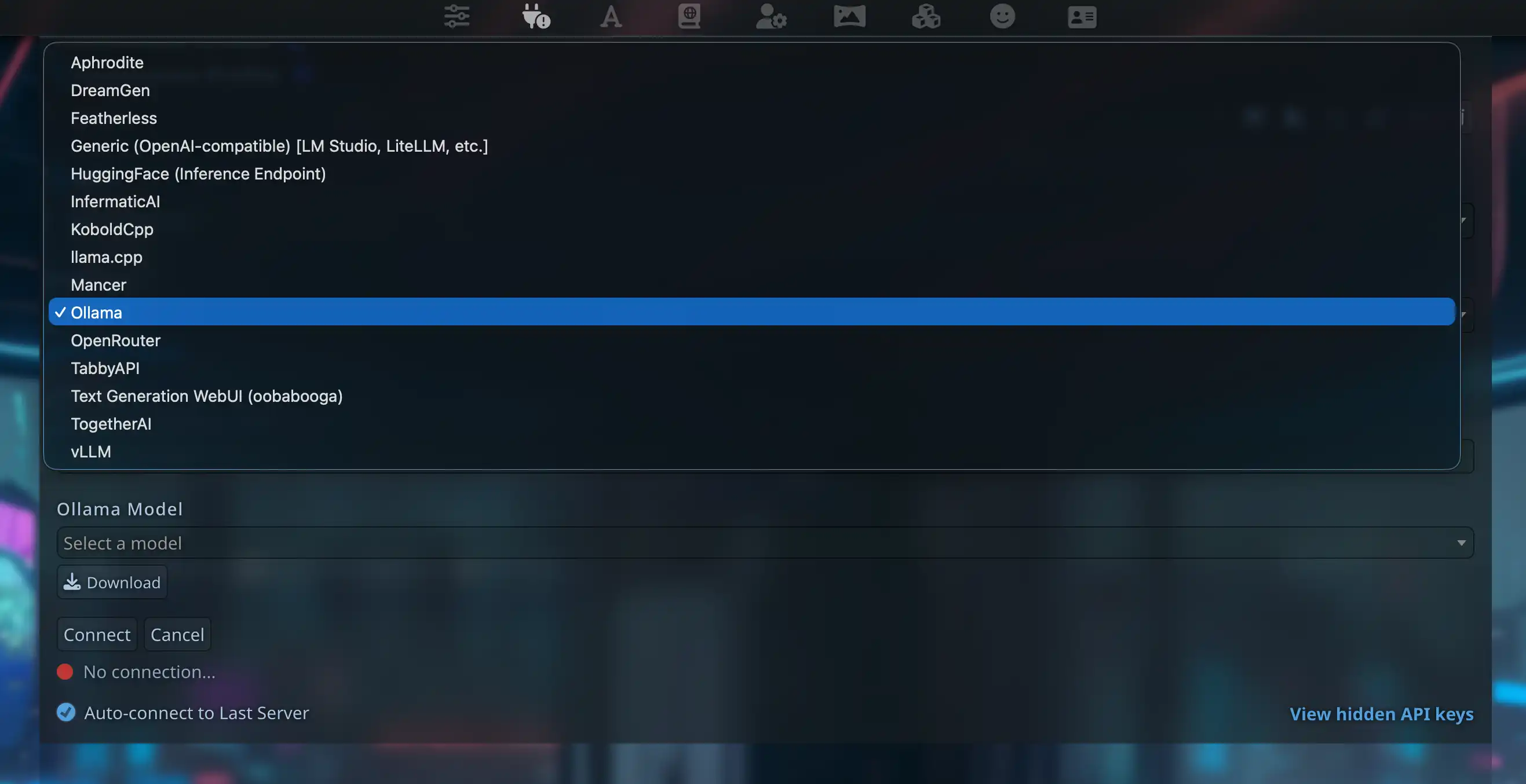

テキスト補完パネルの中で、LM StudioとLiteLLMなどが Generic (OpenAI-compatible) [LM Studio, LiteLLM, etc.] としてまとめられています。API Typeを開かないと見えません。

3. Ollamaは独立したAPIタイプ

Text Completionを選んだあと、API Type から Ollama を選ぶと、専用のAPI URLとOllamaモデルのドロップダウンが現れます。Chat Completionの中をいくら探しても見つからないのは仕様どおり。ルートを変えるだけでOKです。

3ステップで入口を見つける

ステップ1:メインAPIを「テキスト補完」に切り替える

上部のプラグアイコンをクリックしてAPI接続パネルを開き、最初のドロップダウンをChat CompletionからText Completionに変更します。

ステップ2:API TypeでOllamaを選ぶ

テキスト補完パネルが開いたら、API Type ドロップダウンから Ollama を選択。LM Studioを使う場合は Generic (OpenAI-compatible) [LM Studio, LiteLLM, etc.] を選びます。

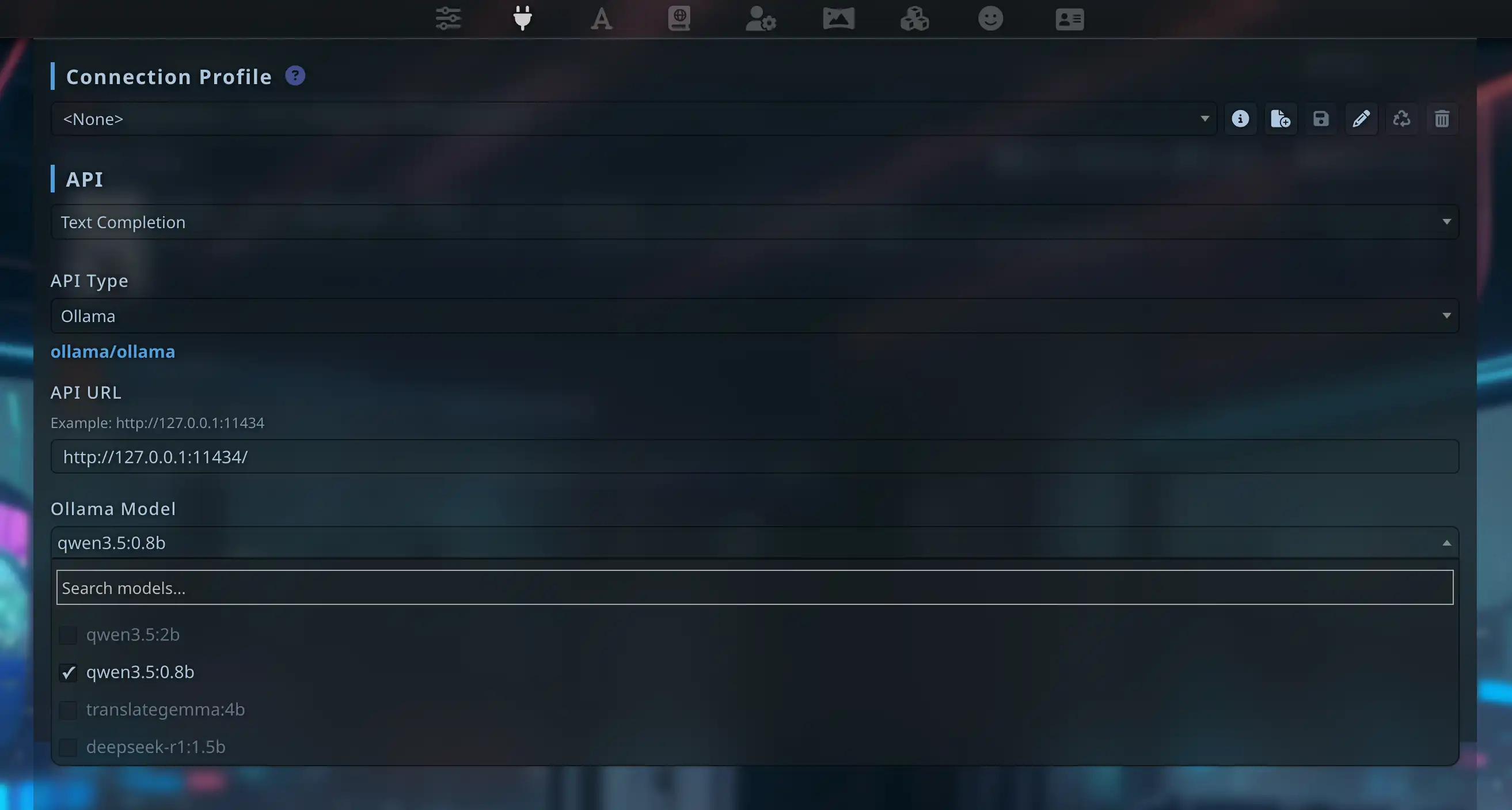

ステップ3:URLを入力してモデルを選び、接続

API URLに(ローカル機のデフォルトは http://127.0.0.1:11434)を入力して Connect をクリック。接続が成功するとOllamaモデルのドロップダウンにインストール済みのモデルが表示されるので、選択するだけです。

Ollamaの設定(ネイティブ方式・推奨)

ローカル環境の準備

Ollamaがインストール済みで起動中であることを確認して、ターミナルでモデルを取得します:

# モデルを取得(llama3.2の例)

ollama pull llama3.2

# または直接実行(初回は自動ダウンロード)

ollama run qwen3.5:27bSilly Tavernでの設定

| 設定項目 | 入力内容 |

|---|---|

| メインAPI | Text Completion |

| API Type | Ollama |

| API URL | http://127.0.0.1:11434 |

| Ollamaモデル | ドロップダウンからインストール済みモデルを選択 |

なぜ汎用OpenAIインターフェースが使えないの? Ollamaは独自の

/api/generateエンドポイントを使っており、OpenAIの/v1/chat/completionsとは形式が違います。Generic OpenAIオプションに無理やり入れるとエラーになります。専用のOllamaタイプを使ってください。

LM Studioの設定(OpenAI互換方式)

LM Studioのローカルサーバーは OpenAI互換インターフェースを公開しているので、Ollamaタイプではなく Generic (OpenAI-compatible) を使います。

設定手順

| 設定項目 | 入力内容 |

|---|---|

| メインAPI | Text Completion |

| API Type | Generic (OpenAI-compatible) [LM Studio, LiteLLM, etc.] |

| Server URL | http://127.0.0.1:1234(LM Studioデフォルト) |

| API Key | ローカル使用では通常空欄 |

LM StudioでモデルをロードしてLocal Serverを起動しておかないと、Silly Tavernから接続できません。

実機テスト:qwen3.5:0.8bはロールプレイに向いてる?

Ollamaを設定できたので、試しに qwen3.5:0.8b でロールプレイをテストしてみました——結果は予想外で:

本来出てはいけないコードの断片やシステムプロンプトのタグが返答に混入してしまい、会話が成立しませんでした。このモデルは会話には向いていない印象です。0.8bというパラメータ数はロールプレイシナリオには小さすぎます。最低でも 7B以上 のモデルを使うことをお勧めします。スムーズなロールプレイ体験には 14Bや27B がより確実です。Qwen 3.5-27Bのレビュー記事で大きなパラメータ版の実際のパフォーマンスが確認できます。

参考リンク

- Silly Tavern公式ドキュメント

- Ollamaプロジェクト

- LM Studio公式サイト

- MiniTavern公式サイト(スマホ向けAIロールプレイアプリ)

著者について

よくある質問(FAQ)

Q1:Connectをクリックしても反応がなく、エラーも出ない?

まずメインAPIが Text Completion になっているか確認してください——これが一番よくある見落としです。次にOllamaサービスが動いているか確認:ターミナルで ollama list を実行してモデル一覧が表示されれば正常です。LM Studioユーザーはローカルサーバーが起動していることを確認してください。

Q2:接続成功と表示されるのに、メッセージを送っても返答がない?

モデル名がOllama側と一致しているか確認してください。スペルが間違っているとサイレントに失敗します。また ストリーミング出力(Streaming) をオフにするか、コンテキスト長を下げることも試してみてください。パラメータの不一致でリクエストがハングすることがあります。

Q3:モデルの出力に変なコードやタグが混入するのはなぜ?

通常はモデルのパラメータ数が小さすぎることが原因です——0.8bのような超小型モデルはシステムプロンプトやフォーマットタグを出力に混入しやすく、instruction-followingを正しく処理できません。7B以上のモデルに変えることをお勧めします。ロールプレイシナリオには14Bまたは27Bがおすすめです。

Q4:Text CompletionとChat Completionの違いは?どちらが良い?

2つのインターフェースは並行して存在し、用途が異なります。OllamaとローカルモデルはText Completionを使い、OpenAI・ClaudeなどのクラウドAPIはChat Completionを使います。どちらが優れているというわけではなく、接続するサービスの種類に合わせて選ぶだけです。

Q5:スマホでローカルモデルは使える?

スマホ端末で大型モデルを直接動かすのは現実的ではありません。スマホでAIロールプレイを楽しみたい場合は MiniTavern を試してみてください——API Key(OpenRouterやDeepSeekなど)を設定するだけで使えます。自分でサーバーを立てる必要はありません。

Q6:Silly Tavernの「セルフホスト」とクラウドAPIの違いは?

セルフホストでは、PCや自宅サーバー上でSilly Tavern本体とOllama(またはLM Studio)を動かし、推論も会話ログも基本ローカルに残せます。クラウドのChat Completion(OpenAI等)はデータがベンダー側を経由するため、用途に応じて使い分けるのが一般的です。本記事の手順は、会話・推論をローカルに閉じる自前ホスティング向けで、Text Completion → Ollama/Generic の接続が中心です。

執筆日:2026年3月23日

最終更新:2026年3月23日