Не видите Ollama в новой версии Silly Tavern? Три шага к локальной модели

Silly Tavern (ориентир по версии — 1.16.0) удобен как self-hosted фронт на ПК или домашнем сервере. Вместе с Ollama и LM Studio можно гонять локальные LLM, оставляя переписку у себя — это про приватность и контроль. После обновления часто спрашивают: куда делись пункты Ollama / LM Studio? Их не убрали: поменялась структура панели API: глубже стали главный API и тип API. Ниже — три шага к нужному месту.

Почему «нет» Ollama?

В новых версиях блок подключения API перегруппирован:

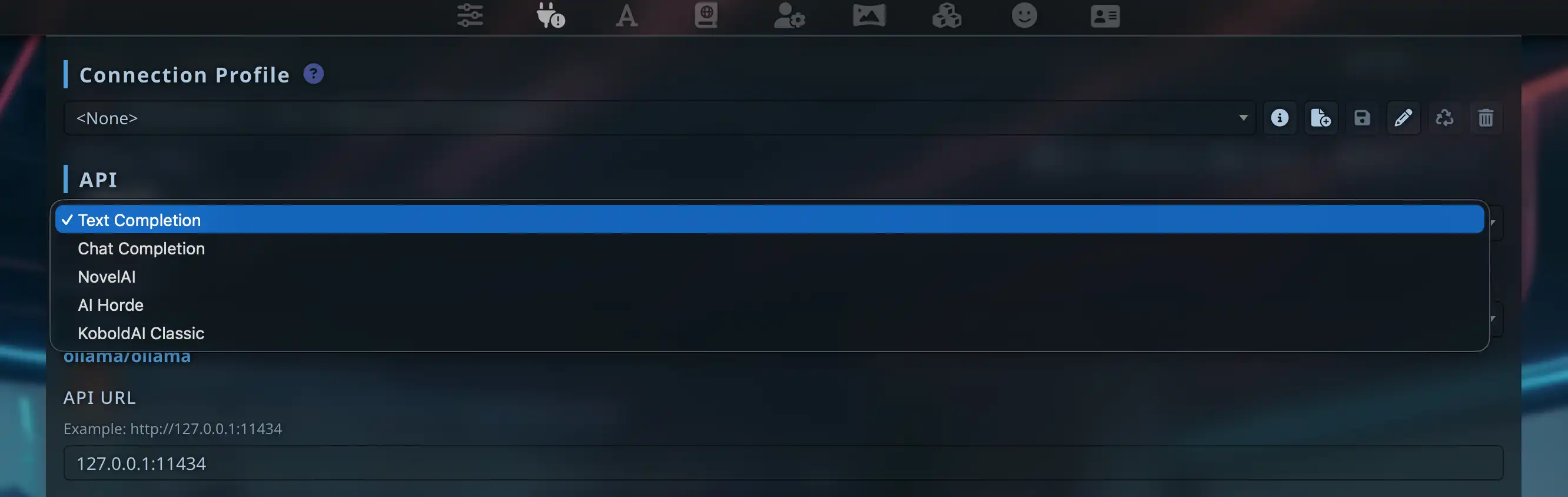

1. Два главных маршрута

По иконке вилки (API Connections) первый список — main API. Ollama и LM Studio идут через Text Completion (дополнение текста), а не через заметный по умолчанию Chat Completion. Если выбрать не тот верхний уровень, дальше не появятся нужные опции.

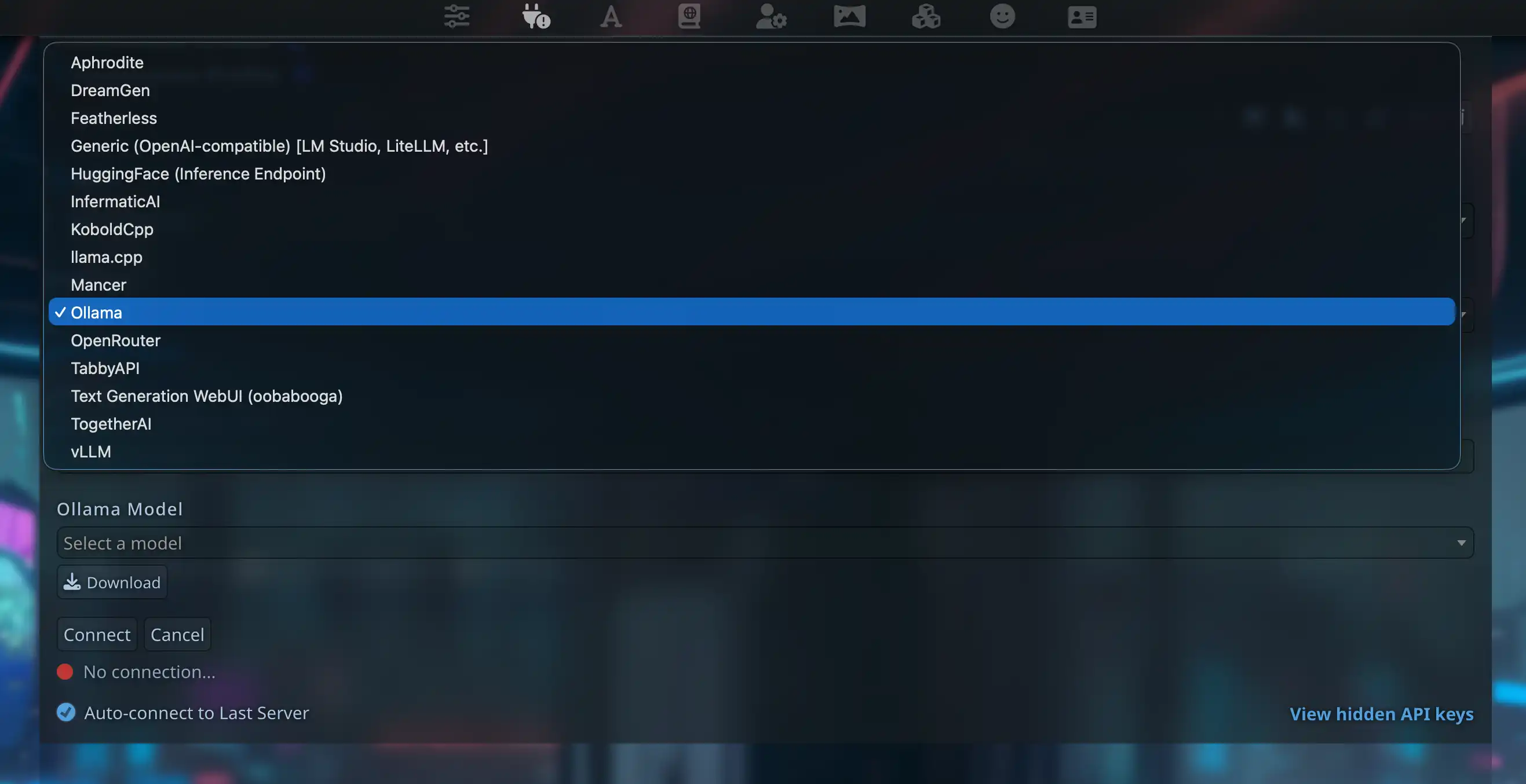

2. LM Studio не отдельным пунктом

В панели текстового дополнения LM Studio и LiteLLM объединены в Generic (OpenAI-compatible) [LM Studio, LiteLLM, etc.] — нужно раскрыть API Type.

3. Ollama — отдельный тип

После Text Completion в API Type выбирают Ollama — тогда появятся свой URL и список моделей. В Chat Completion этого типа не будет — так задумано, переключите ветку.

Три шага

Шаг 1: главный API → Text Completion

Откройте панель API и в первом списке переключите с Chat Completion на Text Completion.

Шаг 2: тип API → Ollama

В блоке текстового дополнения в API Type выберите Ollama. Для LM Studio — Generic (OpenAI-compatible) [LM Studio, LiteLLM, etc.].

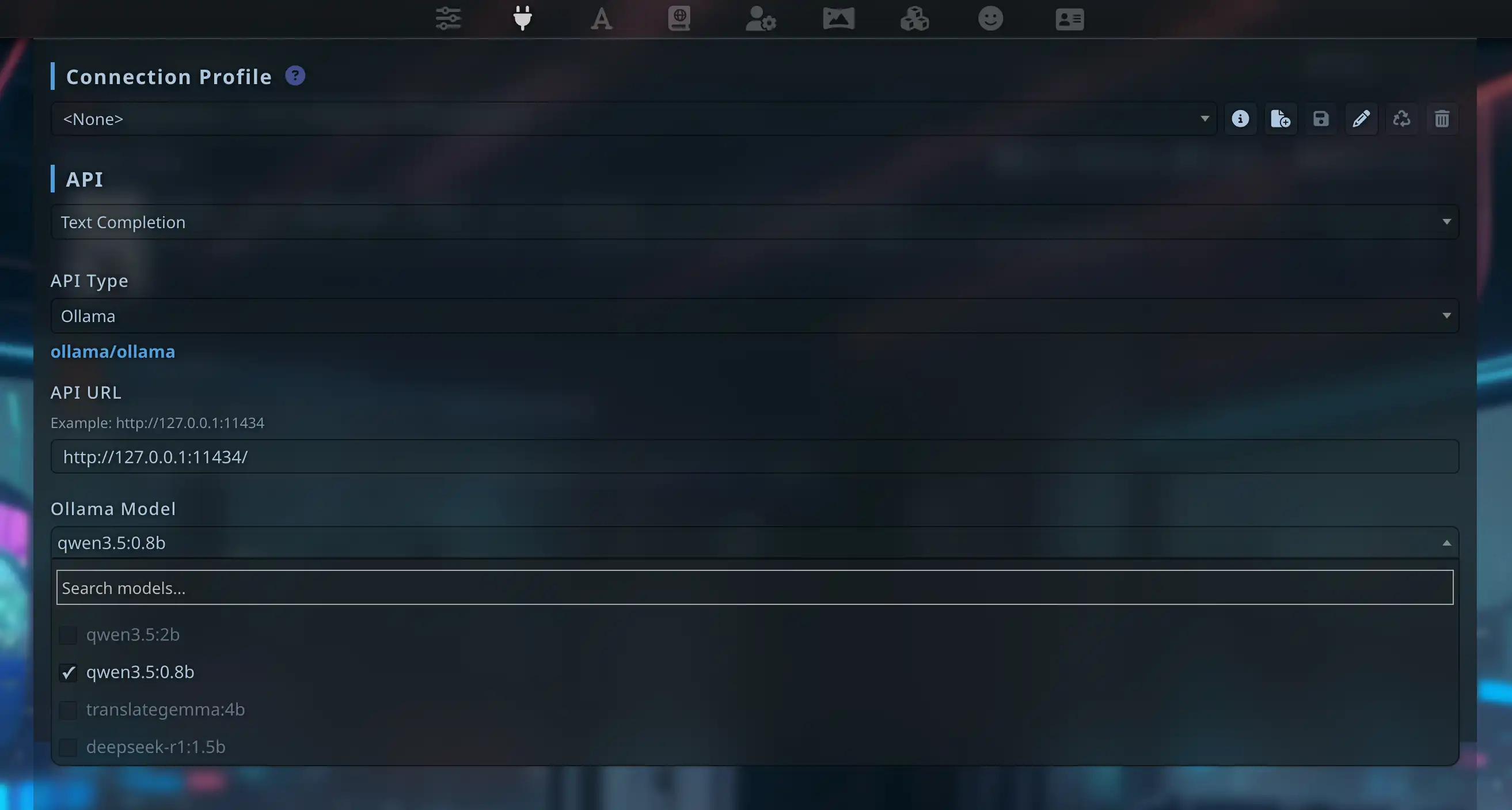

Шаг 3: URL, модель, Connect

В API URL укажите http://127.0.0.1:11434, нажмите Connect. После успеха в списке появятся модели Ollama.

Ollama (рекомендуемый путь)

Окружение

Убедитесь, что Ollama установлена и запущена:

ollama pull llama3.2

ollama run qwen3.5:27bПоля в Silly Tavern

| Поле | Значение |

|---|---|

| Главный API | Text Completion |

| Тип API | Ollama |

| API URL | http://127.0.0.1:11434 |

| Модель Ollama | из списка |

Почему не Generic OpenAI? У Ollama свой

/api/generate, не/v1/chat/completions. Нужен именно тип Ollama.

LM Studio (OpenAI-совместимый)

Локальный сервер LM Studio говорит по OpenAI API → используйте Generic (OpenAI-compatible), не тип Ollama.

| Поле | Значение |

|---|---|

| Главный API | Text Completion |

| Тип API | Generic (OpenAI-compatible) [LM Studio, LiteLLM, etc.] |

| Server URL | http://127.0.0.1:1234 |

| API Key | пусто для чисто локального |

Сначала загрузите модель в LM Studio и запустите Local Server.

Тест: qwen3.5:0.8b для ролевого чата?

После подключения Ollama попробовали qwen3.5:0.8b в сценарии RP — слабо:

В ответ попали фрагменты кода и служебные теги. Для сложного RP разумно минимум 7B+; стабильнее 14B / 27B. Больший размер — в материале Qwen 3.5-27B и японские карточки или японская версия.

Ещё в блоге

- Qwen 3.5-27B и японские карточки в Silly Tavern — тот же язык, практический тест локальной модели

- Can’t find Ollama in new Silly Tavern? — та же тема на английском

- スマホで Silly Tavern|MiniTavern(iOS/Android) — мобильный клиент, японская статья

Ссылки

Об авторе

FAQ

Connect не реагирует и ошибок нет?

Чаще всего забыли Text Completion. Проверьте ollama list в терминале. Для LM Studio — запущен ли локальный сервер.

Соединение есть, ответа нет?

Сверьте имя модели с Ollama посимвольно. Попробуйте отключить Streaming или уменьшить контекст.

Почему в ответе мусор и теги?

Часто виновата слишком маленькая модель (например 0.8B). Берите 7B+, для RP лучше 14B / 27B.

Text Completion vs Chat Completion?

Разные протоколы. Ollama и многие локальные цепочки — Text Completion; облачные ChatGPT/Claude — Chat Completion. Выбирайте по бэкенду.

Локальная LLM на телефоне?

На телефоне тяжело. Для RP на ходу — MiniTavern с OpenRouter, DeepSeek и т.п.

Self-hosted и облачный API?

При self-hosted Silly Tavern + Ollama запросы и логи чаще остаются у вас. Chat Completion в облаке проходит через провайдера. Здесь — схема «локальный вывод» через Text Completion → Ollama / Generic.

Опубликовано: 31 марта 2026

Обновлено: 22 апреля 2026