Day 5: Silly Tavernローカルモデル活用

Day 4でクラウドモデルとの接続方法を学んだところで、今度はローカルモデルを使ってみましょう。ローカルモデルとは、自分のパソコンで動作するAIのこと。インターネット不要で、完全無料、プライバシーも完璧に守られます。

この記事では、2026年最新の情報を基に、ローカルモデルとは何か、Ollamaの使い方、どのモデルを選ぶべきかを、初心者の方でも分かりやすく解説します。クラウドモデルとの違いや、それぞれのメリット・デメリットも詳しく説明します。

この7日間シリーズの第5日目として、ローカルモデルの活用をマスターし、完全無料でSilly Tavernを楽しみましょう。

ローカルモデルとは?|自分のPCで動くAI

ローカルモデルとは、インターネットに接続せず、自分のパソコン上で動作するAIモデルです。たとえるなら、クラウドモデルが「図書館から本を借りる」なら、ローカルモデルは「自宅の本棚にある本」のようなものです。

ローカルモデルの仕組み

ローカルモデルは、AIの「脳」にあたるファイル(モデルファイル)をダウンロードし、自分のパソコンで実行します。このファイルは通常、数GB〜数十GBのサイズがあり、パソコンのメモリ(RAM)やGPUを使って動作します。

クラウドモデルとの違い

| 項目 | ローカルモデル | クラウドモデル |

|---|---|---|

| インターネット | 不要 | 必要 |

| 料金 | 無料 | 多くは有料 |

| プライバシー | 完全保護 | データが外部へ |

| 性能 | PC性能に依存 | 常に高性能 |

| セットアップ | やや複雑 | 簡単 |

| ハードウェア要件 | 高め | 低い |

💡 ヒント: 初心者はまずクラウドモデル(Day 4参照)から始めて、慣れてきたらローカルモデルに挑戦するのがおすすめです。

ローカルモデルのメリット・デメリット

ローカルモデルを使う前に、メリットとデメリットを理解しておきましょう。

メリット

- 完全無料:一度ダウンロードすれば、何度使っても無料

- プライバシー保護:会話内容が外部に送信されない

- オフライン利用:インターネット不要で、どこでも使える

- 制限なし:APIの使用制限やレート制限がない

- カスタマイズ可能:モデルを自分好みに調整できる

デメリット

- ハードウェア要件が高い:十分なメモリやGPUが必要

- セットアップが複雑:初心者には難しい場合がある

- 性能がPCに依存:低スペックPCでは動作が遅い

- モデルサイズが大きい:数GB〜数十GBのストレージが必要

- クラウドより性能が劣る場合も:最新のクラウドモデルには及ばないことも

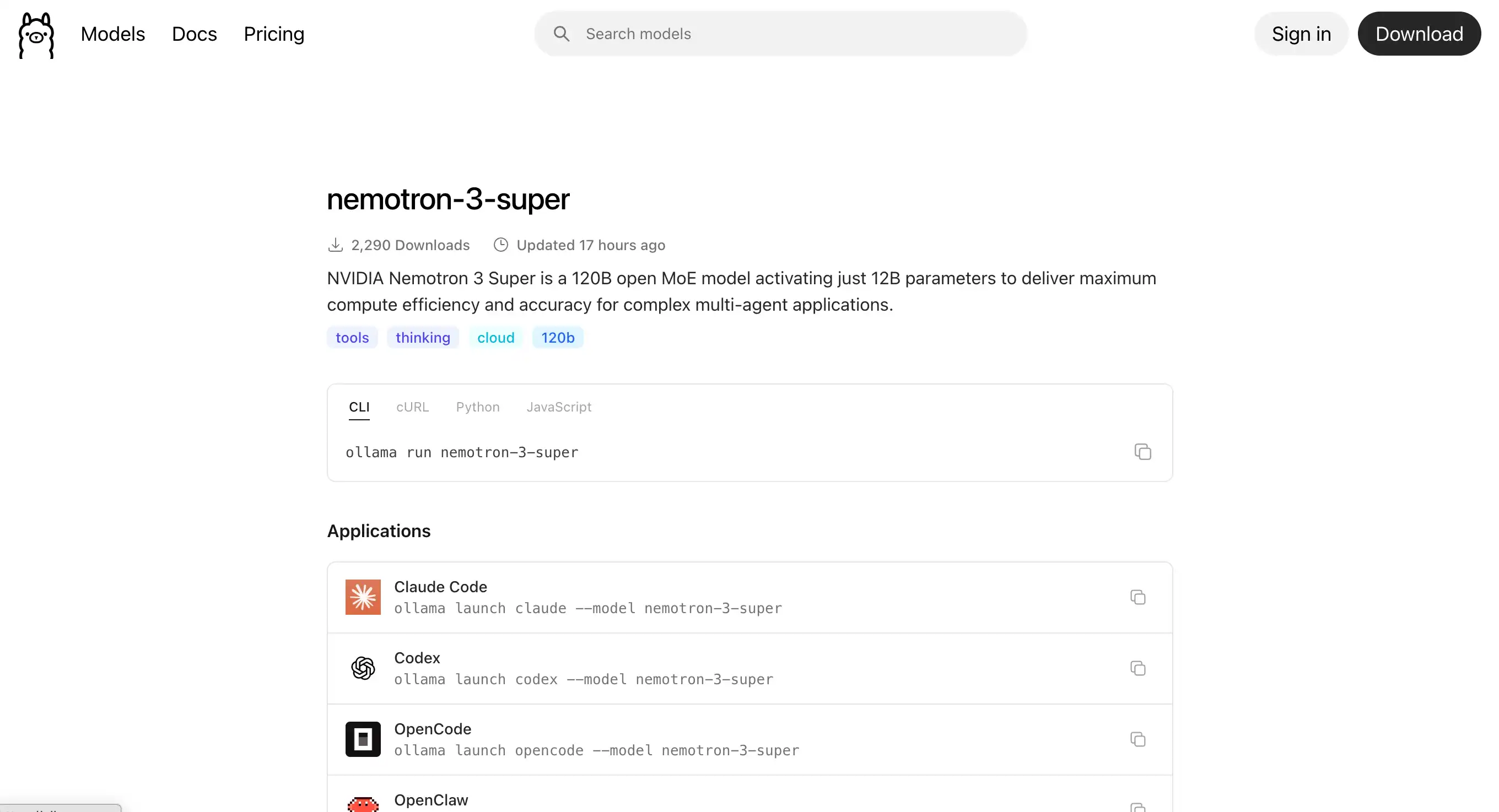

Ollamaとは?|最も簡単なローカルモデル実行ツール

Ollamaとは、ローカルモデルを簡単に実行できるツールです。たとえるなら、「ローカルモデル専用のアプリストア」のようなもの。複雑な設定なしで、モデルをダウンロードして実行できます。

Ollamaの特徴

- 簡単インストール:Homebrewで一発インストール

- モデル管理が簡単:コマンド一つでダウンロード・実行

- Apple Silicon最適化:M1/M2/M3チップで高速動作

- 自動メモリ管理:利用可能なメモリを自動調整

- Silly Tavern対応:標準APIで簡単接続

Ollamaのインストール|macOSでの手順

Ollamaをインストールしてみましょう。Day 2でHomebrewをインストール済みなら、非常に簡単です。

ステップ1: Ollamaのインストール

ターミナルで以下のコマンドを実行します。

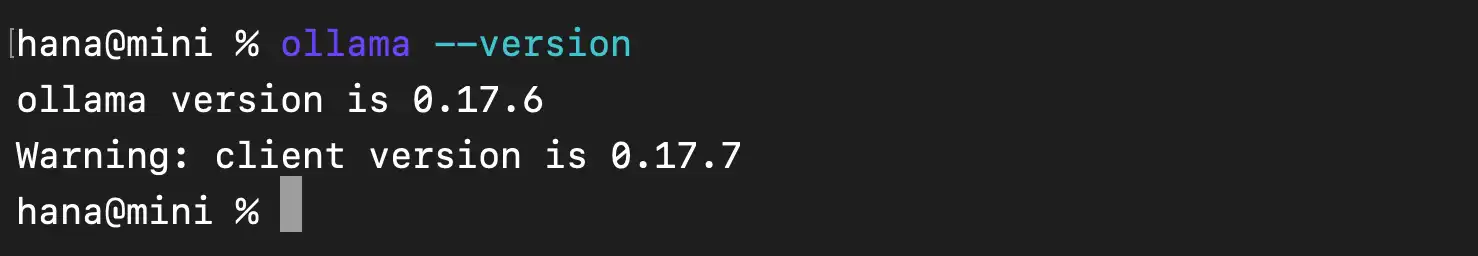

brew install ollamaインストールが完了したら、バージョンを確認します。

ollama --versionバージョン番号が表示されれば成功です。

ステップ2: Ollamaサービスの起動

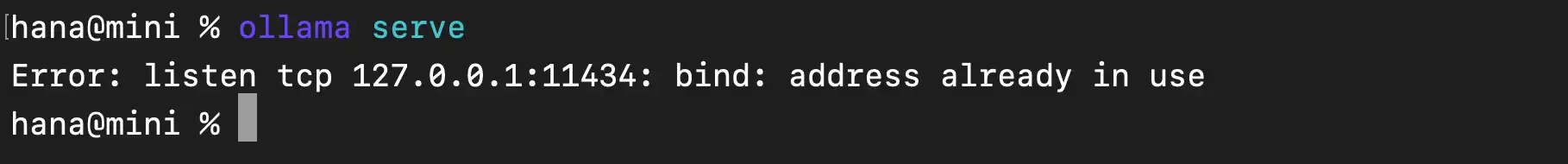

Ollamaをバックグラウンドで起動します。

ollama serveこのコマンドを実行すると、Ollamaがバックグラウンドで動作し、http://localhost:11434でAPIが利用可能になります。

💡 ヒント: このターミナルウィンドウは開いたままにしておいてください。閉じるとOllamaが停止します。

モデルのダウンロード|どれを選ぶべきか

Ollamaでは、様々なモデルが利用可能です。2026年現在、おすすめのモデルを紹介します。

推奨モデル一覧

| モデル名 | サイズ | 必要メモリ | 性能 | 用途 |

|---|---|---|---|---|

| Qwen3.5 7B | 4.7GB | 8GB | 非常に高 | 多言語・日本語最強、初心者向け |

| Mistral Small 3.1 | 4.5GB | 8GB | 高 | 汎用・高速応答、日常会話 |

| DeepSeek-R1 7B | 5.2GB | 10GB | 非常に高 | 推論特化・長文・複雑なタスク |

| Nemotron Mini 4B | 2.7GB | 6GB | 中 | NVIDIA製・低スペックPC向け |

| Phi-4 Mini 3.8B | 2.5GB | 6GB | 中-高 | Microsoft製・軽量・高効率 |

初心者におすすめ

Qwen3.5 7Bが最もおすすめです。理由は:

- 日本語対応が最も優秀

- 8GBメモリで動作

- 多言語・高品質な応答

- OpenRouterでも人気No.1クラス

モデルのダウンロード方法

新しいターミナルウィンドウを開いて、以下のコマンドを実行します。

ollama pull qwen3.5:7bダウンロードには数分かかります。完了すると、モデルが使用可能になります。

Silly TavernとOllamaの接続

Ollamaの準備ができたら、Silly Tavernと接続しましょう。

ステップ1: Silly Tavernの設定

- Silly Tavernを起動:

http://localhost:8000にアクセス - API設定を開く:左上のメニューから「API Connections」を選択

- 「Chat Completion」タブを選択

- APIタイプを選択:「Chat Completion」→「Ollama」を選択

- URLを入力:

http://localhost:11434(デフォルト) - モデルを選択:ダウンロードしたモデル(例:qwen3.5:7b)

- 「Connect」をクリック

ステップ2: 接続テスト

キャラクターを選択して、メッセージを送信してみましょう。応答が返ってくれば成功です!

💡 ヒント: 初回の応答は少し時間がかかる場合があります。モデルがメモリに読み込まれるためです。

パフォーマンス最適化|快適に使うコツ

ローカルモデルを快適に使うための最適化テクニックを紹介します。

1. メモリ管理

問題: メモリ不足で動作が遅い

解決策:

- 小さいモデルを選ぶ(Nemotron Mini 4Bなど)

- 他のアプリケーションを閉じる

- Ollamaの設定で最大メモリを調整

2. Apple Silicon最適化

M1/M2/M3チップを搭載したMacでは、以下の設定で高速化できます。

# Metal(GPU)を有効化(デフォルトで有効)

export OLLAMA_GPU_LAYERS=9993. モデルの量子化

量子化とは、モデルのサイズを小さくする技術です。たとえば、8bitや4bitに量子化することで、メモリ使用量を減らせます。

Ollamaでは、モデル名に量子化レベルが含まれています:

qwen3.5:7b- 標準qwen3.5:7b-q4_K_M- 4bit量子化(より小さい)qwen3.5:7b-q8_0- 8bit量子化(バランス)

他のローカルモデルツール

Ollama以外にも、ローカルモデルを実行できるツールがあります。

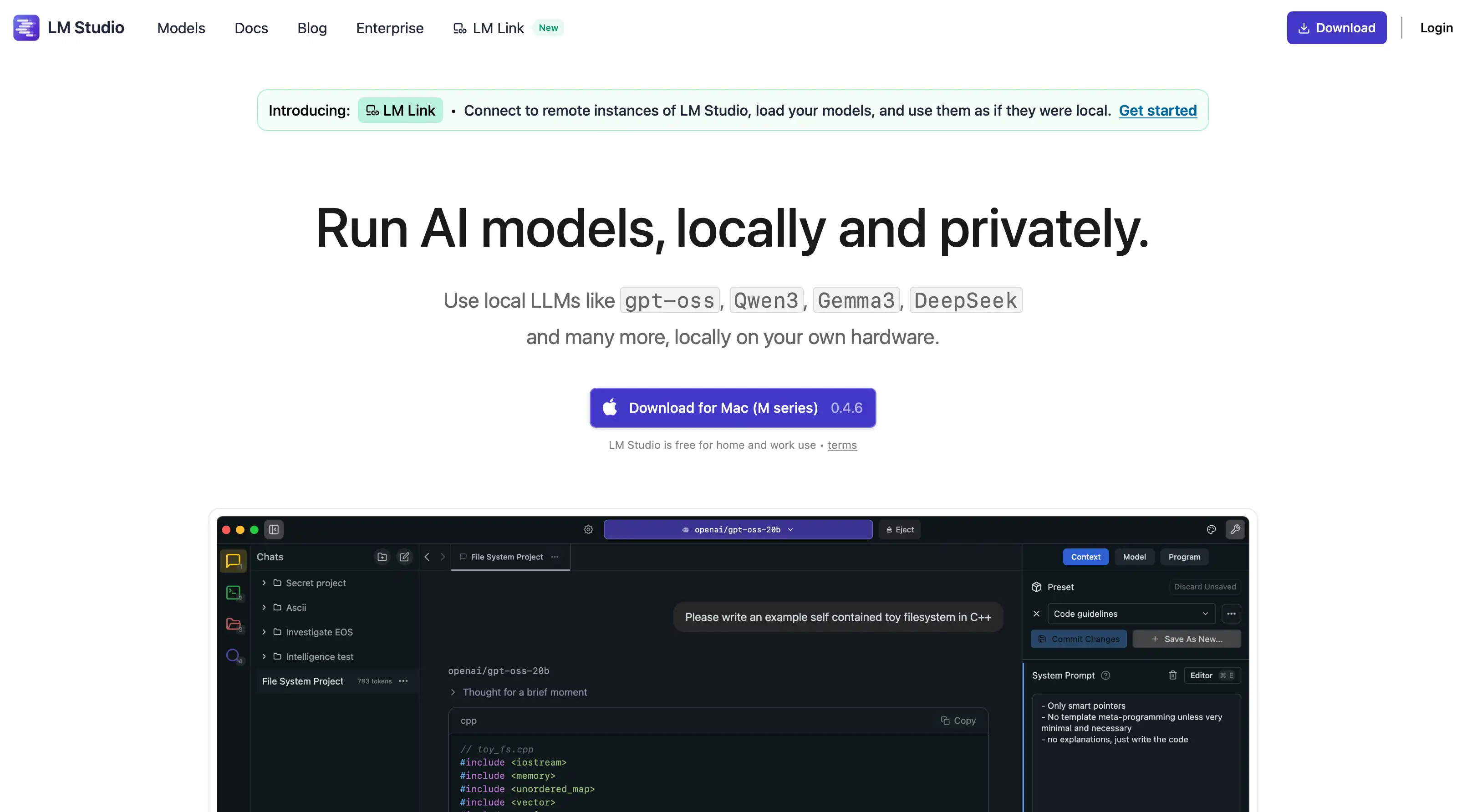

LM Studio

LM Studioとは、GUIベースのローカルモデル実行ツールです。Ollamaよりも視覚的で、初心者に優しいです。

- URL: https://lmstudio.ai/

- 特徴: GUI操作、モデル検索機能、簡単設定

- Silly Tavern接続: OpenAI互換APIで接続可能

KoboldAI

KoboldAIとは、ストーリー生成に特化したローカルモデルツールです。

- URL: https://github.com/KoboldAI/KoboldAI-Client

- 特徴: ストーリー生成、冒険モード

- Silly Tavern接続: 専用APIで接続

Oobabooga Text Generation WebUI

Oobaboogaとは、高度なカスタマイズが可能なローカルモデルツールです。

- URL: https://github.com/oobabooga/text-generation-webui

- 特徴: 豊富な設定、拡張機能

- Silly Tavern接続: OpenAI互換APIで接続

クラウド vs ローカル|どちらを選ぶべきか

クラウドモデルとローカルモデル、どちらを使うべきでしょうか?

クラウドモデルがおすすめの人

- 高性能を求める:最新の高性能AIを使いたい

- 低スペックPC:メモリやGPUが少ない

- 簡単に始めたい:複雑な設定を避けたい

- 費用を払える:月数ドル〜数十ドルの支払いが可能

ローカルモデルがおすすめの人

- プライバシー重視:会話内容を外部に送りたくない

- 完全無料で使いたい:一切の費用をかけたくない

- オフライン利用:インターネット接続がない環境

- 高スペックPC:十分なメモリとGPUがある

ハイブリッド利用

多くのユーザーは、両方を使い分けています:

- 重要な会話: ローカルモデル(プライバシー保護)

- 高品質が必要: クラウドモデル(性能重視)

- 日常会話: ローカルモデル(無料)

- 複雑なタスク: クラウドモデル(高性能)

よくあるトラブルと解決方法

ローカルモデル使用時によくあるトラブルと、その解決方法を紹介します。

トラブル1: メモリ不足エラー

原因: モデルが大きすぎる、または他のアプリがメモリを使用

解決方法:

- 小さいモデルに変更

- 他のアプリケーションを閉じる

- 量子化モデルを使用

トラブル2: 応答が非常に遅い

原因: CPU/GPUの性能不足

解決方法:

- より小さいモデルを使用

- Apple SiliconでMetal(GPU)を有効化

- バックグラウンドプロセスを停止

トラブル3: Ollamaに接続できない

原因: Ollamaサービスが起動していない

解決方法:

- ターミナルで

ollama serveを実行 - ポート11434が使用可能か確認

トラブル4: モデルが見つからない

原因: モデルがダウンロードされていない

解決方法:

ollama listでダウンロード済みモデルを確認ollama pull <モデル名>で再ダウンロード

次のステップ|高度なカスタマイズ

ローカルモデルの基本をマスターしました!次は、より高度なカスタマイズを学びましょう。

次に学ぶこと:

- Day 6: 高度なカスタマイズ - プロンプトエンジニアリングやUI設定

- Day 7: スマホで使う方法 - MiniTavernでの簡単な始め方

もっと簡単に始めたい方へ: ローカルモデルの設定が難しいと感じた方は、MiniTavernをお試しください。クラウドモデルを使った簡単なAIチャットが楽しめます。詳しくはDay 7へ。

まとめ

お疲れ様でした!この記事では、Silly Tavernでローカルモデルを使う方法を、2026年最新の情報を基に解説しました。Ollamaのインストールから、モデルの選択、Silly Tavernとの接続、パフォーマンス最適化まで、初心者の方でも理解できる内容になっています。

ローカルモデルを使えば、完全無料でプライバシーを守りながら、Silly Tavernを楽しめます。次のステップとして、高度なカスタマイズを学び、さらに深くSilly Tavernを活用しましょう!

参考リンク

著者について

よくある質問(FAQ)

Q1: ローカルモデルは完全無料ですか?

はい、完全無料です。一度モデルをダウンロードすれば、何度使っても追加費用はかかりません。

Q2: どのくらいのメモリが必要ですか?

最低8GB、推奨16GB以上です。小さいモデル(Phi-3 Mini)なら4GBでも動作します。

Q3: M1/M2/M3チップで動きますか?

はい、Apple Siliconに最適化されており、高速に動作します。

Q4: クラウドモデルより性能は劣りますか?

一般的には劣りますが、日常会話レベルなら十分な性能です。プライバシーと無料という利点があります。

Q5: オフラインで使えますか?

はい、一度モデルをダウンロードすれば、完全オフラインで使用できます。

Q6: どのモデルがおすすめですか?

初心者にはQwen3.5 7Bがおすすめです。日本語対応が優秀で、8GBメモリで動作します。

Q7: GPUは必須ですか?

必須ではありませんが、GPUがあると大幅に高速化されます。Apple SiliconのMacは統合GPUで高速です。

Q8: 複数のモデルを同時に使えますか?

メモリが十分にあれば可能ですが、通常は一つずつ使用します。

Q9: 日本語に対応していますか?

はい、Qwen3.5やMistral Small 3.1などは日本語に対応しています。

Q10: Windowsでも使えますか?

はい、OllamaはWindows、macOS、Linuxに対応しています。

執筆日: 2026年3月15日

最終更新: 2026年4月22日