Silly Tavern 新版找不到 Ollama?三步搞定本地模型設置

Silly Tavern(當前最新版本可參考 1.16.0)很適合作爲自託管或家庭服務器上的前端;配合 Ollama、LM Studio,可以把本地 LLM跑在自家機器裏,聊天內容儘量留在本機,滿足隱私與本地部署需求。升級後常有人問:Ollama / LM Studio 的界面去哪兒了?其實並不是刪掉了,而是 API 連接面板裏主 API與 API Type 的層級變深了。下面用三步帶你走到正確入口。

爲什麼找不到 Ollama?

新版本裏 API 連接區域重新歸類,主要有三點:

1. 主 API 分成兩條路線

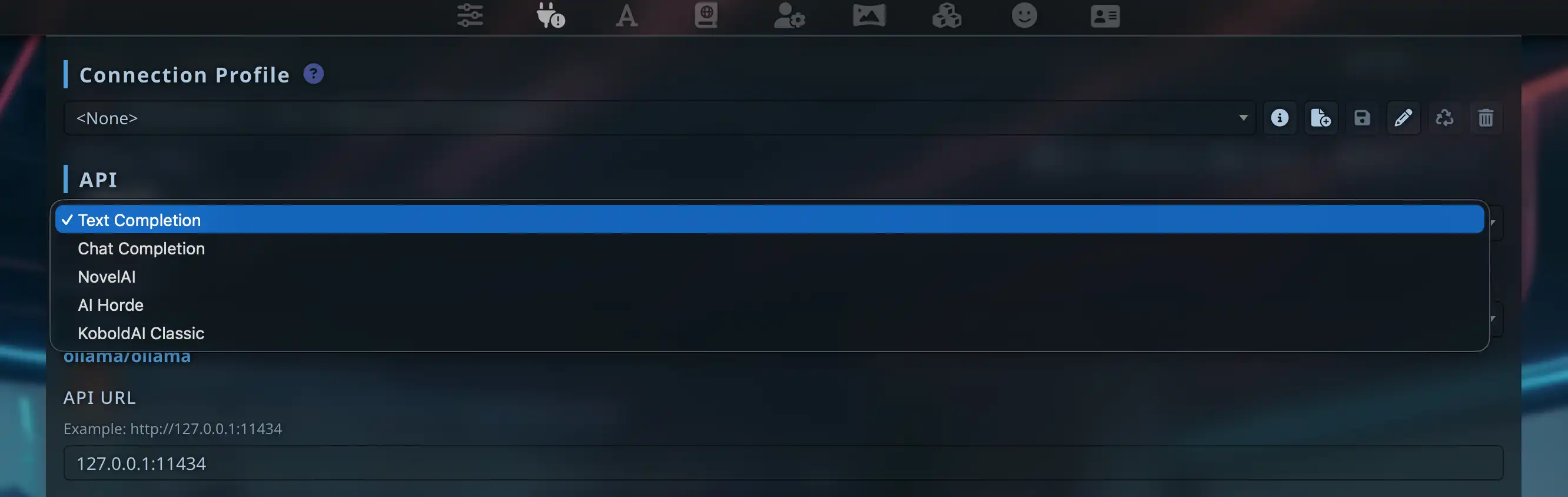

點頂部工具欄的插頭圖標(API Connections),第一個下拉框是主 API(main_api)。Ollama、LM Studio 走的是 Text Completion(文本補全),不是默認更容易看到的 Chat Completion(聊天補全)。選錯這一條,後面就不會出現預期選項。

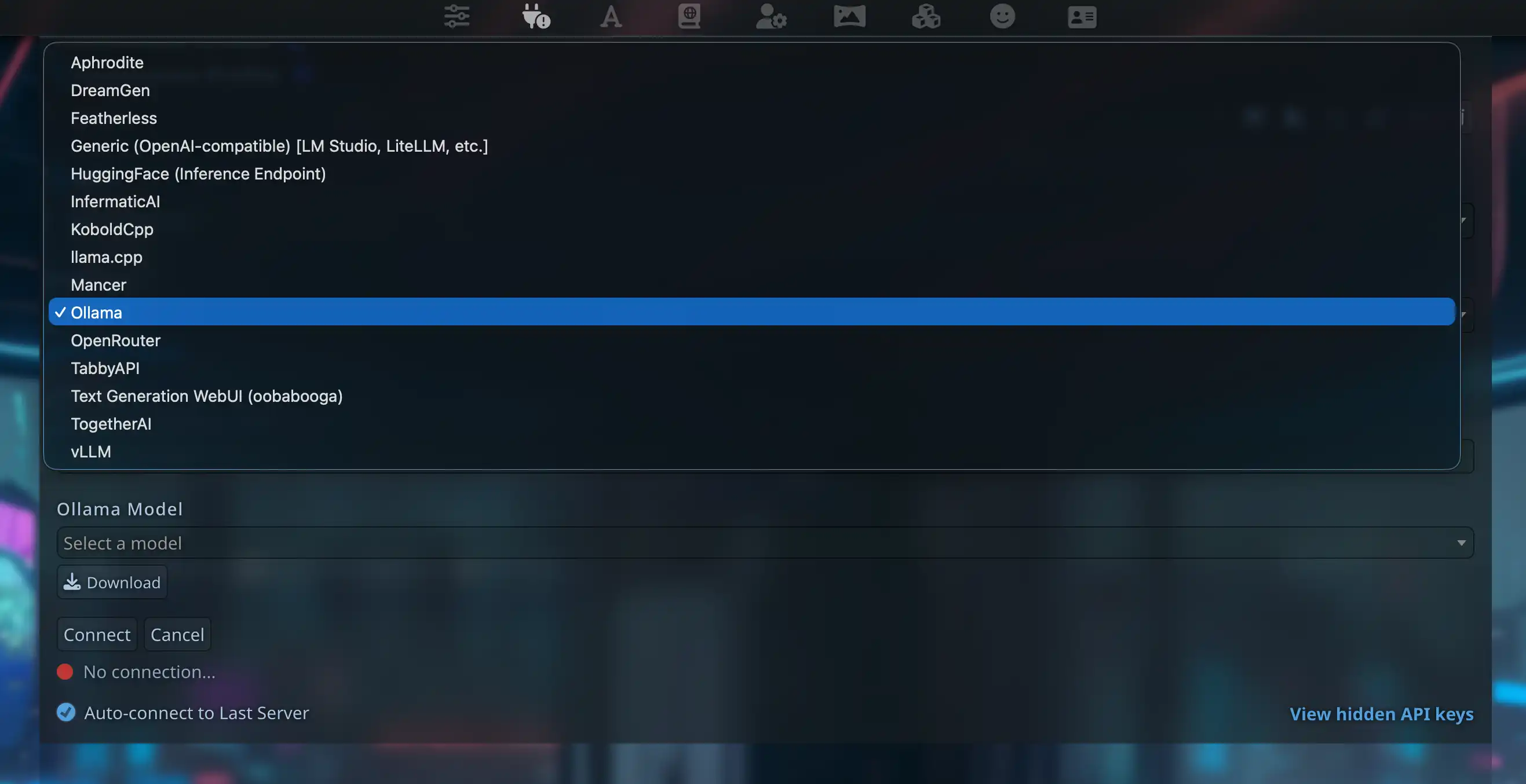

2. LM Studio 不再單獨佔一項

在「文本補全」面板裏,LM Studio 與 LiteLLM 等被合併爲 Generic (OpenAI-compatible) [LM Studio, LiteLLM, etc.],必須展開 API Type 才能看到。

3. Ollama 是獨立的 API 類型

選好 Text Completion 之後,在 API Type 裏選 Ollama,才會出現專用地址欄和模型下拉。在 Chat Completion 裏翻再找也不會出現,屬於正常行爲,換路線即可。

三步找到入口

步驟一:把主 API 切成「文本補全」

打開 API 連接面板,將第一個下拉框從 Chat Completion 改爲 Text Completion。

步驟二:在 API Type 中選擇 Ollama

文本補全面板展開後,在 API Type 中選 Ollama。若使用 LM Studio,則選 Generic (OpenAI-compatible) [LM Studio, LiteLLM, etc.]。

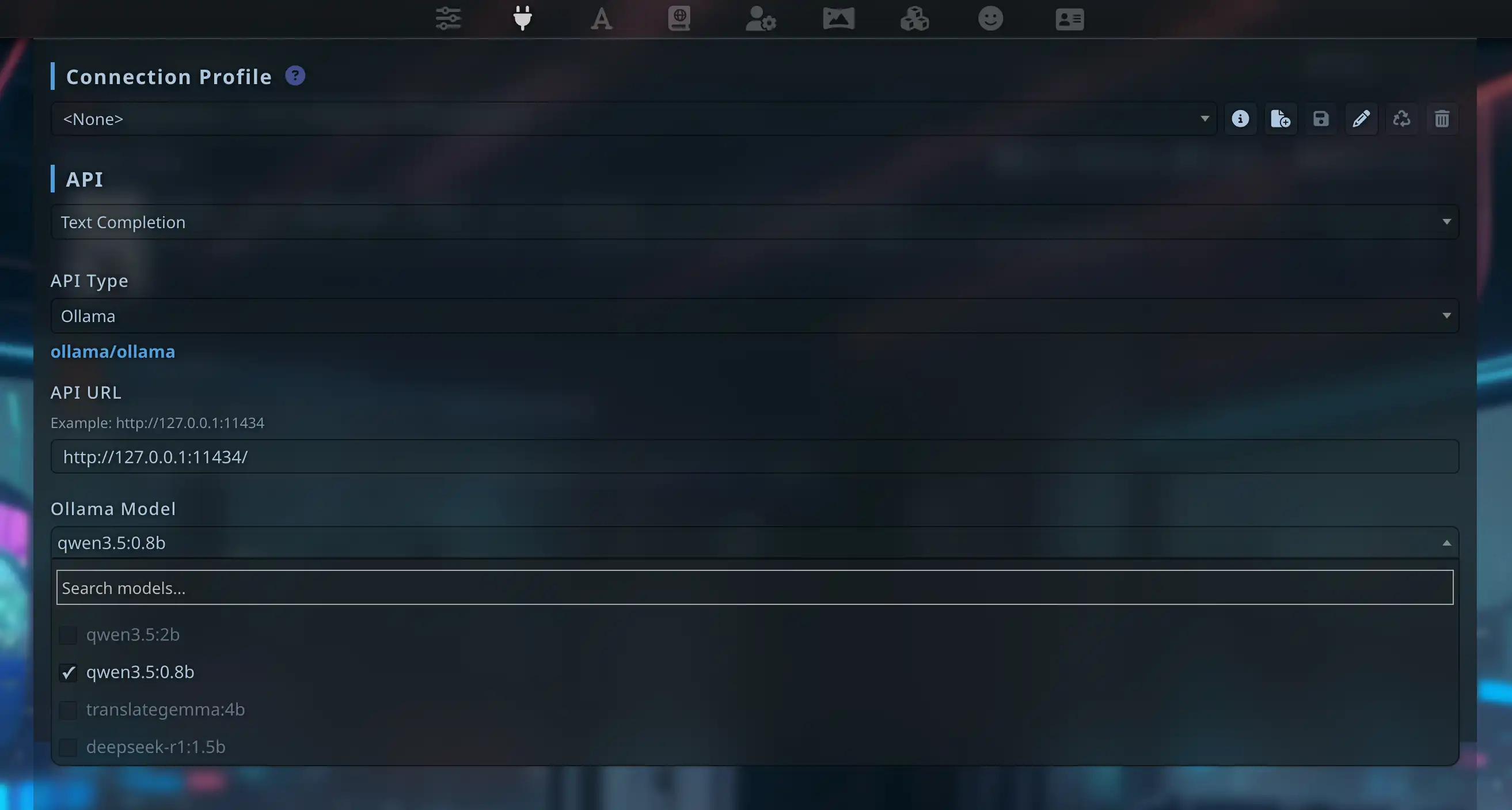

步驟三:填寫 URL、選模型並連接

在 API URL 中填入本機默認地址 http://127.0.0.1:11434,點擊 Connect。成功後,Ollama 模型下拉框會列出已安裝的模型,選中即可。

Ollama 設置(原生方式,推薦)

本地環境

確認 Ollama 已安裝並在運行,可在終端拉取模型:

# 示例:拉取 llama3.2

ollama pull llama3.2

# 或直接運行(首次會自動下載)

ollama run qwen3.5:27b在 Silly Tavern 中填寫

| 設置項 | 填寫內容 |

|---|---|

| 主 API | Text Completion |

| API Type | Ollama |

| API URL | http://127.0.0.1:11434 |

| Ollama 模型 | 從下拉框選擇已安裝的模型 |

爲什麼不能用通用 OpenAI 接口填 Ollama? Ollama 使用自家的

/api/generate,與 OpenAI 的/v1/chat/completions格式不同。硬塞進 Generic OpenAI 往往會報錯,請使用專用的 Ollama 類型。

LM Studio 設置(OpenAI 兼容)

LM Studio 的本地服務器暴露的是 OpenAI 兼容接口,因此應使用 Generic (OpenAI-compatible),而不是 Ollama 類型。

配置表

| 設置項 | 填寫內容 |

|---|---|

| 主 API | Text Completion |

| API Type | Generic (OpenAI-compatible) [LM Studio, LiteLLM, etc.] |

| Server URL | http://127.0.0.1:1234(LM Studio 默認) |

| API Key | 純本地可留空 |

須先在 LM Studio 中加載模型並啓動 Local Server,否則 Silly Tavern 無法連接。

實機測試:qwen3.5:0.8b 適合角色扮演嗎?

連上 Ollama 後,用 qwen3.5:0.8b 試了一局角色扮演——結果不太理想:

回覆裏混進了代碼片段和系統提示裏的標籤,難以正常對話。參數量 0.8B 對複雜角色扮演偏小,建議至少 7B 及以上;想要更穩的體驗可優先考慮 14B 或 27B。更大參數的實測可參考本站中文稿 Qwen 3.5-27B 與日語角色卡實測,或日文站 同題評測。

參考鏈接

- Silly Tavern 官方文檔

- Ollama 項目

- LM Studio 官網

- MiniTavern 官網(手機端 AI 角色扮演應用)

關於作者

常見問題(FAQ)

Q1:點 Connect 沒反應,也不報錯?

請先確認主 API 是否爲 Text Completion——這是最常見的遺漏。再確認 Ollama 是否在運行:終端執行 ollama list 能列出模型即正常。LM Studio 用戶請確認本地服務已啓動。

Q2:顯示連接成功,但發消息沒有回覆?

檢查模型名是否與 Ollama 側完全一致,拼寫錯誤有時會靜默失敗。也可嘗試關閉**流式輸出(Streaming)**或降低上下文長度;參數不匹配偶爾會導致請求卡住。

Q3:爲什麼輸出裏會混入奇怪代碼或標籤?

多爲模型太小:例如 0.8B 這類超小模型容易把系統提示或格式標籤泄到正文裏,指令跟隨能力也弱。建議換到 7B 以上;角色扮演場景更推薦 14B / 27B。

Q4:Text Completion 和 Chat Completion 有什麼區別?該用哪個?

兩者並存、用途不同。Ollama 與多數本地鏈路走 Text Completion;OpenAI、Claude 等雲端 Chat Completion。沒有絕對優劣,按所接服務類型選擇即可。

Q5:手機上能用本地大模型嗎?

手機直接跑大模型並不現實。若想在手機上玩 AI 角色扮演,可嘗試 MiniTavern——配置 OpenRouter、DeepSeek 等 API 即可使用,無需自己搭服務器。

Q6:Silly Tavern「自託管」和雲端 API 有何不同?

自託管時,可在 PC 或家庭服務器上同時跑 Silly Tavern 與 Ollama(或 LM Studio),推理與對話記錄多可留在本地。雲端 Chat Completion(如 OpenAI)數據會經過服務商,通常按場景組合使用。本文步驟面向希望把對話與推理儘量留在本地的部署方式,核心是 Text Completion → Ollama / Generic。

發佈日期:2026 年 3 月 23 日

最後更新:2026 年 3 月 23 日